Hugging Face提唱「効率的AI活用」5つのポイント:タスク特化SLMでコスト削減を実現する企業戦略

企業のAI活用において、「とりあえず大規模なモデルを使えば良い」という考え方が見直されています。Hugging Faceが発表した最新の論文では、パフォーマンスを犠牲にすることなくAIコストを削減する5つの重要なポイントが示されており、これはNVIDIAが先週発表した「何でもかんでも大きなAIではなく、タスクによってはより小規模なAIを使った方がコスパが高い」という主張と軌を一にしています。

この記事では、Hugging Faceが提唱する効率的なAI活用戦略について、具体的な実装方法から企業規模別の適用可能性まで、詳しく解説していきます。

目次

AIモデル計算負荷の現実:「よりスマートに」が新たなトレンド

現在、多くの企業が直面しているのは、大規模モデルを使用することによる計算負荷の重さです。Hugging Faceは、この課題に対して「よりハードではなく、よりスマートに」というアプローチを提案しています。

AIスケーリングにおいて、企業はエネルギーを戦略的優位性に変える方法を模索しており、効率的な設計により実際のスループット向上を目指す動きが活発化しています。これは単なるコスト削減ではなく、持続可能なAI活用のための根本的な発想転換を意味します。

5つの重要ポイント:効率的AI活用の具体的戦略

1. タスクに応じたモデルの適正サイズ

最も重要なポイントは、何でもかんでも巨大なモデルを使うのではなく、タスク特化型の小規模モデルを活用することです。

実際の検証結果では、タスク特化モデルは汎用モデルの20~30倍のエネルギー効率を示すケースも確認されています。これは驚異的な効率改善であり、企業のAI運用コストに直接的な影響を与える重要な知見です。

さらに、蒸留(Distillation)という技術を使用することで、巨大モデルを小型化して単独で使用することも可能になります。この技術により、大規模モデルの知識を小さなモデルに移転し、効率性を保ちながら高いパフォーマンスを実現できます。

2. システム設計にナッジ理論を取り入れた効率化誘導

Hugging Faceは、システム設計にナッジ理論を取り入れることを推奨しています。ナッジ理論とは、強制や罰則を用いず、選択の余地を残しながら、より良い行動や意思決定が自発的にできるように環境や選択肢をデザインし、自然と望ましい方向に促していく緩やかなアプローチです。

AI活用においては、効率性を一つの指標として提示することで、ユーザーを自然とエネルギー効率の高い選択肢に誘導します。例えば、単にトークン数やアウトプットの品質だけでなく、「このタスクではこれくらいのエネルギーを消費します」という情報を提示することで、より効率的な選択を促進できます。

3. ハードウェアの最適利用とバッチ処理

すべての処理をリアルタイムで行う必要はありません。モデルの常時稼働が不要なケースも多く存在し、バッチサイズの調整によってエネルギー効率を大幅に改善できます。

全ての処理をリアルタイムで実行するのではなく、バッチ処理で十分な場合は積極的にバッチ処理を採用することで、計算資源の効率的な活用が可能になります。これは特に、大量のデータを定期的に処理する業務において効果的です。

4. エネルギー透明性のインセンティブ化

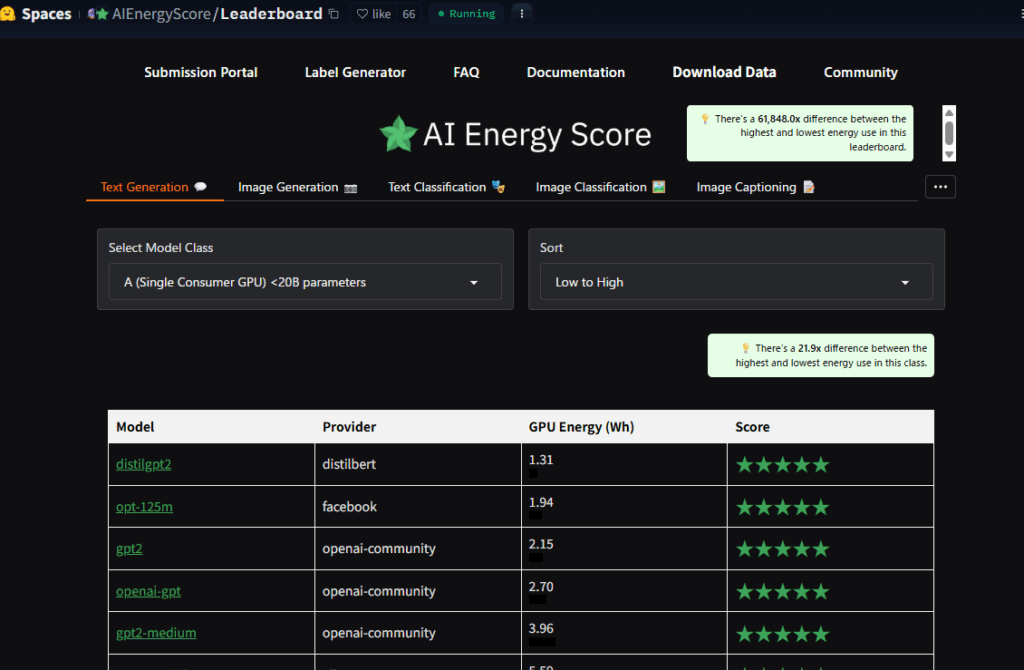

Hugging FaceはAIエナジースコアを導入し、エネルギー効率を可視化することを提案しています。このスコアは、GPUの消費電力を判定し、消費量に基づいて相対的な評価を行います。

具体的な数値ではなく、タスクの規模や内容によって変わる特性を考慮し、規模別の相対評価を実施します。このような透明性の確保により、「より多くの計算資源が良い」という固定観念を見直すきっかけを提供しています。

5. 効率をデフォルトにする設計思想

システム設計において、AI機能が不要な部分ではデフォルトでAIを使用しない設定にすることで、無駄なエネルギー消費を防ぎます。必要な時にのみAI機能を活用する「効率ファースト」の設計思想が重要です。

企業におけるAI活用の現状と今後の展望

現在の企業AI活用において重要な転換点が見えています。Generative AIは一般的な用途での有用性を示していますが、汎用モデルはコストが高く、即戦力として使用するには多くの調整が必要という課題があります。

一方で、企業は汎用的なAGI(Artificial General Intelligence)ではなく、特定のタスクに特化した特定機能を求めているのが実情です。用途を絞れば、汎用型でなくても高い性能を示すことが多く、蒸留技術の重要性がここでも浮き彫りになります。

実装における企業規模別の考慮点

大規模企業での活用可能性

これらの効率化戦略が最も効果を発揮するのは、相当大規模でトランザクション数が多い環境です。何千万、何億というレベルのコスト削減につながる可能性があり、しっかりと実装できればトランザクションコストの大幅な削減が実現できます。

特に、AccentureやGMOインターネットグループのような大きなシステムを構築・運用する企業では、このような効率化の論点が重要になります。システムの中にAIを組み込み、特定の処理(分類、要約、抽出、データ変換など)を何千、何万、何億という処理数で実行する場合、処理コストを下げる取り組みの価値は計り知れません。

中小企業での適用課題

一方で、現在の単発的で用途が異なる現場レベルでの活用においては、タスク特化したモデルを作成することは難しいのが現実です。中小規模のベンダーでは、大規模な仕組みを構築する機会が少ないため、これらの知見を活かす場所が限定的になる可能性があります。

ただし、将来的には多くの企業が段階的にAIエージェントやシステム統合を進めていくと予想されるため、ルールベースのプログラムと一部タスク特化のAIを組み合わせた柔軟な判断システムの構築が重要になってきます。

今後の展望:段階的なAI統合戦略

企業のAI活用は、以下のような段階的な進化を辿ると考えられます:

- 第1段階:汎用的なAIツールの部分的導入

- 第2段階:特定業務プロセスへのタスク特化AI導入

- 第3段階:システム全体への効率的AI統合

この進化過程において、Hugging Faceが提唱する5つのポイントは、第2段階から第3段階への移行において特に重要な指針となります。

まとめ

Hugging Faceが提唱する効率的なAI活用戦略は、以下の重要なポイントに集約されます:

- タスク特化型モデルの活用:汎用モデルの20~30倍のエネルギー効率を実現

- ナッジ理論の導入:自然な効率化誘導によるユーザー行動の最適化

- バッチ処理の積極活用:リアルタイム処理の必要性を見直し、効率的な処理方式を選択

- エネルギー透明性の確保:AIエナジースコアによる効率性の可視化

- 効率ファーストの設計:不要なAI機能をデフォルトで無効化

これらの戦略は、特に大規模なトランザクションを扱う企業において大きなコスト削減効果をもたらします。中小企業においても、将来的なAI統合を見据えて、これらの知見を段階的に取り入れていくことが重要です。

「何でもかんでも大きなAI」から「適材適所の効率的AI」への転換は、単なるコスト削減を超えて、持続可能なAI活用の基盤を築く重要な戦略転換と言えるでしょう。

よくある質問(FAQ)

Q1 タスク特化型AIモデルとは何ですか?

タスク特化型AIモデルとは、特定のタスク(例えば、テキストの要約や特定のデータ分類)に最適化された小規模なAIモデルのことです。汎用的な大規模モデルと比較して、エネルギー効率が20~30倍高い場合もあり、AI運用コストの削減に貢献します。

Q2 AIエナジースコアとは何ですか?

AIエナジースコアは、Hugging Faceが提供する、AIモデルのエネルギー効率を可視化するための指標です。GPUの消費電力を基準にモデルを評価し、リーダーボードで公開することで、開発者や企業がモデル選択時にエネルギー消費を考慮できるようにします。

Q3 ナッジ理論とは、AI活用においてどのように役立ちますか?

ナッジ理論は、強制や罰則を用いずに、ユーザーがより良い選択肢を選べるように促す手法です。AI活用においては、例えば、各タスクのエネルギー消費量を提示することで、ユーザーがより効率的なAIモデルや処理方法を自発的に選択するように誘導できます。

Q4 大規模企業がAI活用でコスト削減を実現するための具体的な方法は?

大規模企業では、トランザクションコストが大きいため、タスク特化型モデルの活用、バッチ処理の積極的な採用、AIエナジースコアによるモデル選択などが有効です。特に、分類、要約、抽出などの処理を大量に行う場合に、これらの戦略を組み合わせることで大幅なコスト削減が期待できます。

Q5 中小企業がAI活用で効率化を進める上での課題は何ですか?

中小企業では、大規模なシステム構築の機会が少ないため、タスク特化型モデルを作成しにくいという課題があります。しかし、将来的にはAIエージェントやシステム統合が進むと予想されるため、ルールベースのプログラムと一部タスク特化のAIを組み合わせた柔軟な判断システムの構築が重要になります。

この記事の著者

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&『ChatGPT最強の仕事術』著者。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。