Gemma 3 270M登場!超軽量AIモデルの実力とファインチューニング活用法

Googleが新たにリリースした「Gemma 3 270M」は、わずか2.7億パラメータという超軽量サイズでありながら、日本語処理も可能な注目のAIモデルです。従来の小規模モデルでも30億パラメータが一般的だった中、この圧倒的な軽量性は、スマートフォンでも動作する可能性を秘めています。

このモデルの最大の特徴は、ファインチューニング前提で設計されていることです。つまり、特定のタスクに特化させることで真価を発揮する設計となっており、AI人材にとってファインチューニングスキルの重要性がますます高まっていることを示しています。

本記事では、Gemma 3 270Mの実際の動作検証結果から、ファインチューニングの実践的な活用方法まで、AI人材として知っておくべき重要なポイントを詳しく解説します。

目次

Gemma 3 270Mとは?超軽量AIモデルの革新性

Gemma 3 270Mは、Googleが2025年8月にリリースしたファインチューニング専用に設計されたコンパクトなモデルです。「270M」という数字は2億7000万パラメータを意味し、これは従来の小規模モデルと比較しても圧倒的に軽量です。

通常、小規模なAIモデルでも3B(30億パラメータ)程度が一般的でしたが、Gemma 3 270Mはその約10分の1のサイズを実現しています。この軽量性により、低電力での動作が可能となり、スマートフォンなどのモバイルデバイスでも実用的に使用できるレベルに到達しています。

モデルの設計思想として、「タスクに特化したファインチューニングのために一から設計されたコンパクトなモデル」として位置づけられており、強力な命令追従機能とテキスト構造化が事前にトレーニングされています。

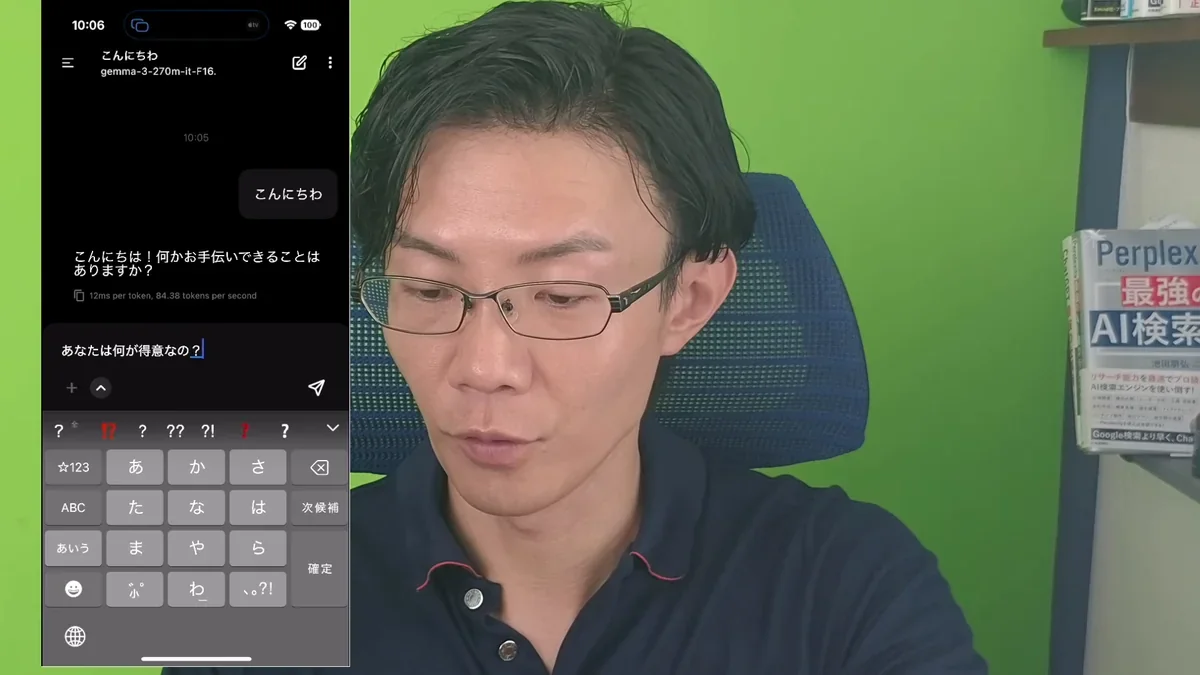

実際の動作検証:驚異的な処理速度と日本語対応

実際にGemma 3 270Mを動作させてみると、その処理速度の速さに驚かされます。ローカル環境での動作テストでは、質問に対する回答が瞬時に返ってくるレベルの高速処理を実現しています(ぜひ後半にある動画もご覧ください!)

特に注目すべきは日本語処理能力です。「こんにちは」という日本語の挨拶に対しても適切に応答し、「あなたは何が得意なの?」といった質問にも日本語で回答します。英語前提のモデルかと予想されましたが、実際には日本語でのやり取りも十分に可能であることが確認できました。

ファイルサイズは約543MBと非常にコンパクトで、Wi-Fi環境でのダウンロードも短時間で完了します。この軽量性により、ローカル環境での実行時も高速な応答を実現しています。

ファインチューニング前提の設計思想とその意味

Gemma 3 270Mの最も重要な特徴は、ファインチューニング前提で設計されている点です。これは単体で完璧な性能を発揮するのではなく、特定のタスクに特化させることで真価を発揮するという設計思想を表しています。

小規模な言語モデルは、どうしても汎用性では大規模モデルに劣るため、用途を特化しないと性能が十分に発揮されません。そのため、ファインチューニングによって特定のタスクに最適化することが前提となっています。

この設計思想は、AI活用の実用性を重視したアプローチと言えます。企業や個人が実際に使用する場面では、汎用的な能力よりも特定の業務に特化した高い精度の方が価値があることが多いためです。

ファインチューニングの実践的な進め方

Gemma 3 270Mでファインチューニングを実施する際の基本的なステップは以下の通りです:

- 開発環境のセットアップ:必要なライブラリとツールの準備

- 学習データの準備:タスクに応じたインプット・アウトプットデータの整理

- ベース処理の実装:データの前処理とフォーマット調整

- モデルの設定と実行:ファインチューニングパラメータの調整と学習実行

ファインチューニングを成功させるためには、あるタスクにおけるインプットとアウトプットを明確に整理し、質の高い学習データを作成することが重要です。このデータは、プロンプトエンジニアリングでも活用できるため、丁寧に作成・保存しておくことで、将来的な活用の幅も広がります。

実用的な活用シーンと可能性

Gemma 3 270Mの軽量性と高速処理能力は、様々な実用的なシーンでの活用可能性を示しています。例えば、以下のような用途が考えられます:

| 活用シーン | 具体例 | メリット |

| 社内業務支援 | 特定フォーマットでの文書作成、データ整理 | 高速処理により業務効率が大幅向上 |

| モバイルアプリ組み込み | リアルタイム翻訳、テキスト要約 | オフライン動作可能で通信コスト削減 |

| エッジデバイス活用 | IoTデバイスでの自然言語処理 | 低電力動作でバッテリー寿命延長 |

特に注目すべきは、スマートフォンでも楽勝で使えるレベルの軽量性です。これにより、クラウドAPIに依存せずローカルで高速なAI処理が可能となり、プライバシー保護やコスト削減の観点からも大きなメリットがあります。

AI人材に求められるファインチューニングスキル

Gemma 3 270Mのようなファインチューニング前提のモデルの登場は、AI人材にとってファインチューニングスキルが必須になることを示しています。これは単なる技術的なスキルではなく、ビジネス価値を創出するための重要な能力です。

ファインチューニングスキルを身につけることで、以下のような価値を提供できるようになります:

- 特定業務への最適化:汎用モデルでは実現できない高精度な業務支援

- コスト効率の向上:大規模モデルのAPI利用コストを大幅削減

- プライバシー保護:機密データをクラウドに送信せずローカル処理

- カスタマイズ性:企業固有のルールや知識をモデルに組み込み

これらのスキルは、今後のAI活用において差別化要因となる重要な能力と考えられます。

データ準備の重要性と将来への投資

ファインチューニングを効果的に行うためには、質の高い学習データの準備が不可欠です。このデータ準備は、単にファインチューニングのためだけでなく、将来的な様々なAI活用の基盤となる重要な資産です。

適切に整理されたインプット・アウトプットデータは、以下の用途で活用できます:

- プロンプトエンジニアリング:GPT-4やGemini等の大規模モデルでの活用

- 複数モデルでの比較検証:最適なモデル選択のための評価データ

- 継続的な改善:モデル性能向上のためのベンチマークデータ

このように、データ準備への投資は長期的な視点で大きなリターンをもたらす重要な取り組みと言えます。

まとめ

Gemma 3 270Mの登場は、AIモデルの軽量化と特化型活用の新たな可能性を示しています。主要なポイントをまとめると以下の通りです:

- 超軽量設計:2.7億パラメータでスマートフォンでも動作可能

- 高速処理:ローカル環境でも瞬時の応答を実現

- 日本語対応:英語前提ながら日本語でのやり取りも可能

- ファインチューニング前提:特定タスクへの特化で真価を発揮

- 実用的な活用可能性:業務効率化からモバイルアプリまで幅広い用途

- AI人材の必須スキル:ファインチューニング能力の重要性が増大

- データ準備の価値:将来的なAI活用の基盤となる重要な投資

AI技術の進歩により、大規模で汎用的なモデルだけでなく、軽量で特化型のモデルも重要な選択肢となってきています。Gemma 3 270Mのようなモデルを適切に活用できるスキルは、今後のAI人材にとって必須の能力となるでしょう。

よくある質問(FAQ)

Q1 Gemma 3 270Mとは何ですか?

Gemma 3 270Mは、Googleが開発した軽量なAIモデルです。わずか2.7億パラメータというサイズでありながら、日本語処理も可能です。特にファインチューニングを前提として設計されており、特定のタスクに特化させることで高い性能を発揮します。スマートフォンなどのモバイルデバイスでも動作する可能性があります。

Q2 Gemma 3 270Mは日本語に対応していますか?

はい、Gemma 3 270Mは日本語に対応しています。「こんにちは」のような挨拶や「あなたは何が得意なの?」といった質問にも日本語で応答できます。英語を前提としたモデルと予想されていたものの、実際には日本語でのやり取りも十分に可能です。

Q3 Gemma 3 270Mを使うには何が必要ですか?

Gemma 3 270Mはファインチューニングを前提としているため、利用するには開発環境のセットアップ、学習データの準備、データの前処理、モデルの設定と実行が必要です。Hugging Face Transformersなどのライブラリを利用して、タスクに応じた学習データでモデルを調整します。

Q4 Gemma 3 270Mのファイルサイズはどれくらいですか?

Gemma 3 270Mのファイルサイズは約543MBと非常にコンパクトです。Wi-Fi環境であれば短時間でダウンロードが完了します。この軽量性により、ローカル環境での実行時も高速な応答が期待できます。

Q5 Gemma 3 270Mはどのような活用シーンが考えられますか?

Gemma 3 270Mは、社内業務支援(文書作成、データ整理)、モバイルアプリへの組み込み(リアルタイム翻訳、テキスト要約)、エッジデバイスでの活用(IoTデバイスでの自然言語処理)など、様々なシーンで活用できます。特にスマートフォンでも動作する軽量性が強みです。

この記事の著者

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&『ChatGPT最強の仕事術』著者。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。