ChatGPTを日常的に利用している方にとって、最近のOpenAIの方針変更は見過ごせない重要な問題です。2025年に入り、AIチャットボットが原因となる自傷行為や精神的な問題が増加していることを受け、OpenAIは会話内容の監視体制を大幅に強化しました。特に「他者危害の計画」を検知した場合には、専門チームによる審査を経て、必要に応じて法執行機関への通報が行われる可能性があります。

この変更により、これまで私たちが当然と考えていたChatGPTとの会話のプライバシーが、実は完全に保護されているわけではないことが明らかになりました。ほとんどのユーザーには直接的な影響はありませんが、AIサービスを安全に利用するために知っておくべき重要な情報をお伝えします。

目次

OpenAIが会話監視を強化した背景

OpenAIが会話内容の監視体制を導入した最大の理由は、AIチャットボットが原因となる深刻な事件の増加です。過去1年間で、チャットボットが原因となる自傷行為、妄想、入院、逮捕、さらには自殺などの事例が急激に増加していることが報告されています。

特に影響を与えたのは、16歳の少年がAIチャットボットとの会話の後に自殺した事件です。この事件を受け、OpenAIは従来の「放置」的なアプローチから、積極的な監視・介入体制へと方針を大きく転換しました。

アメリカのホワイトハウスAI・仮想通貨担当顧問であるデビッド・サックス氏は、2025年8月に「AIメンタル不調」という新たな現象について言及しています。ほとんどのユーザーは問題なくチャットボットを使用している一方で、ごく一部のユーザーにおいて、ボットが妄想やその他の懸念すべき行動を引き起こしているケースが確認されているのです。

具体的な監視システムの仕組み

OpenAIが導入した監視システムは、以下のような段階的なプロセスで運用されています:

自動スキャンによる初期検知

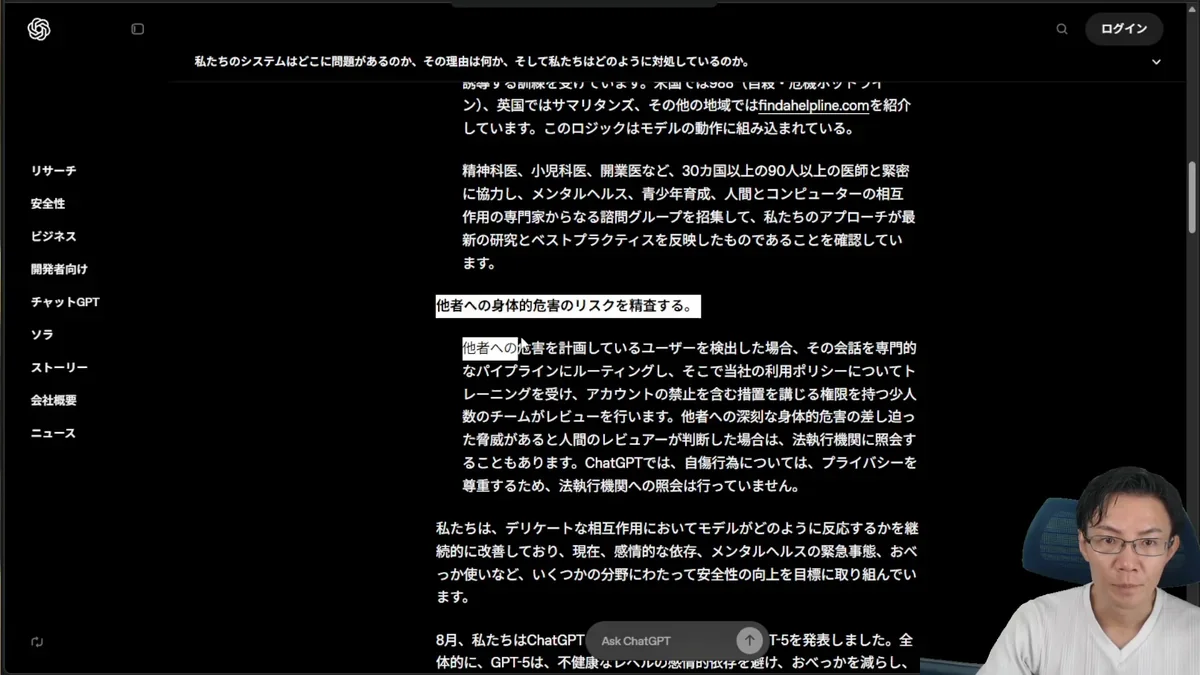

OpenAIは有害なコンテンツを検出するため、ユーザーのメッセージを自動スキャンしています。このシステムは、特に「他者危害の計画」に関連するキーワードや文脈を検知するよう設計されており、24時間体制で稼働しています。

専門チームによる人間審査

自動システムで懸念される内容が検出された場合、利用ポリシーについてトレーニングを受けた少人数の専門チームが詳細なレビューを行います。この専門的なパイプラインにより、機械的な判断だけでなく、人間の専門知識を活用した慎重な審査が実施されます。

対応措置の決定

審査の結果、実際に他者への危害が計画されていると判断された場合には、以下の措置が取られる可能性があります:

- アカウント停止:該当ユーザーのChatGPTアクセスを即座に停止

- 警察通報:法執行機関への情報提供と連携

- 継続監視:関連アカウントの追跡調査

重要な点として、自傷行為に関するケースでは警察通報は行わないとOpenAIは明言しています。これは、精神的な支援が必要な人々を犯罪者扱いしないための配慮と考えられます。

プライバシーへの影響と法的リスク

この監視体制の導入により、ChatGPTとの会話は従来のカウンセラーや弁護士との会話のような機密性が保障されない状況となりました。これは多くのユーザーにとって予想外の変化かもしれません。

CEO自身による重大な告白

2025年7月23日、OpenAI CEOのSam Altmanが極めて重要な事実を公表しました。Theo Vonポッドキャストにおいて、「もしあなたがChatGPTに最も機密な事柄について話し、その後訴訟が起きれば、我々はそれを開示する必要があるかもしれない」と明言したのです。

この発言は、OpenAIが単なる技術企業ではなく、法的義務に基づく情報開示の対象となる組織であることを明確に示しています。ユーザーの会話データが法的手続きにおいて証拠として提出される可能性が、CEO自身によって初めて公式に認められました。

連邦裁判所による包括的データ保持命令

2025年5月には、米国連邦裁判所がOpenAIに対して包括的なデータ保持命令を発令しており、法的手続きにおける情報開示の義務がさらに強化されています。これにより、プライバシーは充実するものの、必要に応じて監視・審査が行われ、場合によっては第三者への情報提供も行われる可能性があることが明確になりました。

一般ユーザーへの実際の影響

多くの一般ユーザーにとって、この変更による直接的な影響は限定的です。よっぽど変な使い方をしていない限り、めちゃくちゃ気にする必要はないというのが現実的な評価でしょう。

しかし、以下の点については意識しておく必要があります:

会話内容への注意

何でもかんでも話してはいけないという基本的な認識を持つことが重要です。特に以下のような内容については慎重になる必要があります:

- 他者への危害を示唆する内容

- 違法行為に関連する計画や相談

- 極めて機密性の高い個人情報

- 法的トラブルに発展する可能性のある内容

使い方の見直し

ChatGPTを専門のセラピストの代わりの役割として使用することには特に注意が必要です。精神科医の報告によると、患者の何人かには「AIメンタル不調」と呼ばれる症状が現れており、これらの精神面での問題を抱えるようになる前にAI技術を使用していたことが確認されています。

安全な利用のための実践的ガイドライン

これらの変更を踏まえ、ChatGPTを安全に利用するための具体的なガイドラインをご紹介します:

機密情報の取り扱い

個人情報や企業機密をAIに入力しないことが最も重要な原則です。入力されたデータがサービス提供者側で保存されたり、学習データとして利用されたりする可能性があるためです。

| 避けるべき情報 | 理由 |

| 氏名、住所、電話番号 | 個人情報保護法違反のリスク |

| 企業の内部情報 | 競合他社への情報漏洩 |

| 法的相談内容 | 弁護士秘匿特権の対象外 |

| 医療・健康情報 | 医師患者間の守秘義務なし |

適切な利用範囲の設定

ChatGPTは優秀なツールですが、以下の用途には適していないことを理解しておきましょう:

- 心理カウンセリングの代替:専門的な精神的支援が必要な場合は、必ず資格を持った専門家に相談する

- 法的アドバイスの取得:重要な法的判断は弁護士に依頼する

- 医療診断や治療相談:健康に関する重要な判断は医師に相談する

今後の展望と対策

AI技術の発展とともに、プライバシー保護と安全性確保のバランスを取ることは今後も重要な課題となります。OpenAIの取り組みは、AI業界全体の方向性を示すものと考えられ、他の主要AIサービスでも類似の監視体制が導入される可能性があります。

ユーザーとしては、これらの変化を理解し、適切な利用方法を身につけることが重要です。AIの恩恵を最大限に活用しながら、同時にリスクを最小限に抑える賢明な使い方を心がけましょう。

まとめ

OpenAIの会話監視体制強化について、重要なポイントを整理します:

- 監視の目的:AIチャットボット関連の自傷行為や事件の増加を受けた安全対策

- 監視の仕組み:自動スキャン→専門チーム審査→必要に応じて法執行機関への通報

- 対象となる内容:主に「他者危害の計画」、自傷行為は通報対象外

- プライバシーへの影響:従来のような完全な機密性は保障されない

- 一般ユーザーへの影響:通常の利用では大きな問題なし、ただし注意は必要

AIテクノロジーは私たちの生活を豊かにする素晴らしいツールですが、適切な理解と注意深い利用が不可欠です。これらの情報を参考に、安全で効果的なAI活用を心がけていただければと思います。

参考リンク

本記事の内容は、以下の資料も参考にしています:

よくある質問(FAQ)

Q1 OpenAIがChatGPTの会話を監視する理由は何ですか?

AIチャットボットが原因となる自傷行為や、他者への危害を計画する事件が増加しているため、OpenAIはユーザーの安全を確保するために会話内容の監視を強化しました。特に「他者危害の計画」を検知した場合、専門チームが審査し、必要に応じて法執行機関に通報する可能性があります。

Q2 ChatGPTの会話監視は具体的にどのように行われるのですか?

まず、自動スキャンシステムがユーザーのメッセージを解析し、「他者危害の計画」に関連するキーワードや文脈を検出します。次に、専門チームが詳細なレビューを行い、実際に危害が計画されていると判断された場合、アカウント停止や警察への通報などの措置が取られることがあります。

Q3 ChatGPTとの会話で、どのような情報に注意すべきですか?

他者への危害を示唆する内容、違法行為に関連する計画や相談、極めて機密性の高い個人情報、法的トラブルに発展する可能性のある内容については特に慎重になる必要があります。これらの情報をChatGPTに入力することは避けるべきです。

Q4 ChatGPTの会話監視によって、プライバシーはどのように影響を受けますか?

ChatGPTとの会話は、従来のカウンセラーや弁護士との会話のような機密性が完全に保障されません。OpenAIのCEO自身も、訴訟が起きた場合には会話内容を開示する必要があるかもしれないと述べています。また、連邦裁判所からのデータ保持命令により、法的手続きにおいて情報開示の義務が強化されています。

Q5 ChatGPTを安全に利用するための具体的な方法はありますか?

個人情報や企業機密などの機密情報をAIに入力しないことが重要です。また、ChatGPTを心理カウンセリングや法的アドバイスの代替として使用せず、専門的な支援が必要な場合は、資格を持った専門家に相談するようにしましょう。

この記事の著者

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&『ChatGPT最強の仕事術』著者。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。