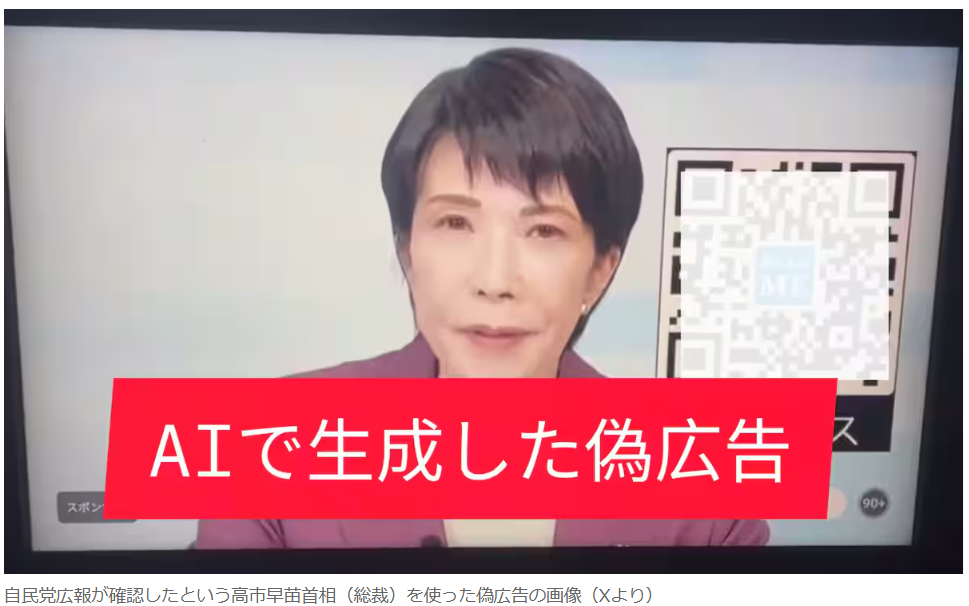

高市早苗氏のAI偽動画詐欺に注意!政治家を狙うディープフェイク詐欺の手口と対策

最近、高市早苗氏のAI偽動画を使った詐欺が確認され、自民党がX(旧Twitter)で注意喚起を行いました。この事件は、政治家の顔や声を悪用したディープフェイク詐欺の新たな脅威を浮き彫りにしています。

ディープフェイク技術の進歩により、誰でも簡単に政治家や著名人の偽動画を作成できるようになった今、私たちはどのようにこれらの詐欺から身を守ればよいのでしょうか。この記事では、政治家を標的としたAI偽動画詐欺の実態と、個人でできる対策について詳しく解説します。

目次

政治家を狙うディープフェイク詐欺の実態

今回の高市早苗氏の事例は、政治家の信頼性を悪用した新しい形の詐欺手法です。詐欺師たちは、政治家の公開されている映像や音声を使ってAI技術で偽動画を作成し、投資詐欺や商品販売などの悪質な広告に利用しています。

このような詐欺が増加している背景には、ディープフェイク作成技術の民主化があります。以前は高度な技術知識が必要だったディープフェイク作成が、現在では無料のオンラインツールを使って数分で可能になっています。

ディープフェイク技術の仕組みと危険性

ディープフェイクは、「深層学習(Deep Learning)」と「偽物(Fake)」を組み合わせた造語で、AI技術を使って作成された偽の画像、動画、音声を指します。

特に政治家を標的とした場合、以下のような深刻な問題が発生します:

- 選挙への影響:偽の発言動画により有権者の判断が歪められる可能性

- 社会的信頼の失墜:政治家個人だけでなく、政治制度全体への不信を招く

- 詐欺被害の拡大:政治家の権威を悪用した投資詐欺や商品販売

AI偽動画詐欺の典型的な手口

政治家を悪用したディープフェイク詐欺には、いくつかの典型的なパターンがあります。最も多いのは投資詐欺で、政治家が特定の投資商品や暗号通貨を推奨しているかのような偽動画を作成し、視聴者を騙して金銭を詐取する手口です。

また、商品販売詐欺も増加しており、政治家が健康食品や美容商品を愛用しているかのような偽の証言動画を作成し、商品を販売する事例も報告されています。これらの詐欺は、政治家の社会的信頼性を悪用することで、通常の広告よりも高い説得力を持ってしまいます。

さらに深刻なのは、政治的な偽情報の拡散です。選挙期間中に候補者の偽の発言動画を拡散することで、有権者の判断を意図的に歪める可能性があります。2024年の世界各国の選挙では、このような事例が実際に確認されており、民主主義の根幹を揺るがす脅威として認識されています。

ディープフェイクを見分ける7つのポイント

完璧にディープフェイクを見分けることは専門家でも困難ですが、以下のポイントに注意することで、i一定の偽動画を識別できます:

| チェックポイント | 具体的な確認方法 |

| まばたきの不自然さ | まばたきが少なすぎる、または多すぎる場合は要注意 |

| 顔の輪郭 | 顔の境界線がぼやけている、または不自然に鮮明 |

| 照明の一貫性 | 顔の照明が背景や体と一致しているか確認 |

| 音声と口の動き | 話している内容と唇の動きが完全に同期しているか |

| 眼球の反射 | 両目の光の反射が一致しているか(ディープフェイクは苦手な部分) |

| 髪の毛の動き | 髪の毛の動きが不自然、または静止している |

| 背景音の一貫性 | 音声全体を通して背景音が一定かどうか |

ただし、これらの手法も完璧ではありません。AI技術の進歩により、これらの問題点も徐々に改善されているため、複数の確認方法を組み合わせることが重要です。

個人でできる対策と防御方法

ディープフェイク詐欺から身を守るためには、以下の対策を実践することをお勧めします:

情報源の確認を徹底する

政治家が何かを推奨している動画を見つけた場合、まず公式チャンネルや信頼できるニュースソースで同じ情報が報じられているかを確認してください。政治家の公式ウェブサイトやSNSアカウントで、該当する発言や推奨があるかをチェックすることも重要です。

検索とファクトチェックの活用

疑わしい動画を見つけたら、その内容について検索エンジンで調べてみてください。「高市早苗 投資 詐欺」のようなキーワードで検索すると、同様の詐欺について警告する記事が見つかる可能性があります。また、ファクトチェック機関の情報も積極的に活用しましょう。

専用ツールの活用

現在、いくつかのディープフェイク検出ツールが一般向けに提供されています:

- Deepware Scanner:動画をアップロードしてディープフェイクかどうかを判定

- Microsoft Video Authenticator:マイクロソフトが開発した検出ツール

- Sensity AI:リアルタイムでディープフェイクを検出

ただし、これらのツールも100%の精度ではないため、他の確認方法と併用することが大切です。

家族や周囲の人を守るための教育

ディープフェイク詐欺の被害を防ぐためには、家族や友人への教育も重要です。特に高齢者は、このような新しい詐欺手法について知識が不足している場合が多く、被害に遭いやすい傾向があります。

家族間で「合言葉」を決めておくことも効果的です。電話で家族を名乗る人物から金銭の要求があった場合、事前に決めておいた合言葉を確認することで、AI音声を使った詐欺を防ぐことができます。

また、SNSでの情報共有にも注意が必要です。疑わしい動画を見つけても、確認せずに拡散してしまうと、詐欺の片棒を担ぐことになってしまいます。「シェアする前に確認する」習慣を身につけることが大切です。

まとめ:冷静な判断と継続的な学習が鍵

高市早苗氏のAI偽動画詐欺事件は、ディープフェイク技術が身近な脅威となったことを示しています。この技術は今後さらに精巧になり、見分けることがより困難になると予想されます。

重要なのは、以下の点を常に心がけることです:

- 情報源の確認:公式チャンネルや信頼できるソースでの裏取り

- 複数の視点での検証:一つの情報源だけでなく、複数の角度から確認

- 技術的な知識の更新:ディープフェイク技術と対策の最新動向を把握

- 家族・友人との情報共有:詐欺手法について周囲の人と情報を共有

- 慎重な情報拡散:確認せずに情報をシェアしない

ディープフェイク技術は悪用される一方で、エンターテインメントや教育分野での有益な活用も期待されています。技術そのものを恐れるのではなく、正しい知識を身につけて適切に対処することが、デジタル社会を安全に生きるための鍵となります。

今回の事件を機に、私たち一人ひとりがデジタルリテラシーを向上させ、新しい形の詐欺に対する警戒心を持つことが重要です。技術の進歩に合わせて、私たちの対策も進化させていく必要があります。

参考リンク

本記事の作成にあたり、以下の情報源も参考にしています:

- 産経新聞:高市早苗氏のAI偽動画に関する報道

- Wikipedia: Deepfake (英語)

- TechTarget: What is Deepfake Technology? (英語)

- MIT Sloan: Deepfakes, explained (英語)

- World Economic Forum: Deepfakes are here to stay and we should remain vigilant (英語)

よくある質問(FAQ)

Q1 ディープフェイク詐欺とは何ですか?

ディープフェイク詐欺とは、AI技術を使って作成された偽の動画や音声を悪用した詐欺のことです。政治家や著名人の顔や声を使い、投資詐欺や商品販売詐欺、政治的な偽情報の発信などに利用されます。巧妙に作られているため、見分けるのが難しいのが特徴です。

Q2 ディープフェイク動画を見分けるにはどうすればいいですか?

ディープフェイク動画を見分けるポイントはいくつかあります。まばたきの不自然さ、顔の輪郭のぼやけ、照明の一貫性の欠如、音声と口の動きのずれ、眼球の反射の不一致、髪の毛の不自然な動き、背景音の不自然さなどに注意しましょう。複数のチェックポイントを組み合わせることが重要です。

Q3 AI偽動画詐欺に騙されないために、個人でできる対策はありますか?

AI偽動画詐欺から身を守るためには、情報源の確認を徹底し、公式チャンネルや信頼できるニュースソースで情報を裏付けましょう。疑わしい動画については、検索エンジンで調べたり、ファクトチェック機関の情報を活用することも有効です。また、ディープフェイク検出ツールを利用するのも一つの手段です。

Q4 家族が高齢ですが、AI偽動画詐欺から守るために何ができますか?

高齢者はAI偽動画詐欺の被害に遭いやすい傾向があるため、注意が必要です。家族間で合言葉を決めておき、電話などで金銭を要求された際に確認することで、詐欺を防ぐことができます。また、疑わしい情報を見ても、安易に拡散しないように注意を促しましょう。

Q5 ディープフェイクの検出ツールにはどのようなものがありますか?

一般的に利用できるディープフェイク検出ツールとして、Deepware Scanner、Microsoft Video Authenticator、Sensity AIなどがあります。これらのツールは動画をアップロードしてディープフェイクかどうかを判定できますが、100%の精度ではないため、他の確認方法と併用することが大切です。

この記事の著者

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&『ChatGPT最強の仕事術』著者。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。