ChatGPTの音声とテキスト統合機能が変える未来:実際の使用感と活用シーンを徹底解説

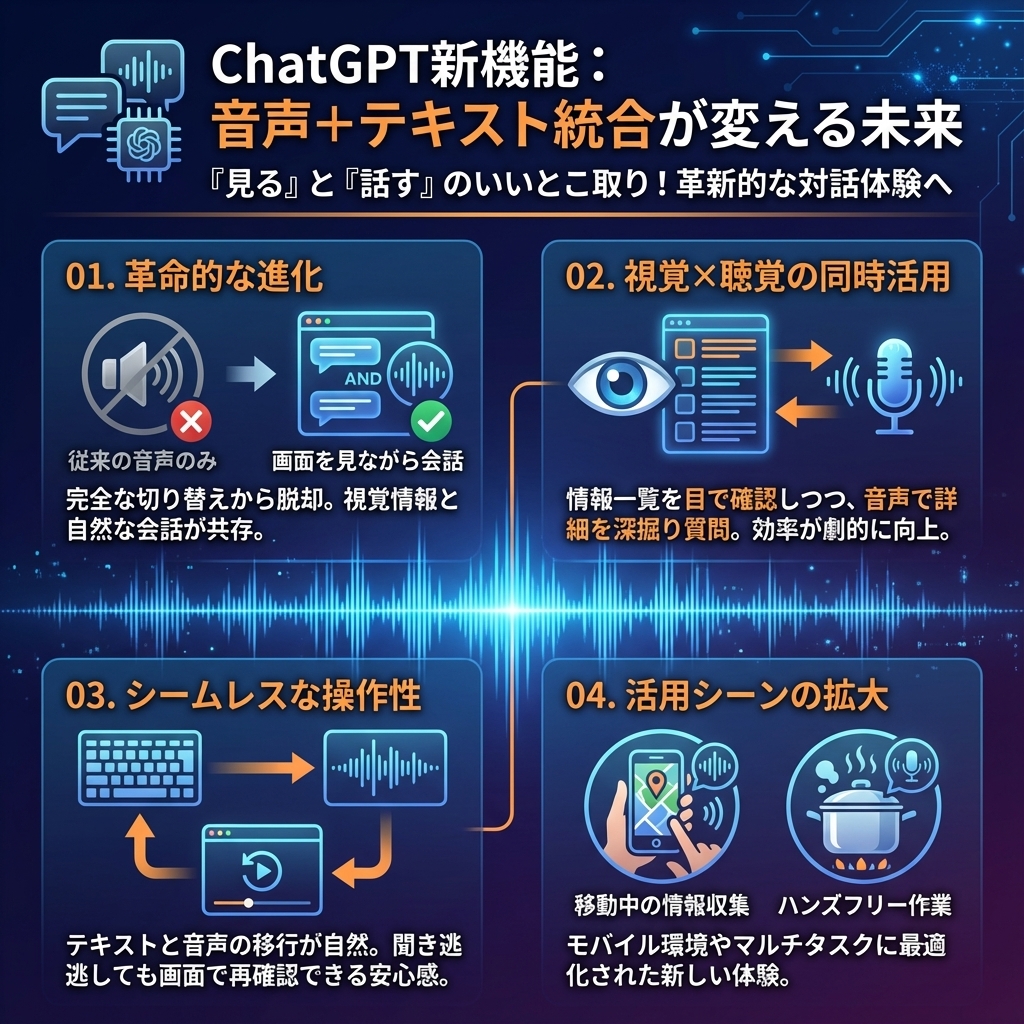

ChatGPTに新たな機能が追加され、従来の音声モードとは異なる革新的な体験が可能になりました。これまでの音声モードは完全に音声のみの会話に切り替わる仕組みでしたが、今回のアップデートではチャット画面を見ながら音声で会話ができるという、まさに「いいとこ取り」の機能が実現されています。

この新機能により、視覚的な情報と音声による自然な対話が同時に活用できるようになり、情報収集や問題解決の効率が大幅に向上しています。実際に使用してみると、従来の音声のみのモードよりも圧倒的に使いやすく、実用性の高い体験を提供してくれることがわかりました。

本記事では、この新しい統合機能の実際の使用感、具体的な活用シーン、そして今後のAIインターフェースの可能性について詳しく解説していきます。

目次

ChatGPTの新しい音声・テキスト統合機能とは

従来のChatGPTの音声モードは、完全に音声のみの会話に切り替わる仕組みでした。しかし、新しい機能ではチャット画面を表示したまま音声での会話が可能になっています。これは単なる機能追加ではなく、ユーザーインターフェースの根本的な改善と言えるでしょう。

具体的には、以下のような特徴があります:

- 視覚情報の継続表示:会話中もテキストベースの回答や一覧情報が画面に表示され続ける

- シームレスな切り替え:テキスト入力から音声入力への移行が自然に行える

- 情報の並行処理:音声で質問しながら、画面上の情報を同時に確認できる

この統合アプローチにより、ユーザーは音声の自然さとテキストの視認性という、両方のメリットを同時に享受できるようになりました。

実際の使用体験:渋谷のイタリアンレストラン検索を例に

新機能の実用性を確認するため、「渋谷でランチ、3000円くらいのイタリアン」という具体的なリクエストで試してみました。その結果、以下のような優れた体験を得ることができました。

音声での自然な問い合わせ

「渋谷でランチで3000円くらいのイタリアンを食べたいんだけど、店探してくれる?」という自然な話し言葉での問い合わせに対し、ChatGPTは即座に「ピッチャリアメリプリンチペッサ渋谷店」などの具体的な店舗を提案してくれました。

追加質問による深掘り

「何でおすすめなの?」という追加の質問に対しても、「2000円くらいで気軽においしいピッチャーやパスタが楽しめるお店として人気」という具体的な理由を音声で回答。この際、画面には店舗情報が表示され続けているため、音声での会話と視覚的な情報確認を同時に行えるという大きなメリットを実感できました。

関連情報の展開

さらに「イタリアンを楽しむためにはどういう点に注目するといいかね?」という質問では、以下のような実践的なアドバイスを得られました:

- お店の雰囲気や得意な料理に注目する

- ピッツァが売りなら釜焼きの香ばしさを楽しむ

- パスタが得意なお店なら手打ち麺やソースに注目する

- 前菜やデザートもゆっくり味わう

このように、一つの質問から関連する有用な情報まで自然に展開できるのが、音声とテキストの統合機能の大きな魅力です。

従来の音声モードとの決定的な違い

新しい統合機能と従来の音声モードを比較すると、いくつかの重要な違いが明確になります。

情報の視認性向上

従来の音声モードでは、会話が音声のみで進行するため、複雑な情報や一覧データを把握するのが困難でした。しかし、新機能では画面に情報が表示されたまま音声会話ができるため、例えば店舗の一覧を見ながら、その詳細について音声で質問するといった使い方が可能になっています。

会話の流れの改善

音声での会話は非常にスムーズで、文章生成とほぼ同じ速度で応答が得られます。ただし、この速度の速さは時として「見飛ばしがちになる」という課題もあります。しかし、画面に情報が残り続けるため、聞き逃した部分を後から確認できるという安心感があります。

利用シーンの拡大

この統合機能により、以下のような新しい利用パターンが生まれています:

- 文章作成中の音声確認:テキストで作業しながら、一時的に音声で詳細を確認

- 情報収集の効率化:一覧情報を見ながら、気になる項目について音声で深掘り

- マルチタスク対応:手作業をしながら音声で情報を取得

スマートフォンでの活用可能性

この新機能はスマートフォンでも利用可能であり、モバイル環境での活用可能性は非常に高いと考えられます。特に以下のようなシーンでの活用が期待されます:

移動中の情報収集

電車での移動中や歩きながらでも、音声で質問しつつ画面で詳細情報を確認できるため、効率的な情報収集が可能になります。例えば、目的地周辺のレストラン情報を音声で聞きながら、地図や詳細情報を画面で確認するといった使い方ができます。

ハンズフリー操作との組み合わせ

料理中や作業中など、手が離せない状況でも音声で質問し、必要に応じて画面を確認するという柔軟な使い方が可能です。これにより、従来は諦めていたシーンでもAIアシスタントを活用できるようになります。

ビジネス活用における可能性

この統合機能は、ビジネスシーンでも大きな可能性を秘めています。conversational AIの活用事例を参考にすると、以下のような応用が考えられます:

カスタマーサポートの進化

顧客が問題について音声で説明しながら、画面上で関連する資料やFAQを同時に確認できるため、より効率的な問題解決が可能になります。サポート担当者も、顧客との音声会話を続けながら、画面上で必要な情報を検索・確認できます。

営業・プレゼンテーションでの活用

プレゼンテーション中に、資料を表示しながら音声でAIに追加情報を求めたり、質疑応答の補助として活用したりすることが可能です。これにより、より動的で情報豊富なプレゼンテーションが実現できます。

教育・トレーニング分野

学習者が教材を見ながら音声で質問し、即座に回答を得られるため、より効果的な学習体験を提供できます。特に、複雑な概念の理解や実践的なスキルの習得において、大きな効果が期待されます。

技術的な背景と今後の展望

マルチモーダルAI技術の進歩により、このような統合機能が実現されています。音声認識、自然言語処理、そしてユーザーインターフェース設計の技術が組み合わさることで、より自然で効率的な人間とAIの対話が可能になっています。

マルチモーダルAIの進化

2025年に向けて、音声、視覚、テキストを組み合わせたマルチモーダルAIはさらに進化していくと予想されます。今回のChatGPTの機能は、その先駆けとなる重要な一歩と言えるでしょう。

ユーザーエクスペリエンスの向上

従来のAIインターフェースは、テキストか音声かという二択でしたが、今後は両方の利点を活かした統合的なアプローチが主流になると考えられます。これにより、ユーザーは状況に応じて最適な入力・出力方法を選択できるようになります。

実用上の注意点と改善の余地

新機能は非常に有用ですが、実際の使用において気づいた点もあります。

応答速度と情報処理

音声での応答は非常に速く、文章生成とほぼ同等の速度を実現しています。しかし、この速度の速さにより、重要な情報を聞き逃してしまう可能性もあります。幸い、画面に情報が表示され続けるため、この問題は大幅に軽減されています。

コンテキストの維持

音声とテキストを切り替えながら会話を続ける際、文脈が適切に維持されることが重要です。現在の実装では、この点について良好な結果が得られていますが、より複雑な会話においては、さらなる改善の余地があると考えられます。

他のAIサービスとの比較

現在、様々なAIアシスタントが音声機能を提供していますが、ChatGPTの新機能は以下の点で差別化されています:

| 特徴 | ChatGPT統合機能 | 従来の音声AI |

| 視覚情報の継続表示 | ○(画面表示継続) | ×(音声のみ) |

| モード切り替えの必要性 | ×(シームレス) | ○(明示的な切り替え) |

| 複雑な情報の処理 | ○(視覚+音声) | △(音声のみで制限) |

| マルチタスク対応 | ○(柔軟な対応) | △(限定的) |

今後の発展可能性

この統合機能は、AIインターフェースの未来を示唆する重要な進歩です。今後、以下のような発展が期待されます:

より高度な統合機能

音声とテキストに加えて、画像や動画の処理機能が統合されることで、さらに豊富な情報交換が可能になるでしょう。例えば、写真を見せながら音声で説明を求めたり、動画の内容について音声で質問したりといった使い方が実現される可能性があります。

パーソナライゼーションの向上

ユーザーの使用パターンや好みを学習し、音声とテキストの使い分けを自動的に最適化する機能が追加される可能性があります。これにより、個々のユーザーにとって最も効率的なインターフェースが提供されるようになるでしょう。

業界特化型の応用

医療、教育、ビジネスなど、特定の業界に特化した統合機能が開発される可能性があります。例えば、医療分野では患者の症状を音声で説明しながら、関連する医学資料を画面で確認するといった専門的な使い方が実現されるかもしれません。

まとめ

ChatGPTの新しい音声・テキスト統合機能は、AIインターフェースの大きな進歩を示しています。主なポイントを以下にまとめます:

- 革新的なユーザーエクスペリエンス:音声の自然さとテキストの視認性を同時に活用できる

- 実用性の向上:情報収集や問題解決の効率が大幅に改善される

- 柔軟な利用シーン:移動中、作業中など様々な状況で活用可能

- ビジネス活用の可能性:カスタマーサポート、営業、教育など幅広い分野での応用が期待される

- 技術的な先進性:マルチモーダルAI技術の実用的な実装例として注目される

- 今後の発展性:さらなる機能統合やパーソナライゼーションの向上が期待される

この新機能は、単なる技術的な改善を超えて、人間とAIの対話のあり方を根本的に変える可能性を秘めています。従来の「テキストか音声か」という選択から、「テキストも音声も」という統合的なアプローチへの転換は、AIアシスタントの実用性を大幅に向上させる重要な一歩と言えるでしょう。

今後、この技術がさらに発展し、より多くのAIサービスに採用されることで、私たちの日常生活や仕事の効率性が大きく向上することが期待されます。

参考リンク

本記事の作成にあたり、以下の情報源も参考にしています:

- 8 Popular Conversational AI Use Cases

- What is multimodal AI: Complete overview 2025

- Multimodal AI: Combining Voice, Vision, and Text in 2025

- 7 Breakthroughs Shaping AI Assistants Right Now

- 10 Apps that Use Conversational UI

よくある質問(FAQ)

Q1 ChatGPTの新しい音声・テキスト統合機能とは何ですか?

ChatGPTの新しい音声・テキスト統合機能は、チャット画面を表示したまま音声で会話できる機能です。従来の音声モードのように完全に音声のみに切り替わるのではなく、テキストベースの回答や情報を画面で見ながら、音声で質問や指示ができます。これにより、視覚情報と音声による自然な対話を同時に活用でき、情報収集や問題解決の効率が向上します。

Q2 ChatGPTの音声・テキスト統合機能を使うと、どんなことができますか?

ChatGPTの音声・テキスト統合機能を使うと、例えば渋谷のイタリアンレストランを検索する際に、音声で希望を伝えながら、提案されたお店の情報を画面で確認できます。さらに、おすすめ理由や関連情報も音声で聞けるので、視覚と聴覚の両方を使って効率的に情報収集できます。文章作成中に一時的に音声で詳細を確認したり、手作業をしながら音声で情報を取得したりすることも可能です。

Q3 ChatGPTの新しい音声機能は、従来の音声モードと何が違うのですか?

従来の音声モードでは、会話が音声のみで進行するため、複雑な情報や一覧データを把握するのが困難でした。新しい統合機能では、画面に情報が表示されたまま音声会話ができるため、例えば店舗の一覧を見ながら、その詳細について音声で質問するといった使い方が可能です。情報の視認性が向上し、聞き逃した部分を後から確認できる安心感もあります。

Q4 ChatGPTの音声・テキスト統合機能は、スマートフォンでどのように活用できますか?

スマートフォンでは、移動中に音声で質問しつつ画面で詳細情報を確認したり、料理中など手が離せない状況でも音声で質問し、必要に応じて画面を確認したりできます。例えば、目的地周辺のレストラン情報を音声で聞きながら、地図や詳細情報を画面で確認するといった使い方が可能です。

Q5 ChatGPTの音声・テキスト統合機能は、ビジネスでどのように活用できますか?

ビジネスシーンでは、顧客が問題について音声で説明しながら、画面上で関連する資料やFAQを同時に確認できるため、より効率的な問題解決が可能です。営業プレゼンテーション中に資料を表示しながら、音声でAIに追加情報を求めたり、教育現場で学習者が教材を見ながら音声で質問し、即座に回答を得たりすることもできます。

この記事の著者

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&『ChatGPT最強の仕事術』著者。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。