動画にナレーションを入れたいけど、マイクも声優も必要なの?

実は今や、テキストを入力するだけでリアルな音声が作れる時代です。この記事では、AIナレーションの基本から、よくある失敗とその対策まで、すぐに使える実践的なワークフローを丁寧に解説します。

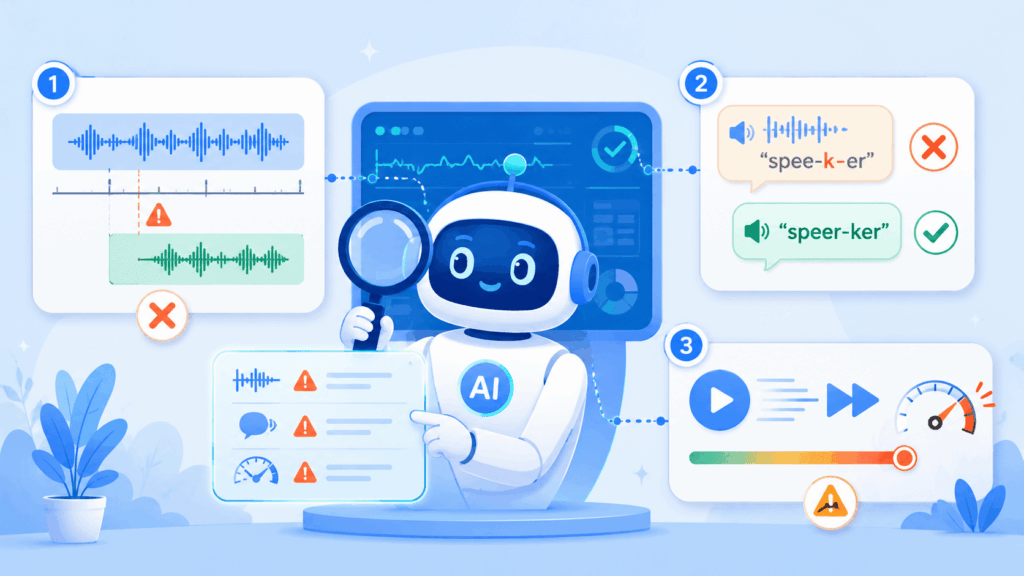

まずはここから:3ステップでわかる全体像

難しく考えなくても大丈夫です。基本の流れはたったの3ステップです。

- スクリプトを書く → Magic Hour Voice Generatorなどのツールで音声を生成する

- ペース・発音・トーンを調整 → 音声ファイルをエクスポートする

- 動画と同期させる → 最終動画をエクスポートする

目次

はじめに:AIナレーションが変えたこと

2026年現在、動画にAIナレーションを追加するワークフローは、かつてと比べて驚くほどシンプルになりました。マイクも、録音環境も、プロの声優も、もう必要ありません。テキストからリアルなナレーションを生成し、タイミングを調整して、数ステップで映像に合わせることができます。

💡 ただし、本当の課題は「声を作ること」ではありません。

問題は、動画にぴったり合うナレーションを作ることです。具体的には、「適切なペース、自然な発音、映像とのズレのない同期」この3点でつまずくクリエイターが非常に多いです。

特に、画像から動画を生成するワークフローや、「しゃべる写真」などのフォーマットを組み合わせる場合、難易度が上がります。

このガイドでは、複数のツールとフォーマットで実際にテストした完全なワークフローをご紹介します。スクリプト作成から最終エクスポートまで、数字や略語の読み上げ問題、タイミングのズレといったエッジケースへの対処法も含めて、丁寧に解説します。

AIナレーションって、テキストを入力すれば自動で動画にぴったり合わせてくれるんじゃないんですか?

声の「生成」自体は驚くほど簡単になりました。でも実際の難しさは「動画との同期」です。ペースのズレ、数字の読み間違い、口の動きと声がバラバラ――こういった”仕上げ”の部分でつまずく方が非常に多いです。このガイドはまさにそこを丁寧に解説しています。

事前準備:必要なものをそろえよう

始める前に、以下の3つを用意しておきましょう。実は品質の差は、ここで8割が決まります。

① 「音声向け」に書かれたスAIで動画にナレーションを追加する方法クリプト

普通のテキストコンテンツをそのままコピーするのはNG。ナレーションには、短い文・明確な間・会話調の表現が必要です。テキスト to ビデオツールを使う場合も、スクリプトは話し言葉に書き直しましょう。

② 映像素材

完成した動画、画像生成ツールで作ったシーケンス、または「しゃべる写真」にする静止画など。最近では、画像 → 動画のパイプラインで映像を作り、後からナレーションを重ねるクリエイターが増えています。

③ AI音声生成ツール

Magic Hour Voice Generator や ElevenLabs などが代表的なツールです。トーン・ペース・エクスポートの柔軟性で比較して選びましょう。

あると便利なオプションツール:

- リップシンクシステム(アバター動画を作る場合)

- 画像エディター(同期前にフレームを調整する場合)

- GIFジェネレーター(クリップを短いループ動画に転用する場合)

ステップ別解説:AIで動画にナレーションを追加する方法

ステップ1|「読み上げ向け」スクリプトを書く(基盤レイヤー)

この工程がすべての土台になります。「AIの声がロボットっぽい」という悩みのほとんどは、実はスクリプトの問題です。

AI音声向けのスクリプトを書くときは、「書き言葉の正確さ」ではなく「話し言葉のリズム」を意識してください。

- 長い文は短く区切る:1文で1つのアイデアを伝えるイメージです。

- 意図的な「間」を作る:句読点、改行、「では」「次に」「ここがポイントです」といつた言葉を使って、自然なリズムを生み出しましょう。

- 強調したい言葉は文末に置く:AIは重要度を自動では判断しにくいため、構造で補います。

- 入れ子構造の表現は避ける:「〇〇であり、かつ△△でもある場合においては……」のような複雑な文は、不自然な読み上げの原因になります。

⚠️ 「しゃべる写真」やリップシンクと組み合わせる場合は特に注意。長い文は口の動きが不自然になります。

💡 判断の目安:一息で読めない文は、書き直しのサインです。

ステップ2|音声を生成する(コントロールレイヤー)

Magic Hour Voice Generator などのツールで音声生成に移ります。

⚠️ スクリプト全体を一度に生成しようとしないでください。 セクションごとに分けて生成することで、一部が上手くいかなかった場合も全体を作り直さずに済みます。

調整すべき主な3つの変数:

| 変数 | 用途別おすすめ設定 |

|---|---|

| 声のキャラクター | 教育コンテンツ → 落ち着いた明瞭なトーン / マーケティング → 活気があり少し速め / ストーリーテリング → 表情豊かだが抑制された |

| ペース | ほとんどのツールはデフォルトが少し速すぎます。わずかにスローダウンするだけで聞き取りやすさが格段に向上します |

| セクション別生成 | 見出しや移行部分は別々に生成。各パートの「届け方」を細かく調整できます |

ステップ3|発音・数字・固有名詞を修正する(精度向上レイヤー)

見落とされがちですが、完成度に大きく影響する重要なステップです。

AIが誤読しやすい代表例:

- 数字(「1500」「2026」など)

- 略語(「AI」「SEO」「API」など)

- ブランド名や固有名詞

- 専門用語

🔧 修正はスクリプト側で行います。音声ファイルを編集しようとすると余計に手間がかかります。

数字の書き方例:

- 「1500」→「千五百」または「one thousand five hundred」

- 「2026」→「twenty twenty-six」(英語音声の場合)

略語の書き方例:

- 「AI」 → 「A I」(スペースを入れてアルファベットを1文字ずつ読ませる)

- 「SEO」 → 「S E O」

💡 チュートリアル動画や製品デモなど、信頼性が求められるコンテンツほど、このステップへの注意が必要です。小さな読み間違いが、視聴者の信頼を一気に下げることがあります。

ステップ4|タイミング・間・音声整理をする(アライメントレイヤー)

声の質が整ったら、音声をエクスポートしてタイミングを調整します。

まず、映像なしで音声だけを聞いてみましょう。 以下の点をチェックします。

- 間が短すぎる箇所はないか

- 早口になりすぎている箇所はないか

- 強調が足りていない箇所はないか

確認できたら、以下の調整を行います:

- セクション間に短い無音部分を挿入する

- 不要な無音部分をトリミングする

- 長いセグメントを小さなクリップに分割する

⚠️ Image-to-Videoパイプラインを使った映像は、尺が固定されている場合があります。 その際は映像に合わせて音声を調整しましょう(逆にしようとすると大変です)。

ステップ5|ナレーションを動画と同期する(統合レイヤー)

いよいよすべてが一つになる工程です。コンテンツの内容に合わせて、以下の2つのアプローチから選びましょう。

アプローチA:通常のナレーション同期

音声ファイルをタイムラインに読み込み、映像と手動で合わせます。以下のコンテンツに最適です。

- チュートリアル動画

- 製品ウォークスルー

- テキスト to ビデオの出力

アプローチB:アバター/リップシンク同期

Magic Hour Lip Sync や Magic Hour Talking Photo などを使い、声と顔の動きを一致させます。以下のコンテンツに最適です。

- 人間らしいプレゼンターが必要な動画

- SNSやバイラルコンテンツ

- 「しゃべる写真」やフェイススワップGIFのフォーマット

⚠️ リップシンクは短いフレーズほど自然に仕上がります。 スクリプトが詰め込みすぎだと、口の動きが不自然になります。

ステップ6|エクスポートして複数バリエーションをテストする(最適化レイヤー)

最初に作ったものが必ずしもベストとは限りません。

以下のバリエーションを複数エクスポートして比べましょう:

- 少し遅め vs 少し速めのペース

- 異なるトーンの声

- SNS向けに短縮したバージョン

GIFジェネレーターやミームコンテンツでは、1秒の差がパフォーマンスに大きく影響することがあります。また、フェイススワップや衣装変更などのビジュアルと組み合わせる場合は、声のトーンが与えるリアリティへの印象も確認しておきましょう。

数字や略語の読み間違いって、音声ファイルを直接編集して直すのではダメなんですか?

音声ファイルを直接編集する方法もありますが、一箇所直すたびにツールを行き来することになり、非常に手間がかかります。スクリプトのテキスト側で「1500」→「千五百」「AI」→「A I」と書き換えて再生成するほうが、はるかに速くて品質も安定します。修正はスクリプト側で完結させるのが鉄則です。

よくある失敗とその対処法

AIナレーションの問題のほとんどは予測可能です。よくあるミスと、素早く解決する方法をまとめました。

❌ 失敗1:声がロボットっぽく聞こえる

→ 原因はほぼスクリプト。長文・複雑な表現・情報の詰め込みすぎが不自然な読み上げを生みます。

→ 短文に書き直し、声に出して読んでみましょう。言いにくければ、聞いても不自然です。

❌ 失敗2:数字・略語・固有名詞の読み方が間違っている

→ チュートリアルや製品デモでは信頼性を損ないます。

→ スクリプト上で数字を文字表記にし、略語はスペースで区切り、難しい単語はフォネティック(発音記号風)表記にしましょう。

❌ 失敗3:ナレーションと映像のタイミングがズレる

→ Image-to-Videoワークフローでよく起きます。映像の尺が後から変わるのが原因です。 → 🔧 映像を確定させてから音声を生成するか、音声をトリミング・分割して映像に合わせましょう。

❌ 失敗4:ペースが速すぎて聞き取りにくい

→ 動画を短くしようと音声を早めると、かえって内容が伝わりにくくなります。

→ 少しスローダウンして、アイデアとアイデアの間に短い間を入れましょう。速さより明瞭さのほうが視聴維持率は上がります。

❌ 失敗5:リップシンク・しゃべる写真の口の動きが不自然

→ セリフが長すぎると口の動きがリアルに見えません。

→ セリフを短く区切り、会話調に整えましょう。

❌ 失敗6:トーンがコンテンツに合っていない

→ チュートリアルに元気な声、広告に単調な声では違和感が生まれます。

→ コンテンツの目的に合わせて選びましょう:教育系 = 落ち着いてクリア、マーケティング系 = ダイナミック。

❌ 失敗7:加工のやりすぎ

→ エフェクトや速度変更を加えすぎると、声が人工的に感じられます。

→ まずスクリプトの質とタイミングを整えることに集中し、調整は最小限に。

「良い仕上がり」チェックリスト

仕上げる前に、以下のすべてをクリアしているか確認しましょう。

- 通常の再生速度で自然に聞こえる

- アイデアとアイデアの間に明確な間がある

- 数字・略語を含め、発音が一貫している

- 音声と映像の間に目立つズレがない

- トーンがコンテンツの内容に合っている

リップシンクや「しゃべる写真」フォーマットを使う場合は、追加で以下も確認してください:

- 口の動きが自然に見える(ぎこちなさや急ぎ感がない)

バリエーション別の活用法

バリエーション1|しゃべる写真

最小限の素材で最大限のエンゲージメントを生む、今もっとも注目されているフォーマットです。

1枚の静止画から動画を作るため、ナレーションがストーリーテリングの主役になります。以下のコンテンツに特に効果的です。

- 教育的なショートクリップ

- 歴史や文化の解説

- キャラクターを使ったコンテンツ

⚠️ 視覚的な動きはすべて顔から生まれるため、文は短く・間は頻繁に・強調は明確にが鉄則です。

バリエーション2|ショートフォーム・ミームコンテンツ(タイミング重視)

ショートフォームでは、ナレーションは「ただの説明」ではなく、ペースを作るリズム装置です。

ミームやショート動画では:

- 誇張した間をあえて入れる

- オチを意図的に遅らせる

- 映像のカットと声のタイミングをピタリと合わせる

同じナレーションを少しペースを変えて複数バージョン作り、テストしてみましょう。

バリエーション3|製品・機能デモ(明瞭さ最優先)

製品デモでのナレーションの目標は、明瞭さと信頼感です。

- 画面に映っているものと完全に一致した説明をする

- 余分な感情表現は省く

- ペースを一定に保つ

⚠️ よくあるミス:映像に映る前、または映った後に説明を話してしまうこと。これは視聴者の認知的な負担を増やします。

バリエーション4|Image-to-Video パイプライン(AI重ね掛けワークフロー)

最近増えているのが、静止画から動画を作り上げる多層AIワークフローです。典型的な流れはこちら。

- 画像生成ツールで映像素材を作る

- 画像アップスケーラーで品質を高める

- Image-to-Videoツールで動きに変換する

- 最後にナレーションを追加する

💡 重要なポイント:音声の生成は必ず映像が確定してから。 映像が変わるたびに音声を作り直すことになります。

バリエーション5|ソーシャルアバター+フェイススワップ(ハイブリッドワークフロー)

複数のAIレイヤーを組み合わせた上級者向けの方法です。

- ナレーション音声を生成する

- リップシンクでアバターの口に合わせる

- フェイススワップやフェイススワップGIFでバリエーションを作る

⚠️ 一番の課題は一貫性です。声・顔・動きがバラバラだと、全体の説得力が崩れます。

バリエーション6|GIF・ループコンテンツ(マイクロ最適化)

ループ動画の場合、ナレーションの構成そのものを変える必要があります。

- 自然なループポイントを作る

- 唐突な終わり方を避ける

- リセットしやすいリズムを意識する

通常のナレーション原稿をそのまま使うのではなく、ループ用に最初から書き直すのが最善です。

上級者向け:フルAIパイプラインの組み方

基本に慣れてきたら、複数のAIツールを組み合わせたフルパイプラインに挑戦してみましょう:

- 画像生成ツール(Image Generator)で映像素材を作る

- 画像アップスケーラー(Image Upscaler)でクオリティを高める

- Image-to-Videoツールで動きに変換する

- Magic Hour Voice Generatorでナレーションを追加する

- リップシンク or 「しゃべる写真」ツールで顔と声を同期させる

この流れを構築できれば、静止画一枚からナレーション付き動画までを、従来の制作工程なしで完成させることが可能になります。ぜひ試してみてください!

よくある質問(FAQ)

Q. AIで動画にナレーションを追加するベストな方法は?

A. スクリプトを書き、AI音声ツールで音声を生成し、動画と同期させるのが基本です。Magic Hour Voice Generatorはこのプロセスをシンプルかつ柔軟に実現できます。

Q. 無料でナレーションを作ることはできますか?

A. はい、多くのツールが無料プランを提供しています。ただし、音声品質やエクスポート長、利用権限に制限がある場合があります。

Q. AIナレーションはプロのコンテンツにも使えますか?

A. 多くの場合、十分に使えます。チュートリアル・広告・SNSコンテンツでは、適切に編集すれば人間の録音と区別がつかないレベルのものが作れます。

Q. ロボットっぽい声を改善するには?

A. まずスクリプトを見直してください。短い文・自然な言い回し・適切な間を意識するだけで、音声設定を変えるより効果的に改善できます。

Q. ナレーションとリップシンクアバター、どちらを使うべきですか?

A. スピードと明瞭さを優先するならナレーション。より人間らしい印象を与えたいなら、リップシンクや「しゃべる写真」フォーマットを選びましょう。

Q. ナレーションと他のAIフォーマットを組み合わせられますか?

A. もちろんです。Image-to-Video・フェイススワップGIF・ミームジェネレーターなどのワークフローと組み合わせることで、より動的なコンテンツを作れます。

まとめ:次のアクションへ

2026年において、動画へのAIナレーション追加はもはや技術的な壁ではありません。差がつくのは、ワークフローの設計と仕上げの精度です。

音声を生成するだけで満足してしまうと、結果は「普通」止まりです。スクリプトの質・ペース・同期の3点を丁寧にコントロールすれば、あなたの動画はすぐに際立ちます。

まずはシンプルに始めましょう。小さなバリエーションを試しながら、あなたのコンテンツスタイルに合ったワークフローを育てていってください。

この記事の著者

Runbo Li

Magic Hour共同創業者兼CEO。Y Combinator採択歴を持つ起業家。

AI動画生成プラットフォーム「Magic Hour」の共同創業者兼CEO。Y CombinatorのWinter 2024バッチに採択された実績を持つ起業家である。Meta(旧Facebook)ではデータサイエンティストとして、新規プロダクト開発部門「New Product Experimentation(NPE)」にて0→1のコンシューマー向けソーシャルプロダクトの開発に従事した経験を有する。

この記事は著者の許可を得て公開しています。

元記事:How to Add Voiceover to a Video with AI (2026): Free Workflow + Best Tools

この記事の監修・コメント

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&著書『ChatGPT最強の仕事術』は4万部突破。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。