Seedance 2.0の使い方完全ガイド|参照画像・動画・音声を活用してキャラクターのブレを防ぐ方法

⏱️ まずは要点だけ確認したい方へ、ポイントをギュッとまとめました。

✅ @メンション構造を使って、キャラクター・スタイル・モーションを明確に指定する

✅ 優先順位を決め、短いクリップから始めることが重要

✅ Seedance 2.0は複数シーンにわたるキャラクターの一貫性が他ツールより高いが、丁寧な設定と正確なプロンプトが必要

目次

はじめに|なぜSeedance 2.0が注目されているのか?

Seedance 2.0の使い方を調べているあなたは、おそらく一つの問題を解決しようとしているはずです。

「AIで生成した動画の中で、キャラクター・モーション・スタイルをどうやって一貫させるか?」

この記事は、次のような方に向けて書かれています。

- シリーズコンテンツやエピソード型の動画を制作したいクリエイター

- ブランドの世界観を統一したAI動画を量産したいマーケター

- 物語性のあるショートフィルムに挑戦したいインディーズ映像作家

- AIツールを「使いこなしたい」すべての方

Seedance 2.0は、ByteDanceが開発した、単純なテキスト入力で動画を生成するツールとは根本的に異なるモデルです。参照画像・参照動画・参照音声を組み合わせ、それぞれが出力にどう影響するかを明示的に指定できる、構造化されたマルチモーダルシステムです。

正しく使えば、キャラクターのブレ(ドリフト)を大幅に減らし、映像の一貫性を高めることができます。しかし、なんとなく使うと予測不能な結果になりがちです。

この記事では以下を解説します。

- Seedance 2.0が実際に何をするツールなのか

- @メンション構造とは何か

- 参照素材をどう設定するか、ステップごとに詳しく説明

- アイデンティティ(キャラクターの外見)とスタイルをどうロックするか

- 一貫性を壊さずに試行錯誤する方法

- Kling 3.0、Veo 3.1、Sora 2、Runway、Magic Hourとの比較

Seedance 2.0の特徴と仕組み

<出典:Seedance 2.0>

Seedance 2.0とは?

Seedance 2.0は、ByteDanceが開発した、明示的な参照コントロールを中心に設計されたマルチモーダルAI動画生成モデルです。

💡 マルチモーダルとは?

「テキスト・画像・動画・音声」など複数の種類のデータを同時に扱えること。

基本的なプロンプトだけのシステムとは違い、画像・動画クリップ・音声ファイルをアップロードした上で、「この素材が出力にどう影響するべきか」を具体的に指定することができます。

Seedanceの核心は、テキストプロンプトがシーンを定義しつつ、参照素材をそれぞれ条件(conditioning)として統合し、キャラクターの外見・モーション・カメラの動き・リズムに影響させる点です。これらの入力を組み合わせることで、一貫した動画を生成します。

⚠️ ポイント: システムはあなたが「どの要素が最も重要か」を明示しない限り、自動的には判断してくれません。指定が曖昧だと、素材の特徴が予期せず混合されることがあります。

他ツールとの違い

| ツール | Seedance 2.0との違い |

|---|---|

| Kling 3.0 / Veo 3.1 | 映画的な美しさや1回で完成する品質を重視。Seedanceはそれよりモジュール式(部品を組み合わせる形)で柔軟 |

| Magic Hour | ガイド付きUIで使いやすさを重視。Seedanceはより深いマニュアルコントロールが可能 |

| Runway | 編集・仕上げに強い。Seedanceは生成段階での参照コントロールに優れる |

メリット・デメリット一覧

✅ メリット

- 明示的なマルチモーダル参照コントロール

- 参照素材がクリーンな場合、キャラクター保持力が高い

- 動画参照からカメラモーションを再現できる

- 音声条件付け生成とリズム同期をサポート

- シリーズ形式のストーリーテリングに向いている

⚠️ デメリット

- 構造化されたプロンプト規律が必要

- 参照素材が矛盾していると、ドリフトが増加する

- 軽量プラットフォームと比べて試行錯誤のスピードが遅い

- 初心者には学習コストがかかる

- ワンクリックで手軽に使うタイプのツールではない

詳細評価|どんな場面で真価を発揮するか

Seedance 2.0の最大の強みは、生成パイプラインの中で「関心事を分離できる」点にあります。

たとえば、顔のアイデンティティを一枚の画像に割り当て、モーションの動きを短い動画クリップに、ペース感を音声トラックに割り当てる、といったことが可能です。この分離によって再現性のあるワークフローを構築できます。プロの制作環境において、これは大きな強みです。AIの生成を「1回きりのプロンプト実験」ではなく、「システム」として扱えるようになります。

ただし、この柔軟性は脆さにもつながります。たとえば、照明条件や髪型がバラバラなキャラクター画像を5枚アップロードすると、モデルはそれらを「平均化」しようとします。この平均化が、フレーム間でわずかに顔が変化してしまう原因になります。

「初心者には学習コストがかかる」とありますが、AIツール初心者には難しすぎるんでしょうか?

正直に言うと、Seedance 2.0はRunwayやMagic Hourのようなガイド付きUIと違い、中上級者向けのツールです。@メンション構造など独自のルールを覚える必要があるので、最初は戸惑うかもしれません。ただ、この記事の手順通りに「まず3〜5秒の短いクリップから試す」という進め方をすれば、少しずつ確実にマスターできます。

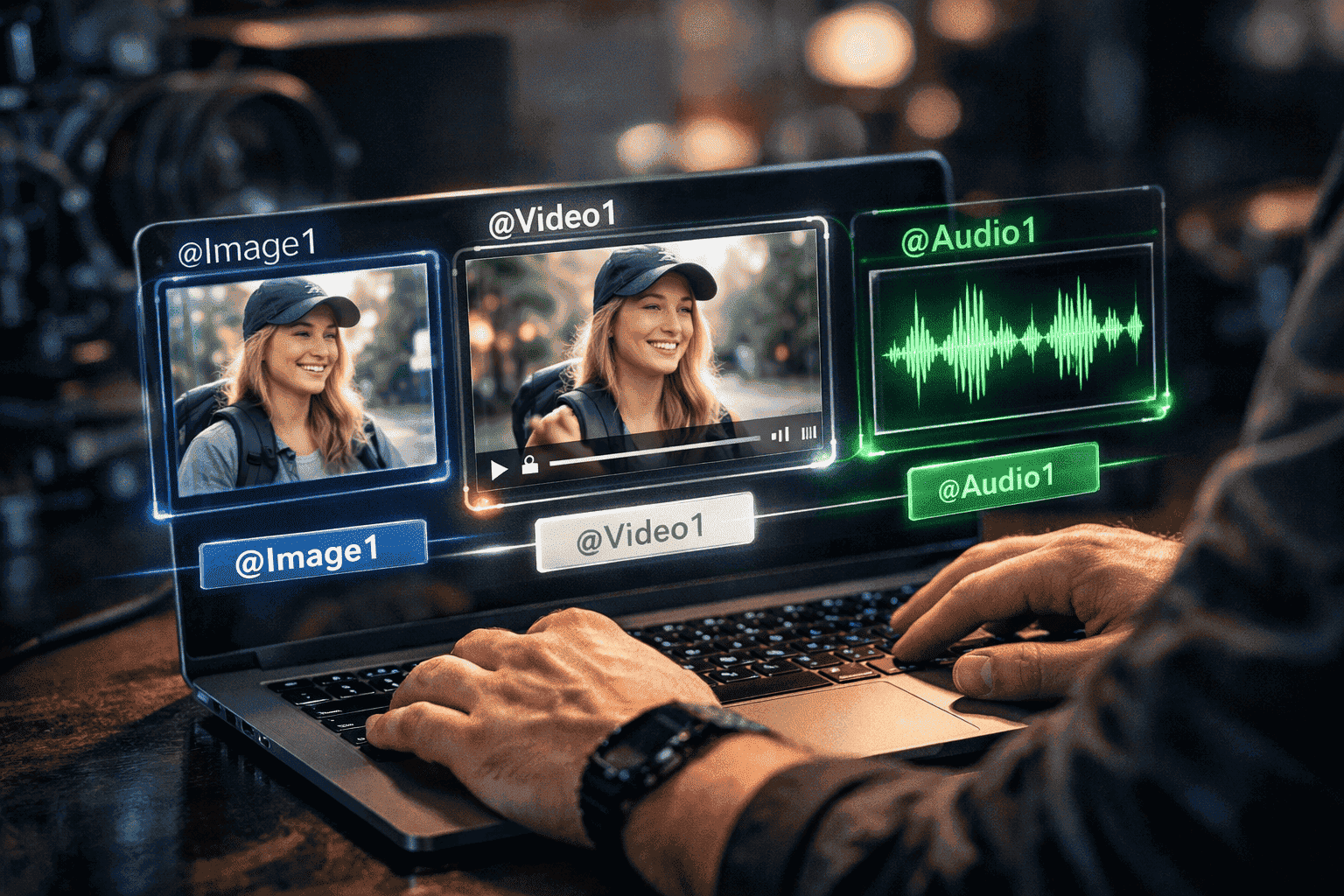

@メンション構造とは?

@メンション構造とは、テキストプロンプトの中でアップロード済みの素材を参照する方法です。

画像・動画・音声ファイルをアップロードすると、それぞれに @Image1、@Video1、@Audio1 のような識別子が付きます。プロンプトの中でその識別子を呼び出し、「このファイルが生成にどう影響するべきか」を指定します。

🎯 イメージとしては、各素材に「役割」を与える感じです。

❌ あいまいな指定: 「アップロードした画像を使ってください。」

✅ 明確な指定: 「@Image1から顔の構造と肌のトーンのみを参照してください。」

この違いが、すべてを変えます。後者の書き方だと、モデルは推測ではなく、明確な指示を受け取ります。

主な2つのモード

① ファーストフレーム/ラストフレームモード

特定の画像を動画の最初または最後のフレームとして使いたい場合に使用します。

② ユニバーサル参照モード

画像+動画+音声+テキストを複数組み合わせて使う場合に使用します。

基本的な記述例

@Image1をファーストフレームとして使用。 @Video1からカメラの動きを参照。 @Audio1からBGMのペースを参照。

💡 鉄則:必ず「どのファイルから」「何を」抽出するのかを明記してください。 モーション?アイデンティティ?カメラ?リズム?ライティング?指定しないと、モデルが属性を予測不能な形で混合してしまいます。

「@Image1から顔の構造を参照してください」みたいな英語の指示、実際に日本語でも書けるんですか?

はい、日本語プロンプトでも動作します。「@Image1から顔の特徴を維持してください」といった書き方で問題ありません。ただし、識別子(@Image1など)の部分は英数字のまま使う必要があります。重要なのは「どの素材から」「何を」抽出するかを明記すること。ここさえ押さえれば、日本語でもきちんと意図が伝わります。

ステップ別ワークフロー|ドリフトなしで使う方法

ステップ1|強力な参照素材を選ぶ

初心者が最も犯しがちなミスが、弱い・または矛盾した参照素材をアップロードすることです。

Seedanceは与えられた素材しかアンカーにできません。参照画像が低解像度・強いフィルター・照明がバラバラな場合、生成動画にもそのブレが受け継がれます。

参照画像の選び方のポイント:

- 顔のディテールが明確な高解像度画像を選ぶ

- あごのライン・鼻の形・目の間隔などのアイデンティティマーカーが隠れる極端な影は避ける

- 衣装や髪型が最終的な仕上がりのイメージに合っているか確認する

- 複数シーンを生成する場合は、最初から衣装と照明を統一しておく

参照動画の選び方のポイント:

- クリーンなカメラモーションが映っているクリップを選ぶ

- 映画的な安定感が欲しければ手持ちカメラのブレた映像は避ける

- ゆっくりとした押し込みショットが欲しければ、そのモーションがはっきりわかるクリップを使う

参照音声の選び方のポイント:

- 声のトーンや音声認識を使う場合はクリーンな音声を選ぶ

- BGMのリズム・テンポ用に使う場合は、テンポが明確でノイズが少ないものを選ぶ

⭐ 良い参照素材を選ぶだけで、試行錯誤のサイクルが劇的に減ります。

ステップ2|参照素材に適切なタグを付ける

アップロード後、@メンション構造を使って意味のあるタグを付けてください。

💡 注意: 利用するUIやプラットフォームによっては、@Image1・@Video1 のような固定ラベルのみが使える場合があります。カスタムタグが設定できる環境では、以下のように機能的な役割を名前に反映させると管理しやすくなります。

❌ 役割が伝わりにくいタグの例:@image1、@ref

✅ 役割が伝わりやすいタグの例(カスタムタグが使える場合):

@lead_character(メインキャラクター) @urban_night_style(都市夜景スタイル) @slow_dolly_motion(スローなドリーショット) @dramatic_voice(ドラマチックな声)

タグは機能的な役割を反映させましょう。モジュール式の部品として考えると扱いやすくなります。

タグをつけたら(または固定ラベルで参照する場合も)、プロンプトの中で何を保持するべきかを明示します:

「@lead_characterから顔のアイデンティティを維持してください。」 「@urban_night_styleからライティングのコントラストとカラーグレーディングを適用してください。」 「@slow_dolly_motionのカメラモーションアークに従ってください。」

ステップ3|アイデンティティとスタイルをロックする

Seedance 2.0において、アイデンティティロックとは優先順位の設定のことです。明示的にランク付けしないと、モデルが参照素材をブレンドしてしまいます。

強いアイデンティティロックのプロンプト例(カスタムタグが使える環境の場合):

「プライマリアイデンティティアンカー:@lead_character。 顔のプロポーション・目の形・髪型は変更しないこと。 衣装の一貫性を維持すること。 セカンダリスタイル参照:@urban_night_styleのライティングとカラーグレーディングのみに適用。」

さらに制約を追加することも有効です:

「顔の変形なし。」 「衣装の変更なし。」 「カラーパレットのシフトなし。」

⚠️ 制約は「完全な保証」ではありませんが、ランダム性を大幅に減らすことができます。

ステップ4|まず短いクリップで試す

⚠️ いきなり最長の15秒動画を生成しないでください。

まずは3〜5秒の短いクリップから始めましょう。短い生成では以下をテストできます:

- 顔の安定性

- ライティングの保持

- モーションの再現性

- 背景の一貫性

ドリフトが起きた場合は、長いシーンに展開する前に修正します。

よくある修正方法:

- アイデンティティ強調の言葉を強める

- 競合するスタイル参照を減らす

- モーション指示をシンプルにする

💡 試行錯誤は当然のプロセスです。良い参照素材を使っても、2〜4サイクルの修正が必要になることは珍しくありません。

ステップ5|シーンを一つずつ拡張していく

3〜5秒のクリップが安定したら、一から作り直さず、シーンを一つずつ積み重ねていきます。

前の出力を新しい参照として再アタッチし、タグを付けます:

@scene1_locked

そしてこう指示します:

「@scene1_lockedから続けてください。アイデンティティとライティングを維持してください。」

このチェーンアプローチによって、シーン間の唐突な変化を防げます。

プロンプト例集|そのまま使えるテンプレート

📷 画像参照プロンプト

@lead_character = 赤いジャケットを着た女性のポートレート @studio_light = 映画的なソフトサイドライティング

プロンプト:

「@lead_characterをプライマリアイデンティティアンカーとして使用し、 5秒の映画的なクローズアップを生成してください。 顔のプロポーションと赤いジャケットの衣装を維持すること。 @studio_lightのライティングスタイルを適用。 スローなプッシュインカメラモーション。背景はニュートラルで。」

🎬 動画参照プロンプト

@lead_character = ポートレート画像 @slow_push_motion = アップロードしたドリーインショット

プロンプト:

「ドラマチックなモノローグシーンを作成してください。 @lead_characterからアイデンティティを保持。 @slow_push_motionのカメラムーブメントパターンに従うこと。 リアルな肌の質感と繊細なマイクロ表情を維持してください。」

🎵 音声参照プロンプト

@lead_character = ポートレート画像 @calm_voice = アップロードした音声サンプル

プロンプト:

「クローズアップの話すシーンを生成してください。 @lead_characterからアイデンティティを保持。 @calm_voiceの声のトーンとペーシングに合わせること。 安定したライティングを維持し、カメラシェイクなし。」

よくある失敗パターンと解決策

| 症状 | 原因 | 解決策 |

|---|---|---|

| フレームをまたいで顔が少しずつ変わる | 参照画像の不一致 | 最も一貫性のある3枚に絞り、アイデンティティロックの言葉を強化する |

| 衣装が突然変わる | 衣装の制約指定が不足 | 「衣装のカテゴリと主要な色を変更しないこと」と明記する |

| モーションがキャラクターと連動していない | モーション参照の役割指定が曖昧 | モーション参照を短く絞り、役割を明確にする |

| リップシンクが不安定 | シーンが複雑すぎる | シーンをシンプルにする。複雑なモーション+感情的な音声はシンク精度を下げる |

他ツールとの比較|Seedance 2.0の立ち位置

| ツール | 強み | 弱み | 最適な用途 |

|---|---|---|---|

| Seedance 2.0 | 構造化された参照ロック | 丁寧な設定が必要 | 一貫したマルチシーンストーリーテリング |

| Kling 3.0 | 映像のリアリズム・4K/60fps | マルチショット参照は可能だが、Seedanceほどの細粒度なモジュール制御はできない | 映画的な高品質クリップ・マルチショット演出 |

| Veo 3.1 | 高精度なモーション物理・Vertex AI / Gemini APIで広く利用可能 | 参照コントロールはSeedanceほど細かくない | 高度な映画的シーケンス |

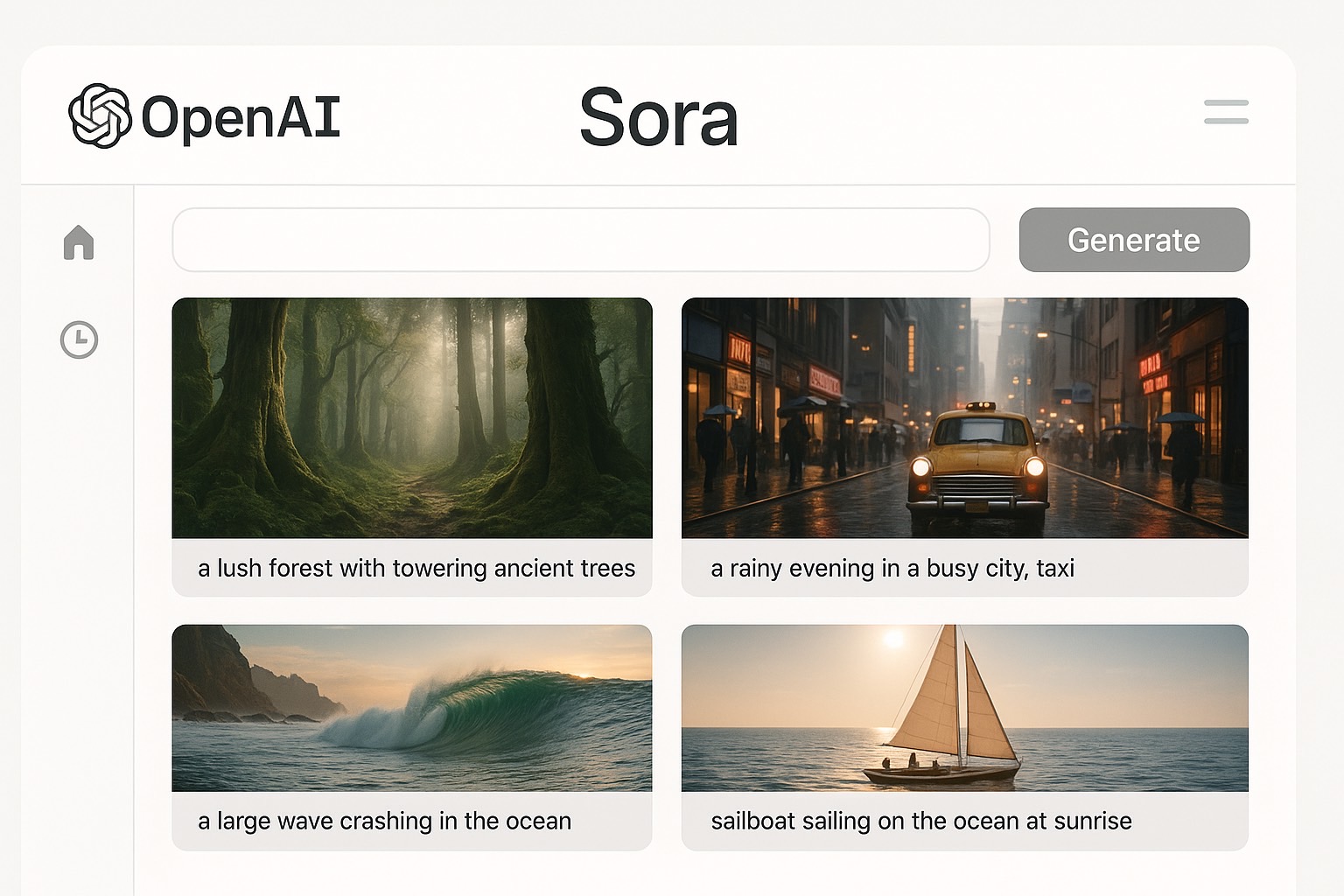

| Sora 2 | シーン理解力が高い・物理シミュレーション精度が高い | 対応国が限定されている場合もある | コンセプトストーリーテリング |

| Runway | 使いやすいUI・生成+編集ワークフローに強い | 細かい参照コントロールはSeedanceに劣る | SNS向けコンテンツ・編集ベースの制作 |

| Magic Hour | 簡単なマルチモーダルツール | 細かいタグ付けが難しい | 素早いクリエイターワークフロー |

Seedanceの強みは「構造化されたアイデンティティコントロール」、弱みは「複雑さ」です。丁寧に使うユーザーほど恩恵を受けられます。

比較表を見ると選択肢が多くて迷います。ビジネス用途なら、結局どれを選べばいいんでしょう?

目的によって変わります。広告やSNS投稿を素早く量産したいならRunwayかMagic Hourが向いています。一方、自社ブランドのキャラクターを複数の動画で統一したい、シリーズ型コンテンツを作りたいという場合はSeedance 2.0が強みを発揮します。「1本の完成度より、再現性ある量産体制を作りたい」という場合に特にSeedanceを選ぶ価値があります。

2026年のAI動画市場でのSeedanceの位置づけ

2026年現在、AI動画ツールは大きく2つの方向に分かれています。

第1のカテゴリ:高品質な映像リアリズム重視型

Kling 3.0・Veo 3.1・Sora 2などがこれにあたります。映像の品質と物語のスケール感を重視しており、少ない入力でも印象的な映像を生成できます。

第2のカテゴリ:ワークフローの簡便さ重視型

Magic Hourなどのプラットフォームがこれにあたります。テキスト→動画、画像→動画、動画→動画などの作業を、ガイド付きインターフェースで誰でも簡単にできるようにしています。スピードを優先するマーケターやコンテンツチームに向いています。

Seedance 2.0は、その中間に位置しています。 ガイド付きプラットフォームよりも手動コントロールが充実しており、大規模モデルほどの自動的な映画的仕上がりはないものの、モジュール式のコンディショニングという独自の強みを持っています。

こんな方にSeedanceがおすすめです:

- 深い参照バインディングと再現性のあるキャラクターシステムが必要な方

- シリーズ型コンテンツや、キャラクターを使い回す制作体制を作りたい方

こんな方は他ツールも検討してください:

- 素早い広告制作を最小限のセットアップで行いたい方

- 一発で映画的なクオリティを出したい方

どのツールが「最良か」は、モデルのスペックではなく、自分のワークフローに合っているかで決まります。

まとめと実践アドバイス

Seedance 2.0は、ドリフトをゼロにするツールではありません。体系的なアプローチで使った時に、ドリフトを大幅に減らすことができるツールです。

成功のカギとなる要素は4つです:

- クリーンで一貫した参照素材を選ぶ

- @メンションで役割を明確に割り当てる

- アイデンティティロックを明示的に設定する

- 短いクリップから段階的に反復する

このツールを「プロンプト実験の場」ではなく、「構造化された制作パイプライン」として扱ってください。そのマインドセットを持てたとき、Seedance 2.0は画像・モーション参照・音声コンディショニングを横断した、一貫性のあるAI動画を生み出す強力なシステムになります。

🚀 次のステップとしておすすめのこと:

- まずは1キャラクター・1シーンの短いクリップ(3〜5秒)から試してみましょう

- 参照素材は統一感のある3枚以内に絞るところから始めると安心です

- プロンプトの書き方を少しずつ改善しながら、自分のワークフローを育てていきましょう

この記事で紹介した基本をマスターしたら、ぜひさまざまな参照素材やプロンプトの組み合わせを試しながら試行錯誤してみてください。繰り返すほど、自分だけの再現性あるAI動画制作スタイルが確立されていきます。応援しています!

この記事の著者

Runbo Li

Magic Hour共同創業者兼CEO。Y Combinator採択歴を持つ起業家。

AI動画生成プラットフォーム「Magic Hour」の共同創業者兼CEO。Y CombinatorのWinter 2024バッチに採択された実績を持つ起業家である。Meta(旧Facebook)ではデータサイエンティストとして、新規プロダクト開発部門「New Product Experimentation(NPE)」にて0→1のコンシューマー向けソーシャルプロダクトの開発に従事した経験を有する。

この記事は著者の許可を得て公開しています。

この記事の監修・コメント

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&著書『ChatGPT最強の仕事術』は4万部突破。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。