この記事の要点まとめ

- 参照方法の選択が最優先:

キャラクターがブレる原因のほとんどは、プロンプトの弱さではなく、参照画像のインプット方法が間違っていることです。 - 参照画像+プロンプトの組み合わせが基本:

参照画像1枚でも安定するツールはありますが、シーン変化が大きい場合は複数参照や前クリップのフレームを併用すると、より安定しやすくなります。 - 参照構造を見直す:

ブレが起きたら、まずプロンプトを書き直す前に見直してみましょう。原因の多くはそちらにあります。

目次

はじめに:なぜキャラクターはブレてしまうのか?

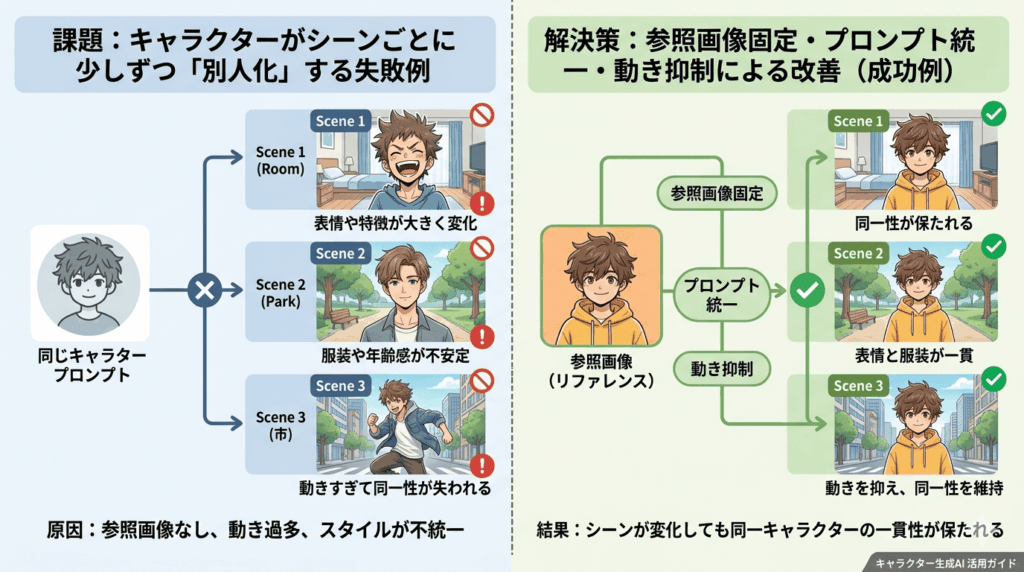

AIビデオ生成において、キャラクターの一貫性を保つことは最も難しい課題のひとつです。プロンプトに同じ人物をきちんと書いているのに、ショットが変わるたびに顔立ちや髪型、プロポーションがじわじわと変化してしまう…そんな経験はありませんか?

このような現象は、一般に「キャラクタードリフト」と呼ばれることがあります。クリップが長くなるほど、またはシーンが変わるほど目立ってきます。

💡 これは特定のツールだけの問題ではありません。 Kling 3.0、Veo 3、Runway、Pika、Luma、PixVerse、Magic Hourなど、主要なAIビデオ生成ツールのほぼすべてで起こります。各ツールは参照条件の設定方法が異なりますが、根本的な課題は同じです。

なぜこうなるのかというと、生成AIはフレームを1枚ずつ再生成する仕組みになっているからです。人間の編集者が「同じキャラクター」として記憶しながら作業するのとは根本的に異なります。

この問題は、コンテンツクリエイターはもちろん、マーケターやブランド担当者にとっても深刻なワークフロー上の悩みです。たとえば、マーケティング用のマスコットキャラクターが途中からあごのラインが変わってしまったり、物語の主人公が次のシーンで別人のように見えてしまったりします。

ただし、多くの場合は改善できます。 キャラクタードリフトは、モデルがプロンプトや参照画像をどう解釈するかを理解すれば、多くの場合コントロールできます。問題の大部分は、参照方法の選択ミス、プロンプトの変え過ぎ、またはモデルが処理しきれないシーン変化によって引き起こされています。

このガイドでは、「完璧な一致」を約束するのではなく、クリップ間のブレを大幅に減らすための再現性ある実践テクニックを段階的に解説していきます。

AIって毎回フレームをゼロから作り直しているんですか?「このキャラはこういう顔」って覚えてくれないんですか?

そうなんです。現状のAIビデオ生成モデルは、キャラクターの「記憶」を持っていません。プロンプトと参照画像を手がかりに、毎フレーム・毎クリップごとにキャラクターを再構築しています。人間の編集者が「同じ人物」として認識しながら作業するのとは根本的に仕組みが違う。だから同じプロンプトを書いていても、シーンが変わるたびに顔がじわじわ変化してしまうんですね。

事前準備:必要なものを揃えよう

ワークフローを始める前に、AIモデルが何を「手がかり」として使っているかを理解しておくと、対処がずっとラクになります。

Kling 3.0、Veo 3、Runway、Pika、Luma、PixVerse、Magic Hourなどの主要な生成ツールは、以下の3種類のインプットを組み合わせて動作していることが多いです。

| インプットの種類 | 役割 |

|---|---|

| 視覚的参照(参照画像・動画フレーム) | キャラクターの見た目を固定する最重要要素 |

| テキストプロンプト | モデルがキャラクターを解釈するための説明 |

| モーション文脈 | カメラ動作や動きがキャラクター再構築に影響する |

このガイドのワークフローを実践するには、以下のものを用意してください。

参照画像

キャラクターを安定させるために最も重要な要素です。短いクリップなら正面の顔写真1枚でも機能しますが、長いシーケンスでは複数アングルや表情のバリエーションがあると効果的です。

プロンプトの構造

クリップをまたいでも、キャラクター描写は一貫して同じ言葉を使ってください。描写を大きく変えると、モデルが人物をゼロから再解釈してしまいます。

シーン文脈

背景・照明・カメラワークも、モデルの顔の再構築に影響します。これらを急激に変えると、別人が生成されることがあります。

参照ワークフローをサポートするビデオ生成ツール

多くのツールが参照画像の条件付けや一貫性維持機能に対応しています。

出力フォーマットと尺の計画

クリップが短いほど、一貫性は保ちやすくなります。長い物語を作る場合は、複数のクリップを別々に生成してつなぎ合わせる方法がおすすめです。

ステップ別ワークフロー:キャラクターを安定させる5つの手順

ステップ1|参照方法を選ぶ

まず生成を始める前に、「どのタイプの参照をモデルに提供するか」を決めることが大切です。状況によって最適な方法が異なります。

代表的な参照方法は3つです。

- 単一参照画像: 短いクリップ、カメラ動作が少ない場面に最適

- 複数アングルの参照セット: 複数ショットや表情変化がある場合に有効

- 前のクリップのフレーム: 既存クリップの延長や連続ショットに最も安定する方法

以下の判断フローを参考にしてください。

- カメラ動作が少ない短いクリップ?

→ YES → 参照画像1枚でスタート - 複数ショットや表情変化がある?

→ YES → 2〜4枚の参照セットを用意 - 既存クリップを延長・連続させたい?

→ YES → 前のクリップのフレームを参照に使う

💡 実際には、これらの方法を組み合わせるのが最も効果的です。ベースとなる顔写真でキャラクターを定義し、追加フレームでクリップ間の連続性を維持するという使い方が一般的です。テキストプロンプトからスタートする場合は、まずテキスト→動画ツールで最初のクリップを生成し、そこから取り出したフレームを以降のショットの参照画像として活用しましょう。

ステップ2|プロンプトで安定したキャラクター描写を構築する

プロンプトは、モデルが参照画像をどう解釈するかに大きく影響します。クリップをまたいで描写が変わると、モデルが顔を少しずつ再解釈してしまいます。

毎回一から書き直すのではなく、固定のプロンプトパターンを作ることをおすすめします。

効果的なプロンプトの構造例:

| 要素 | 内容 |

|---|---|

| キャラクター描写 | 年齢・性別・顔の特徴・髪型など |

| 服装・トレードマーク的な要素 | シーンをまたいで変えない色やスタイル |

| カメラ・シーンの指示 | ここだけクリップごとに変えてOK |

✅ 具体的なプロンプト例(シーン変化前):

肩まで届く黒髪、柔らかい丸顔、薄いそばかす、赤いデニムジャケットを着た若い女性。 シネマティックライティング、ミディアムショット、夜市を歩いている。

✅ 次のシーンに変えるときは、キャラクター描写はそのまま、シーン部分だけ変更:

肩まで届く黒髪、柔らかい丸顔、薄いそばかす、赤いデニムジャケットを着た若い女性。 カフェのテーブルに座っている、温かな午後の光。

⚠️ ポイント:キャラクターの核となる描写は、全クリップでできるだけ揃えてください。

ステップ3|参照画像でキャラクターを「固定」する

テキストプロンプトだけでは安定しないケースが多く、参照画像を併用したほうが一貫性を保ちやすいです。

対応ツールでは、クリップ生成前に参照画像をアップロードできます。モデルはその画像を「視覚的な錨(アンカー)」として使います。

既存の写真から始める場合は、画像→動画ワークフローを使って短いクリップに変換する方法もあります。

最初のクリップが生成されたら、顔がはっきり見えているフレームを書き出してください。このフレームが次のショットの参照画像になります。

手順をまとめると:

- 参照画像+プロンプトでクリップ①を生成

- クリップ①から顔がはっきり映っているフレームを書き出す

- そのフレームをクリップ②の参照画像として使用

- 以降のショットも同様に繰り返す

💡 この「フレームチェーン方式」によって、シーンをまたいだキャラクタードリフトを大幅に減らすことができます。

ステップ4|モーションとカメラワークをコントロールする

参照画像がしっかりしていても、激しい動きがあるとモデルがキャラクターを再解釈してしまうことがあります。

大きなカメラ移動、高速回転、急激な照明変化は、顔の構造を維持しにくくします。ダイナミックな動きが必要な場合は、段階的に導入するのがコツです。

✅ 例: キャラクターがいきなり振り返るクリップを1本生成するのではなく、まず安定したショットを生成し、次に少しだけ動きを加えたクリップを別途生成する。

また、各クリップの尺を短めにすることも有効です。短いクリップのほうが、モデルはキャラクターの同一性を維持しやすい傾向があります。スタイルの調整や連続性の改善が必要であれば、後から動画→動画ワークフローで複数クリップをつなぎ合わせましょう。

ステップ5|照明と環境の連続性を維持する

顔の特徴ばかりに気を取られがちですが、照明はキャラクターの印象に非常に大きな影響を与えます。

照明の方向や色が急激に変わると、プロンプトには合っていても別人のような顔が生成されることがあります。たとえば、柔らかな日中の光で生成したキャラクターは、ネオンライトの下では別人に見えることがあります。

このブレを減らすために、以下の点を各ショットで統一しましょう。

- 色温度(暖色系・寒色系)を揃える

- カメラとキャラクターの距離感を似せる

- 背景の変化は少しずつ

大きな環境変化が必要なときは、直前のクリップから新しい参照フレームを書き出して使うことで、キャラクターの安定性を保ちやすくなります。

フレームチェーン方式って、かなり手間がかかりそうですが、やる価値はありますか?

一手間はかかりますが、やる価値は高いです。プロのAIビデオクリエイターがほぼ共通して使っているテクニックで、「前のクリップから顔が映ったフレームを書き出して次の参照画像に使う」だけです。別途新しい参照素材を用意するわけではなく、すでに生成した素材を再利用するだけなので、慣れてしまえば作業負荷はそこまで大きくありません。

よくある失敗とその対処法

丁寧なワークフローを組んでも、キャラクタードリフトが起きることはあります。以下の表に、よくある失敗原因と具体的な対処法をまとめました。

| 問題 | 原因 | 対処法 |

|---|---|---|

| クリップをまたぐと顔が少しずつ変化する | プロンプトの描写が少し変わっている | キャラクター描写を全クリップで完全に統一する |

| シーンごとにキャラクターが別人に見える | 参照画像を使っていない | すべてのクリップに参照フレームを設定する |

| 動き中に顔が歪む | カメラ動作が激しすぎる | 動きを抑えるかクリップを短くする |

| キャラクターの年齢や雰囲気が変わる | 照明やカラーグレーディングが大きく変わっている | 照明条件を揃える |

| シーン切替後にキャラクターがリセットされる | 新しいクリップで前のフレームを参照していない | 前のクリップのフレームを書き出して参照に使う |

⚠️ トラブルシューティングのコツ:変数は一度に1つだけ変えて確認する。 ブレが起きたとき、すべてを一気に書き直すのは逆効果です。まず参照画像が変わっていないか確認し、次にプロンプトの言葉遣いをチェックしてください。

「成功している状態」とはどんな状態か?

ここで大切な認識の転換があります。「成功しているワークフロー」とは、すべてのフレームでキャラクターが完全に一致している状態ではありません。

現在のAIビデオシステムは、従来のアニメーションパイプラインのように固定したキャラクターモデルを保持しているわけではなく、プロンプト・参照・シーン文脈をもとにキャラクターを毎回再構築しています。そのため、現実的な目標は「ピクセル単位の完全一致」ではなく「視聴者が同じキャラクターと認識できる連続性(知覚的連続性)」です。

✅ 成功しているサインはこれです:

顔の基本構造が安定している:

目と目の間隔、鼻の形、あごのライン、頭部全体のプロポーションが、クリップをまたいで大きくブレていない状態。ライティングや肌のテクスチャに多少の変化があるのは自然なことです。

トレードマーク的な特徴が維持されている:

特定の髪型、眼鏡、ひげ、ジャケットなど、キャラクターを特徴づける視覚要素が安定していれば、シーンが変わってもキャラクターとして認識されます。

表情が自然に変化する:

笑ったり、話したり、首を傾けたりしても別人になっていなければOK。表情の変化で顔の構造が大きく変わる場合は、参照の力が弱すぎる可能性があります。

動きがあっても顔がコヒーレント(整合的)である:

歩く、周りを見回す、軽く首を動かす程度の動きなら顔は維持されるはずです。極端な動きや急激なカメラ移動が顔のブレを引き起こすことがあります。

ショット間の連続性が感じられる:

複数のクリップをつないだとき、次のシーンでも「あ、同じ人だ」と視聴者がすぐ認識できればワークフローは成功しています。

シーン別・ワークフローのアレンジ方法

参照画像+安定プロンプト+フレームチェーンという基本ワークフローは多くの場面で機能しますが、コンテンツの種類によって少しアレンジするとさらに効果的です。

キャラクター参照セットを作る

単一ポートレートに頼るのではなく、正面・斜め・横顔など複数アングルの参照セットを用意しましょう。複数の視点を提供することで、モデルはキャラクターの立体的な構造をより正確に推定できます。キャラクターが頭を回転させたり、話したりするシーンが多いプロジェクトに特に有効です。

物語動画にはフレームチェーン方式を使う

同じキャラクターが異なる環境に登場する連続ショットでは、クリップを順番に生成しながら前のクリップから書き出したフレームを次の参照にする、という繰り返しが効果的です。これにより、キャラクターの同一性がシーケンス全体に「伝播」していきます。

シーン転換はゆっくりと

明るい屋外から暗い室内へ直接切り替えると、顔が別人になることがあります。そういった場合は、中間状態のクリップを挟んで徐々に環境を変えると、モデルが視覚的な連続性を保ちやすくなります。

スタイルを変えてもキャラクターを保持する

シネマティックルックとアニメ調など、同じキャラクターで異なるビジュアルスタイルを試したい場合は、参照画像はそのままに、プロンプトのスタイル指示だけを変えるのがコツです。これにより、キャラクターの同一性を維持しながらシーンを再解釈させることができます。

SNS向けショートコンテンツの繰り返しキャラクター

SNSやYouTubeショートなど、同じキャラクターが多数の独立したクリップに登場する場合は、シンプルな方法が使えます。強い参照ポートレート1枚をすべての動画の基盤にする。 各クリップでその参照画像からスタートし、プロンプトでアクションや設定だけを変えます。マスコット、バーチャルインフルエンサー、プレゼンターキャラクターに向いたアプローチです。

よくある質問(FAQ)

Q:なぜAIビデオモデルはキャラクターの一貫性が苦手なのですか?

多くの生成モデルは、プロンプトと参照信号に基づいて各フレームを独立して生成しています。解釈のわずかなブレがフレームやクリップをまたいで蓄積されることで、キャラクタードリフトが発生します。

Q:すべてのビデオ生成ツールが参照画像に対応していますか?

対応レベルはツールによって異なります。プロンプト主体のツールもあれば、明示的な参照ワークフローを持つツールもあります。Kling 3.0、Veo 3、Runway、Pika、Luma、PixVerse、Magic Hourはそれぞれ異なるアプローチを実装しています。

Q:完全な一貫性は実現できますか?

長いシーケンスにわたる完全な一貫性は、まだ難しいのが現状です。多くのワークフローはドリフトを「ゼロにする」のではなく「減らす」ことを目標にしています。クリップを短くし、強い参照を使うことが最良の結果につながります。

Q:参照画像は何枚用意すればいいですか?

シンプルなクリップなら、明瞭なポートレート1枚で十分なことが多いです。長い動画や複数シーンの場合は、異なるアングルから2〜4枚の参照画像を用意すると安定性が増します。

Q:なぜ照明が変わると顔も変わってしまうのですか?

照明は、モデルが顔の特徴を再構築する際に大きく影響します。強いカラーシフトや劇的な影の変化は、モデルが顔の構造を再解釈するきっかけになります。

Q:同じ動画で複数のキャラクターの一貫性を保てますか?

可能ですが、難易度は上がります。各キャラクターに個別の参照画像と一貫したプロンプト描写を用意し、キャラクターごとにクリップを別々に生成してから組み合わせる方法が効果的です。

まとめ:今日から実践できる3つのポイント

このガイドで紹介したテクニックを振り返ると、キャラクター一貫性の核心は以下の3点に集約されます。

✅ 参照方法の選択が最初の分岐点:

単一画像・複数アングルセット・前のフレームを状況に応じて使い分けましょう。

✅ プロンプトのキャラクター描写は、全クリップで固定する:

シーンだけ変えて、人物描写は一字一句変えない。

✅ ブレが起きたら、変数を1つずつ確認する:

まず参照画像、次にプロンプト、それからモーションとライティングの順に見直す。

「完璧なAIキャラクター」は現時点ではまだ難しいですが、再現性のあるワークフローを積み重ねることで、視聴者が「同じ人だ」と感じるレベルの一貫性は十分に達成できます。

ぜひ今日から小さなクリップでこのワークフローを試してみてください。プロンプトや参照画像をいろいろ試行錯誤しながら、自分だけの最適な設定を見つけていきましょう。応援しています!

この記事の著者

Runbo Li

Magic Hour共同創業者兼CEO。Y Combinator採択歴を持つ起業家。

AI動画生成プラットフォーム「Magic Hour」の共同創業者兼CEO。Y CombinatorのWinter 2024バッチに採択された実績を持つ起業家である。Meta(旧Facebook)ではデータサイエンティストとして、新規プロダクト開発部門「New Product Experimentation(NPE)」にて0→1のコンシューマー向けソーシャルプロダクトの開発に従事した経験を有する。

この記事は著者の許可を得て公開しています。

元記事:How to Keep Characters Consistent in AI Video (2026): References, Prompts, and Practical Fixes

この記事の監修・コメント

池田朋弘(監修)

Workstyle Evolution代表。18万人超YouTuber&著書『ChatGPT最強の仕事術』は4万部突破。

株式会社Workstyle Evolution代表取締役。YouTubeチャンネル「いけともch(チャンネル)」では、 AIエージェント時代の必須ノウハウ・スキルや、最新AIツールの活用法を独自のビジネス視点から解説し、 チャンネル登録数は18万人超(2025年7月時点)。