毎朝8時、ゴールドマン・サックスのバックオフィスでは、数十人のアナリストがほぼ同時にモニターを開く。前日深夜から積み上がった「例外トランザクション」のキュー。ルールベースのシステムでは処理できなかった取引の山が、そこに待っている。1日数億件の取引のうち99%はシステムが処理するが、残り1%にあたる数万件は、人間が文脈を読み、規制要件と照合し、「フラグすべきか」「承認ルートに回すべきか」を判断しなければならない。経験5年のアナリストが暗黙的にこなしている、言語化しにくい判断の連鎖だ。

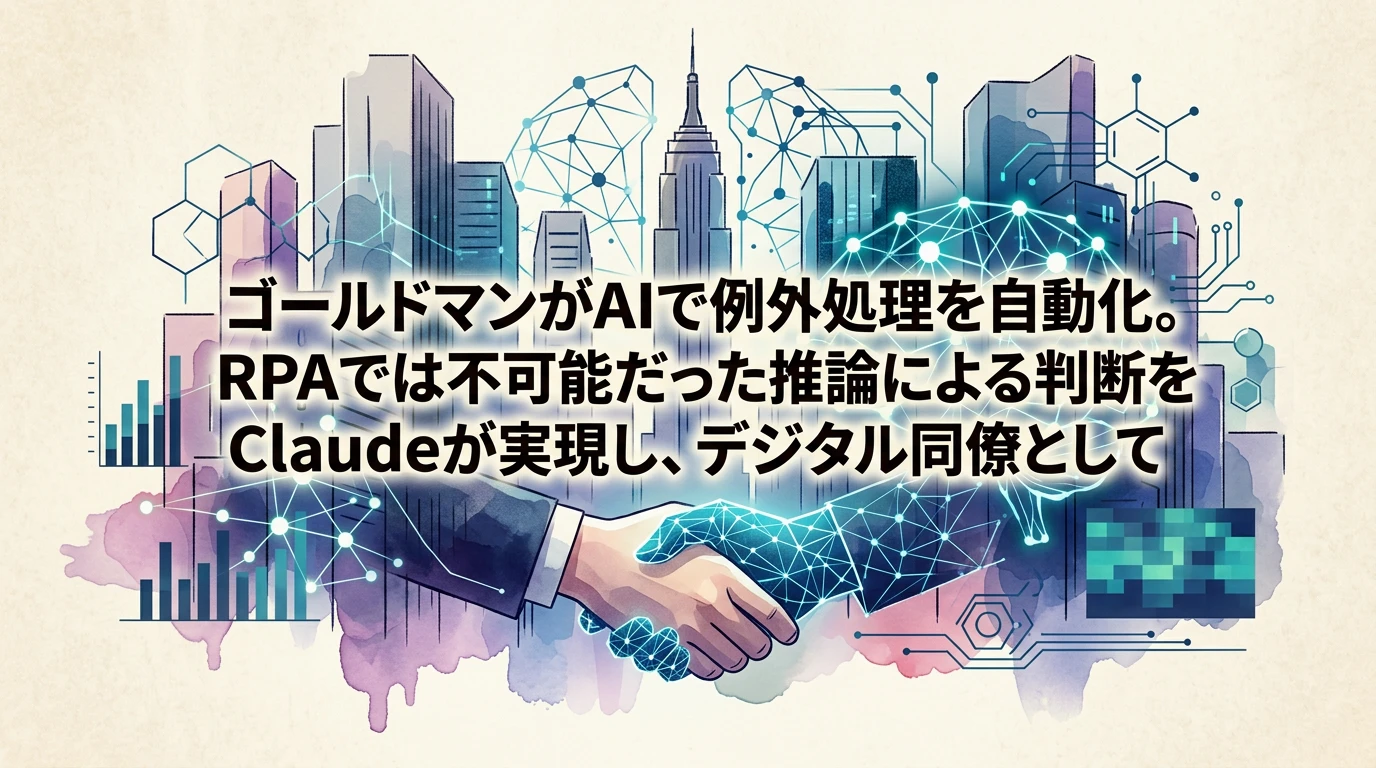

2026年2月6日、CNBCは「ゴールドマン・サックスがAnthropicのClaudeを使い、会計とコンプライアンスの業務を自動化する」と報じた。見出しだけなら、よくあるAIニュースだ。だがこの提携の内実を掘り下げると、「AIが仕事をする」という現象の本質が、一般に思われているものとはまったく違う姿で浮かび上がる。

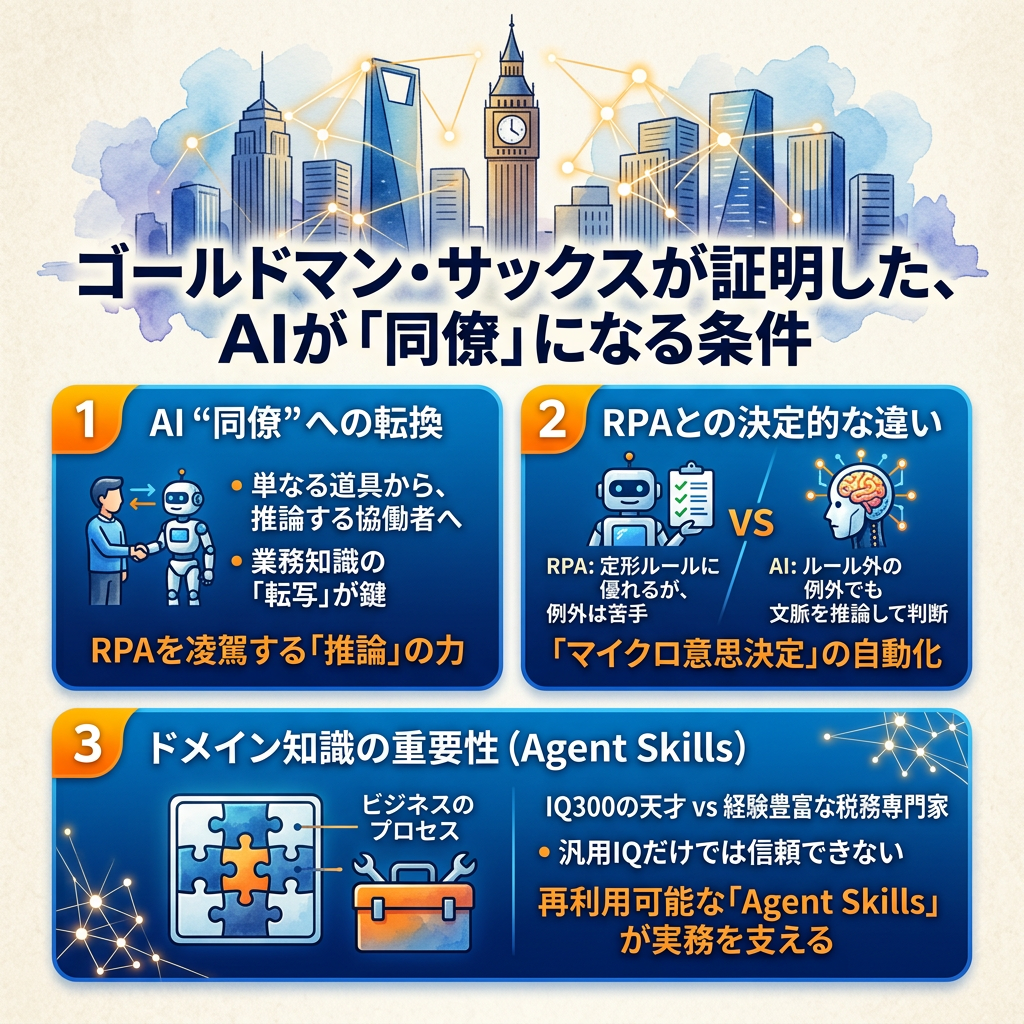

AIが人間の仕事を代替する。この言い方は、正確さを欠いている。より正確に言えば、人間の業務知識がAIに転写可能な形式に構造化される仕組みが整ったのだ。AIモデルの性能向上だけでは、この変化は起きなかった。推論エンジンの進化と、業務知識を構造化する人間側のアーキテクチャ設計が噛み合って初めて、「道具」が「同僚」に変わった。ゴールドマン・サックスとAnthropicの提携は、その転換点を鮮やかに示している。

目次

RPAが10年で攻略できなかった「最後の砦」が崩れた理由

ゴールドマンのCIO、Marco Argentiは、バックオフィスの例外処理を「多数の微小な意思決定の集合」と表現した。追加書類が必要かどうかを判断する。クライアントとその配偶者が同一企業の共同所有者であれば別途KYCが要るかを見極める。取引の文脈を読み、規制の精神に照らして判断を下す。こうした「ルールではなく推論に基づくマイクロな意思決定」が、毎日数万件積み上がる。

ここにこそ、従来のRPA(ロボティック・プロセス・オートメーション)が10年以上かけても攻略できなかった壁がある。RPAは確定的なルールの自動実行には優れるが、ルールの外にある例外を前にした瞬間、人間に投げ返すしかなかった。

Anthropicのエンジニアたちが6カ月間ゴールドマンに常駐して取り組んだのは、まさにこの壁の攻略だった。金融サービス部門責任者Jonathan Pelosiはこう語る。「大量の構造化・非構造化入力を処理し、多層的なルール適用と判断を必要とする業務こそ、Claudeの設計思想に合致する」。エンジニアたちはドメインエキスパートの隣に座り、「コンピュータの使い方、プロセスの実際の動き、ボトルネックの場所」を体系的に記録した。

結果、クライアントオンボーディング時間は大幅に短縮されたとされる(一部報道では30%との数字も出ているが、公式発表での具体的な数値確認は取れていない)。だが数字よりも重要なのは質的な転換だ。RPAが「やれなかったこと」をAIが「やれるようになった」。Claude Opus 4.6のchain-of-thought推論と最大100万トークン(ベータ)のコンテキストウィンドウが、長大な規制文書と取引記録を一括処理し、「ルールが存在しない状況でも文脈を読んで判断を下す」能力を実現した。

Argentiが繰り返す表現がある。「デジタル同僚」。RPAやルールエンジンとの本質的な違いは、推論の有無だ。人間の業務フローに組み込まれ、判断を分担し、エスカレーション先を選別し、監査証跡を残す。道具の使い方ではなく、同僚との協働に近いインタラクションモデルだ。ただしArgentiは「人間は依然としてループの中にいる」とも強調する。高リスクの決定には必ず人間のレビューが入る。

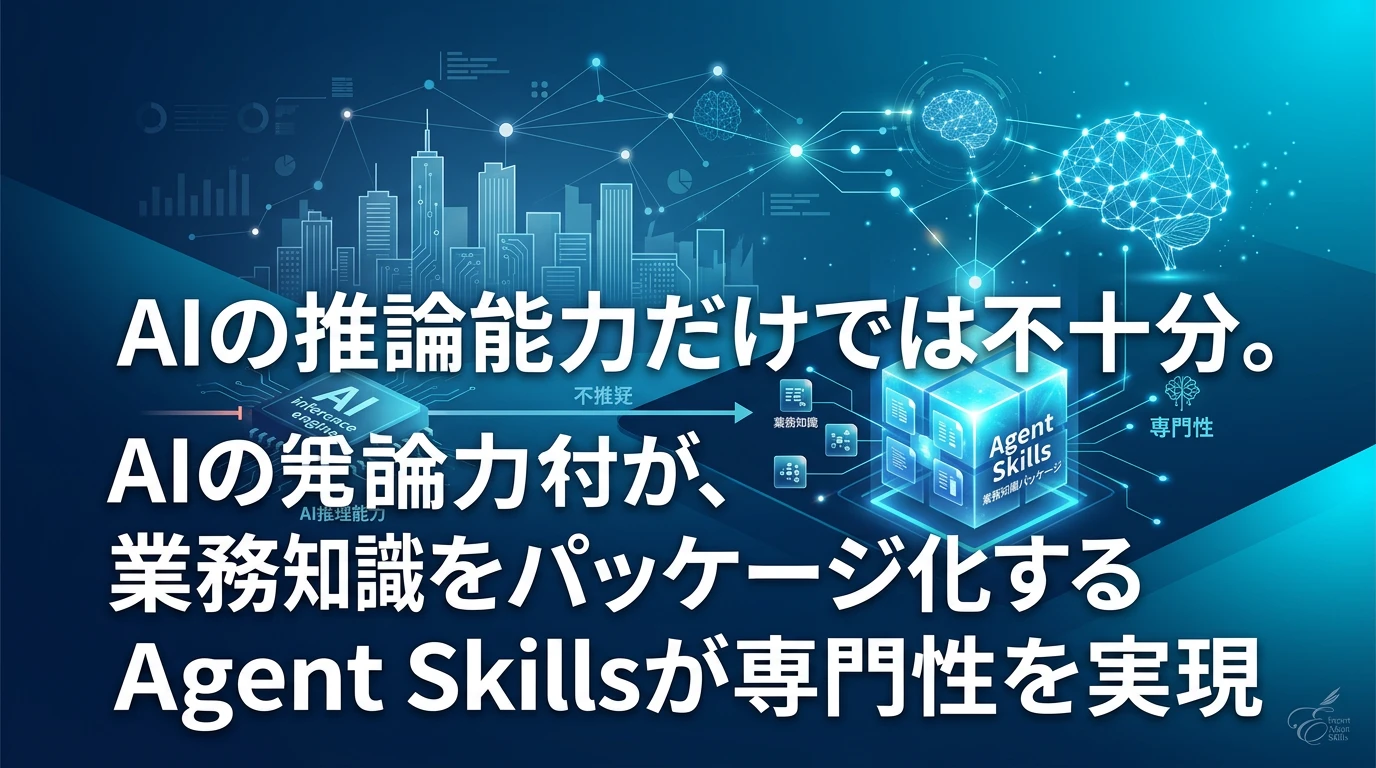

では、推論能力が上がっただけで「仕事ができるようになった」のか。話はそう単純ではない。

「IQ300の天才」が確定申告できない理由

2025年10月、Anthropicは「Agent Skills」という概念を発表した。同年12月にはその仕様をオープン標準として公開し、2026年2月には金融サービス向けのプリビルトSkillsを投入した。

Agent Skillsとは何か。端的に言えば、業務知識の再利用可能なパッケージだ。

この概念を理解するうえで、Anthropicのエンジニアリングブログに登場するアナロジーが分かりやすい。「IQ300の数学の天才と、経験豊富な税務専門家。あなたの確定申告を任せるなら、どちらを選ぶか?」。答えは明らかだ。AIの汎用的な推論能力がどれほど高くても、ドメイン固有の手順知識がなければ、専門業務では信頼できない。税務コードの解釈、控除の適用基準、申告書の記入手順。こうした領域知識こそが実務を回している。

プロンプトは「会話単位の一回限りの指示」であり、毎回書き直す必要がある。知識は揮発性で、組織内で共有できない。対してスキルは、業務の手順書・ルール・テンプレートをSKILL.mdというフォーマットで構造化し、AIエージェントが自動的にロードして実行する。永続的で、バージョン管理でき、IT部門が組織全体に展開できる。

技術的な核心は「プログレッシブ・ディスクロージャー」にある。エージェントはまずインストール済みスキルのメタデータだけを読み込む(50スキルで約5Kトークン)。ユーザーの要求がスキルのドメインと一致したときに初めてSKILL.mdの全文をロードし、さらに参照ファイルは必要時にのみ取得する。この3段階の遅延ロードが、コンテキストウィンドウの肥大化を防ぎながら「事実上無制限」の手順情報を扱える仕組みだ。

ここに、「プロンプトの役割が変わる」という転換の意味がある。個別会話で巧みな指示を書く技術から、組織の業務知識をどう構造化し、AIが実行可能な形式にどう変換するかが問われる時代へ。プロンプト設計が不要になるわけではない。スキル化できない新しい業務やエッジケースには引き続き即興的なプロンプトが必要だ。だが重心は移る。プロンプトが「聞き方の工夫」だとすれば、スキルは「業務フローの設計図」だ。

この構造変化は、金融業界にとどまらない広がりを見せ始めている。

ベテランアナリストの暗黙知がGitHubで共有される日

ゴールドマン・サックスで実際に何が起きたのかを、知識管理の理論で読み解いてみよう。

経営学者の野中郁次郎が提唱したSECIモデルは、暗黙知が組織知になるプロセスを4段階で説明する。共同化(Socialization)、表出化(Externalization)、連結化(Combination)、内面化(Internalization)。ゴールドマンの事例は、このうち表出化と連結化をAIが劇的に加速させた実例と位置づけられる(なお、SECIモデルの4段階すべてが適用されるわけではなく、ここでは2段階に焦点を絞っている)。

Anthropicエンジニアがドメインエキスパートの作業を「観察」したのは共同化だ。観察内容をSKILL.mdフォーマットに落とし込んだのが表出化。複数の業務判断ロジックをエージェントに統合したのが連結化にあたる。Argentiはこのプロセスの先にあるビジョンとして、AIが「ゴールドマン社員のような発言をする段階」から「ゴールドマン社員のような行動をする段階」への移行を語っている。特定個人の専門性をAIが引き継ぎ、実行するという機能的転換だ。

注目すべきは、このプロセスがゴールドマンの内部に閉じていないことだ。AnthropicはAgent Skillsの仕様をオープン標準として公開した。GitHubのanthropics/skillsリポジトリは20,000スターを超え、Microsoft、Cursor、そしてOpenAIまでもが同一アーキテクチャを採用している。金融サービス向けには、DCFモデル構築、LBO構造化、投資銀行デックレビュー、エクイティリサーチ、プライベートエクイティのデューデリジェンスといったプリビルトスキルが公開されている。PwCはAnthropicと提携し、規制産業向けの業界特化スキルを開発中だ。

ゴールドマンで暗黙知がスキル化されたのと同じプロセスが、業界全体で並行して進行している。かつてベテランアナリストの頭の中にしか存在しなかった業務知識が、SKILL.mdというフォーマットを通じてGitHubで共有され、世界中のAIエージェントにインストール可能になりつつある。

しかし、市場はこの変化を静観しなかった。

2,850億ドルが消えた日——AIは既存ビジネスモデルの「根拠」を揺るがした

2026年2月3日、Anthropicが企業向けワークプレイスアシスタント「Claude Cowork」に法律業務向けプラグインを追加したと発表した直後(金融・データ分析向けは同月24日に追加)、グローバルのソフトウェア株が暴落した。Thomson Reutersは約15.6%下落し、取引時間中には17%近くまで沈む場面もあった。Wolters Kluwer(法律データ大手)は約10%急落し、FactSetもその後数週間で20%超の下落に見舞われた。一日で約2,850億ドルの時価総額が蒸発し、その後数日間で損失は1兆ドル規模に拡大した。

公平を期せば、この暴落はAnthropicの発表だけが原因ではない。ディーラーヘッジフロー、CTAのモメンタムシグナル、リスクパリティの巻き戻しが連鎖する「ドゥームループ」が機械的な売りを増幅した。だがトリガーとなった市場心理の変化は明確だ。Deutsche Bankのマクロリサーチ責任者Jim Reidは、「すべてのテック株が勝者だという楽観論から、勝者と敗者が明確に分かれる現実主義への転換だ」と論じた。ゴールドマン・サックスのストラテジストBen Sniderは、この事態を「新聞業界がインターネットで経験した構造的衰退の始まりに似ている」と警告した。2002年から2009年にかけて、新聞業界の株価は平均95%下落した。

投資家が恐れたのは単純な「AI競合」ではない。月額20ドルのClaude Proや月額100ドルからのClaude Maxが、年間数百ドルから数千ドルのSaaSサブスクリプションを構造的に置き換えうるという、ビジネスモデルそのものの否定だった。Thomson Reutersの法律データベースも、FactSetの金融データ分析も、その本質は「専門知識をソフトウェアに埋め込んで提供する」モデルだ。Agent Skillsのオープン標準化は、その「埋め込み」を桁違いに低コストで、かつオープンに実現しうる。知識の希少性に乗せていた価格プレミアムの根拠が、構造的に揺らいだのだ。

そしてこの変化は、企業の株価だけでなく、組織の中で働く一人ひとりの日常にも届き始めている。

AIに最も浸食されるのは、なぜ高学歴の知識労働者なのか

ゴールドマン・サックス自身のリサーチは、世界で3億人分のフルタイム雇用相当がAIによる自動化の影響を受けると試算し、米国の労働タスクの25%が自動化可能になると予測する。だがCEOのDavid Solomonは「私はジョブ・アポカリプス論者ではない」と繰り返す。彼の戦略は「短期解雇」ではなく「headcount growth constraint」。将来の採用を抑制しつつ、自然減と配置転換で組織を再構成する漸進的アプローチだ。

しかし数字の裏側では変化が進んでいる。2025年10月、ゴールドマンは「OneGS 3.0」イニシアチブの下で1,000名以上の削減を実施した。ただし同時期に新規採用も継続しており、年間ベースでは純増だった。注目すべきは削減の基準だ。パートナーたちは「AIに代替可能な役割を識別せよ」と明示的に指示された。従来の業績不振者対象の整理解雇とは異なる、新しい類型の人員整理が始まっている。

AIが最も深く浸食するのは、皮肉にも高学歴・高収入の知識労働者だ。ゴールドマンの分析によれば、AIタスクカバレッジはプログラマーで74.5%、カスタマーサービス担当で70.1%に達する。弁護士、金融アナリスト、会計士。かつて「安泰」とされた職種が、最も大きな構造転換に直面している。米国ではテック業界のレイオフが加速し、エントリーレベルの求人が減少し始めている。

一方で、新たな職種も急速に生まれている。AIの倫理・コンプライアンスを担う専門家は急成長中で、中堅以上のポジションでは年収14万ドルを超える水準も珍しくない。チーフAIオフィサー(CAIO)を設置する企業は急増し、World Economic Forumは2030年までに9,200万人分の雇用が消える一方、1億7,000万人分の新規雇用が創出されると予測する(純増7,800万人)。

MITの経済学者David Autorの研究(2024年)が示すように、現在の米国労働者の60%は1940年には存在しなかった職種に就いている。その多くが、テクノロジーの進化——とりわけ労働を補完する技術革新——によって新たに生み出された職種だ。この歴史的パターンに照らせば、今回もまた新たな雇用創出の波が来ると言いたいところだが、率直に言えば不確実性が高い。

過去の技術変化が代替した肉体労働・定型事務の場合、人間は認知的・創造的・対人的スキルへとシフトすることで新たな職を得た。しかし今回は、その「シフト先」そのものがAIの代替対象になっている。蒸気機関は肉体労働者を、パソコンは定型的な事務作業者を主に置き換えた。AIは、判断と推論を行う知識労働者を最前線に立たせている。歴史的類推が今回も当てはまるかどうかは、正直なところ誰にも分からない。楽観の根拠は「人間の欲望とニーズは技術で尽きない」という信念だが、それが今回の構造転換を十分に説明できるかは、これから検証されることになる。

残されたリスク——楽観論の死角

ここまでの分析はゴールドマン・サックスとAnthropicの公式発表に依拠している。公平のため、この変化に伴うリスクにも触れておく必要がある。

第一に、AIの誤判断リスク。金融コンプライアンスにおけるAIの誤判断——誤った取引フラグ、規制違反の見落とし——は、数十億ドル規模の罰金や信用毀損に直結しうる。ハルシネーション(事実に基づかない出力)はLLMの構造的弱点であり、「デジタル同僚」が誤った判断を下した場合の法的責任は、まだ明確に定まっていない。

第二に、業務知識の流出リスク。SKILL.mdのオープン標準化は、業務知識の共有と流通を劇的に加速する一方、悪意ある改ざんやサプライチェーン汚染のリスクを伴う。組織の核心的な業務手順がGitHubリポジトリ経由で流出する可能性を、セキュリティ設計でどう担保するかは未解決の課題だ。

第三に、再現可能性の条件。ゴールドマンは6カ月間Anthropicエンジニアを常駐させるという、大規模な投資を行った。金融コンプライアンスは「判断基準が法令・社内規程として文書化されている」という、構造化に適した業務特性を持つ。大半の企業はこの投資規模を持たず、すべての業務が同程度に構造化可能なわけでもない。ゴールドマンの事例が他業界で再現されるには、業務の文書化可能性、規制適合性、組織の投資能力という3つの条件が揃う必要がある。

あの一本の記事が突きつけた本当の問い

2026年2月6日のCNBCの記事に戻ろう。

「ゴールドマンの仕事ができるAI」。この見出しが意味するものは何だったのか。AIが突然賢くなったという話ではない。ゴールドマンの業務知識が、AIに転写可能な形式で構造化されたという話だ。

AIが業務フローに組み込まれるには、3つの条件が同時に揃う必要がある。まず技術面では、Claude Opus 4.6が実現した「ルールでは対処不能な例外判断」の推論能力だ。chain-of-thought推論と大容量コンテキストウィンドウが、RPAの10年来の限界を突破した。だが技術だけでは不十分だった。ゴールドマンへのAnthropicエンジニア常駐が示すように、業務知識がSKILL.md形式で構造化されて初めて、AIは「どう判断するか」を知る。そして最後の条件が、この仕組みのオープン標準化だ。GitHubの20,000スター、PwCとの提携、MicrosoftやOpenAIによる同一アーキテクチャ採用。個社の取り組みが産業インフラに転化したことで、ゴールドマンで起きたことが、条件さえ揃えば再現可能なモデルになった。

冒頭のゴールドマンのバックオフィスに戻れば、あの朝のアナリストたちの仕事が消えたわけではない。例外処理のキューが減り、その分だけ彼らの時間は「AIには任せられない判断」——最終的なリスク評価、クライアントとの交渉、未知のケースへの対応——に振り向けられるようになった。「デジタル同僚」は同僚であって、上司ではない。

問われているのは「AIがどこまで賢くなるか」ではない。組織にとっては「業務知識をどこまで構造化できるか」。個人にとっては「自分の判断プロセスを言語化できるか」。そして産業全体にとっては「暗黙知に乗せていた価格プレミアムを、何で代替するか」だ。

出典・参考情報

・ Goldman Sachs taps Anthropic’s Claude to automate accounting, compliance roles – CNBC (2026年2月6日)

・ Goldman equips AI agents to do trade accounting, onboarding – American Banker

・ Anthropic launches enterprise ‘Agent Skills’ and opens the standard – VentureBeat

・ Equipping Agents for the Real World with Agent Skills – Anthropic Engineering Blog

・ How Will AI Affect the Global Workforce – Goldman Sachs Research

・ Goldman Sachs deploys Anthropic systems with success – AI News

・ The SaaSpocalypse: $285 Billion Erased – Medium

・ Goldman Sachs warns software stocks face newspaper-like decline – IndexBox

・ Goldman Sachs Scales AI Coding to Thousands of Agents – Lucidate

・ 8 ways Goldman Sachs is using AI (Case Study) – DigitalDefynd

・ Most Work Is New Work – David Autor, MIT (2024)

・ Future of Jobs Report 2025 – World Economic Forum

・ Fortune: Goldman Sachs CEO David Solomon on AI jobs (2025年10月)

・ February 2026 Selloff Anatomy – mbrenndoerfer.com

・ Anthropic unveils Claude legal plugin – Legal Technology

・ Anthropic Claude Cowork Office Worker update – CNBC (2026年2月24日)

・ Thomson Reuters stock: Yahoo Finance historical data

・ Thomson Reuters record percent decrease – Morningstar / Dow Jones

・ RELX, Wolters Kluwer shares plunge on AI competition fears – Wall Street Journal

・ Generative AI could raise global GDP by 7 percent – Goldman Sachs

・ Choosing a Claude Plan – Anthropic Support