2022年末、ChatGPTが世界を驚かせた。

それからわずか3年。AIに「質問して答えを返してもらう」コストは1,000分の1に下がった。

文庫本3冊分のテキストをAIに処理させる費用が、約9,000円から約9円になった計算だ。

この劇的な変化を支えているのが、NVIDIA(エヌビディア)のAI半導体と、その周辺で起きている技術革新である。

この記事では、NVIDIAのチップ開発ロードマップ、推論コストの急落メカニズム、電力問題、そしてライバルの台頭までを、専門知識がなくても読める形で伝える。AIを「使う側」のビジネスパーソンが、投資判断や事業計画を立てるうえで押さえておくべきポイントを整理した。

目次

- 1 AIを使うコストは3年で1,000分の1になった

- 2 そもそも推論って何?

- 3 なぜここまで安くなったのか

- 4 ソフトウェアの力も見逃せない

- 5 NVIDIAのチップ、これからどうなる?

- 6 Blackwell Ultra ─ 2025年の最新世代

- 7 Rubin & Rubin Ultra ─ 2026〜2027年の主役

- 8 Feynman ─ 2028年、未知の領域へ

- 9 電力問題 ─ チップが強くなるほど電気を食う

- 10 NVIDIAだけじゃない ─ ライバルたちの動き

- 11 安くなるほど使われ、使われるほど足りなくなる

- 12 手元で動くAI ─ DGX Spark

- 13 まとめ ─ これだけ覚えておけばいい

- 14 出典・参考情報

- 15 用語集

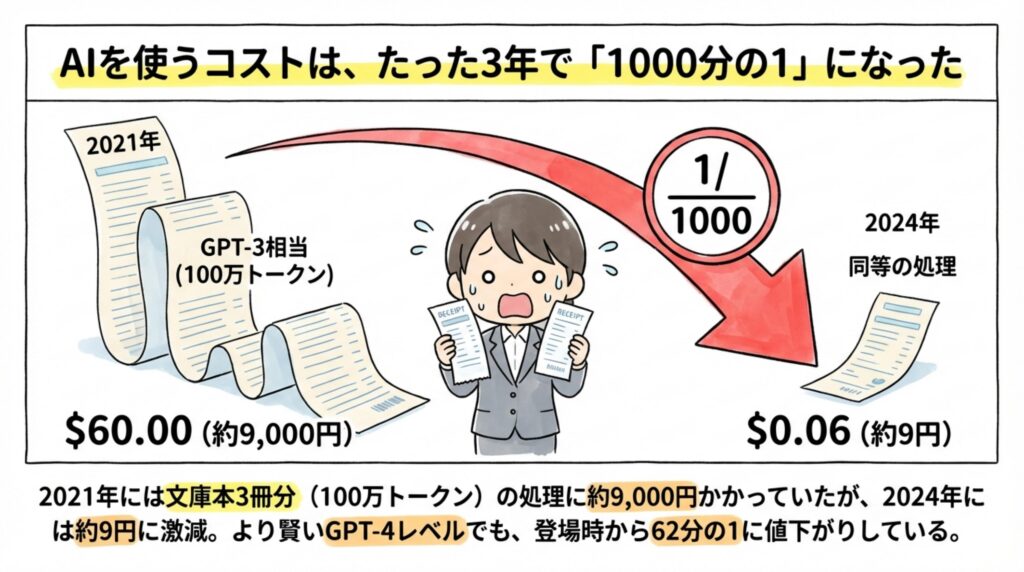

AIを使うコストは3年で1,000分の1になった

数字から入ろう。

2021年、ChatGPTの前身であるGPT-3相当のAIに100万トークン(おおよそ75万語、文庫本3冊分)の処理を頼むと、60ドル(約9,000円)かかった。

2024年、同じレベルの処理にかかる費用は0.06ドル(約9円)。

わずか3年で1,000分の1だ。

より高性能なGPT-4レベルでも、2023年3月の登場時と比べて約50倍以上の低下が確認されている。2026年3月時点では100万トークンあたり0.40ドル(約60円)で利用できる。

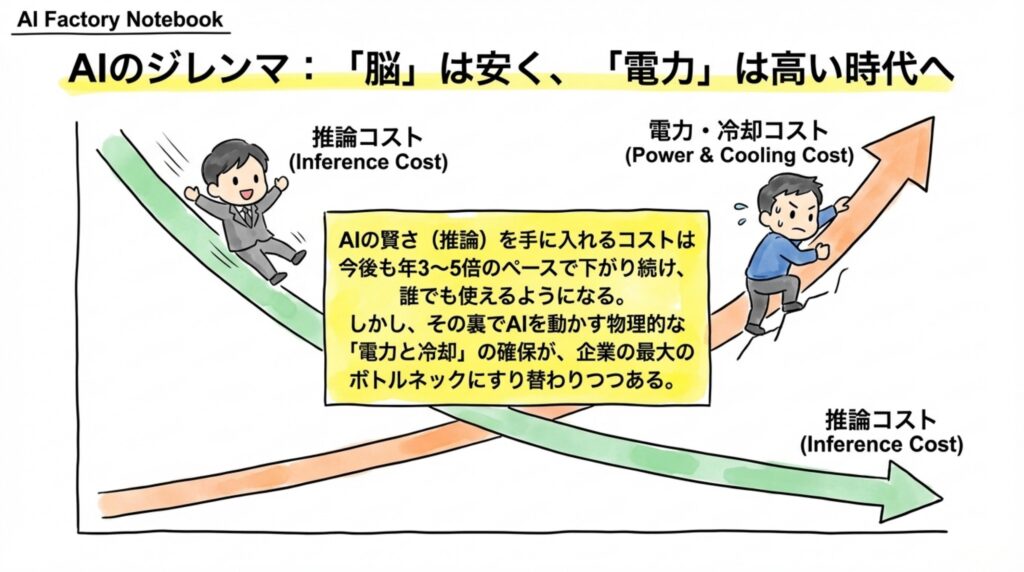

ここまでの下落ペースは「年10倍」だったが、今後は「年3〜5倍」程度に落ち着くと見られている。簡単にできる改善はほぼやり尽くしたためだ。

それでも年3〜5倍の低下が続けば、3年後にはさらに27〜125分の1になる。2026年に60円だったGPT-4レベルの処理が、2029年には0.5〜2円程度になる計算だ。こうなると、あらゆるビジネスの現場にAIを組み込むことが経済的に当たり前になる。

では、なぜこれほどのスピードでコストが下がったのか。その仕組みを理解するために、まず「推論」という概念を整理しておこう。

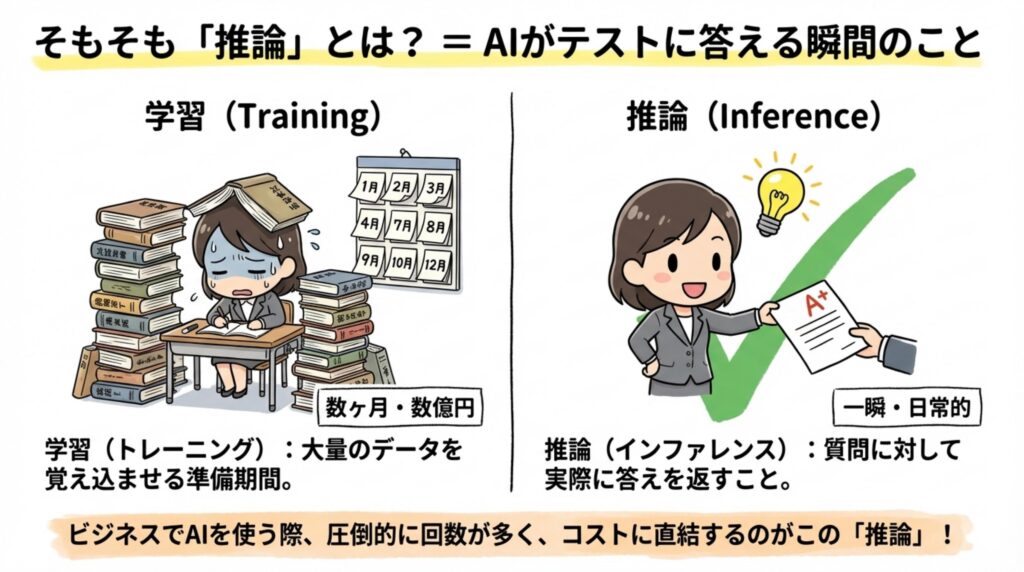

そもそも推論って何?

AIの利用には大きく2つの段階がある。

ひとつは「学習(トレーニング)」。大量のデータからパターンを覚え込ませる工程だ。ChatGPTのようなAIが賢くなるために、数ヶ月・数億ドルかけて行われる。

もうひとつが「推論(インファレンス)」。学習済みのAIに質問して、答えを返してもらう工程である。私たちがChatGPTに質問を打ち込んで回答を受け取るとき、裏側では「推論」が行われている。

最近のAI業界で注目されているのは、この推論のコストだ。なぜなら、AIを実際のビジネスで使う段階では、学習よりも推論のほうが圧倒的に回数が多く、コストに直結する。

推論コストが下がれば下がるほど、AIの用途は広がる。この単純な構造が、半導体メーカー各社の開発競争を激化させている。

なぜここまで安くなったのか

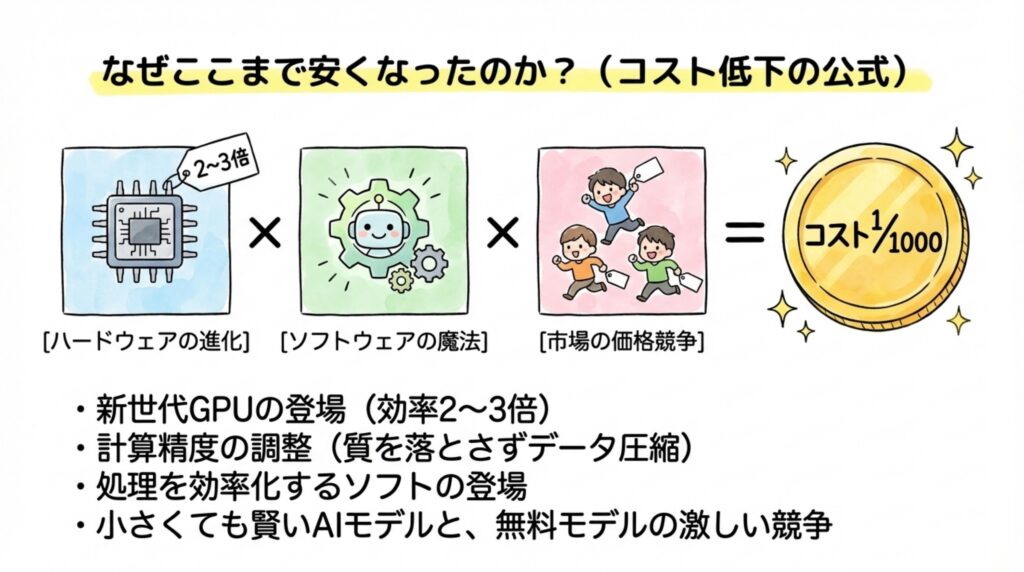

推論コストの急落には、6つの要因がある。

第一に、チップの性能向上。新世代のGPUが出るたびに、処理効率が2〜3倍に跳ね上がる。

第二に、計算精度の最適化。AIの計算では、数値の精度を少し落としても答えの質はほぼ変わらない。この性質を活かし、FP4やFP8といった低精度演算が急速に普及した。

第三に、ソフトウェアの進化。NVIDIAのDynamoに代表される推論最適化ソフトが、同じハードウェアからより多くの処理を引き出している。

第四に、小型モデルの台頭。かつては巨大モデルでないとこなせなかった仕事が、より小さなモデルでも可能になった。

第五に、訓練技術自体の向上。モデルの設計や学習方法が洗練され、同じ性能をより少ないパラメータで実現できるようになっている。

第六に、オープンソースの拡大。無料で使えるAIモデルが増え、価格競争が激化した。MetaのLlamaシリーズに代表されるオープンモデルが、市場全体の価格を押し下げている。

これらが同時に起きた結果、年10倍という異例のスピードでコストが下がった。では、その原動力のひとつであるソフトウェアの側面を、もう少し掘り下げてみよう。

ソフトウェアの力も見逃せない

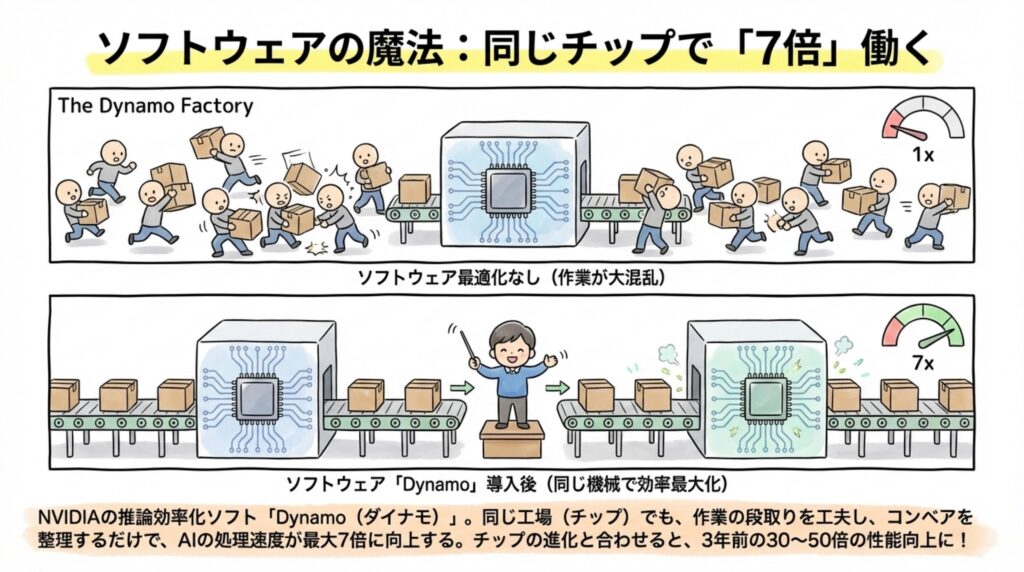

チップの進化だけがAIのコストを下げているわけではない。

NVIDIAが開発した「Dynamo(ダイナモ)」というソフトウェアが、推論処理の効率を劇的に高めている。

たとえるなら、同じ工場(チップ)でも、作業の段取りを工夫するだけで生産量が何倍にもなる。Dynamoはまさにその「段取りの天才」だ。

実際にDynamoを使うと、同じチップでもAIの処理速度が7倍に向上した測定結果がある。チップの世代交代とDynamoの効果を合わせると、3年前のチップと比べて30〜50倍の性能向上になる。

ハードウェアの進化に目を奪われがちだが、ソフトウェアの貢献はそれと同等か、それ以上に大きい。この点は、AI関連の投資を考えるうえで見落とせないポイントだ。

それでは、ハードウェアの側を見ていこう。NVIDIAは2028年までのチップ開発計画をすでに公表している。

NVIDIAのチップ、これからどうなる?

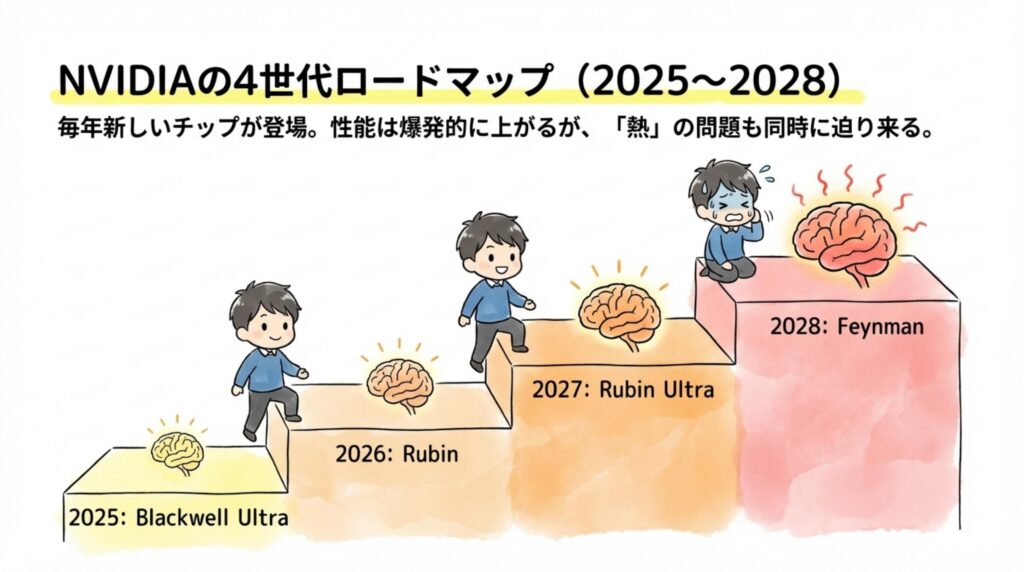

NVIDIAは2025年から2028年にかけて、毎年新しいチップを投入する計画を発表している。

4つの世代を順に見ていこう。

Blackwell Ultra ─ 2025年の最新世代

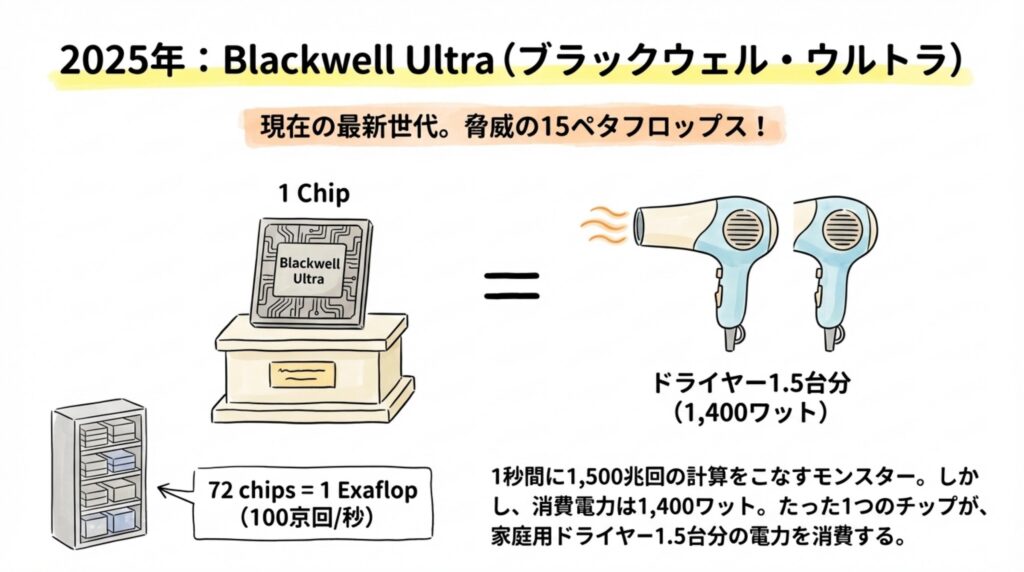

現在の最新世代がBlackwell Ultra(ブラックウェル・ウルトラ)だ。

GPUひとつで15ペタフロップス(毎秒1,500兆回の計算)というAI推論性能を持つ。消費電力は1,400ワット。家庭用ドライヤーの約1.5倍の電力を、たった1つのチップが使う。

NVIDIAのCEOジェンスン・ファンがGTC 2025のステージで手のひらに載せて見せたのがこのチップだ。72個をラック(棚型のサーバー装置)にまとめると、1エクサフロップス(毎秒100京回の計算)を超える。

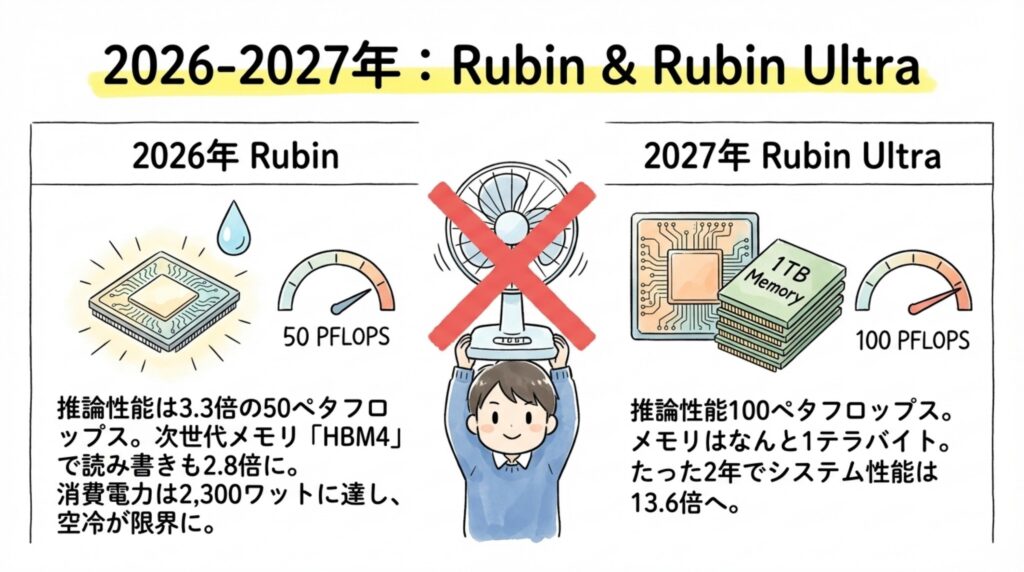

Rubin & Rubin Ultra ─ 2026〜2027年の主役

2026年後半に登場するRubin(ルービン)。推論性能は50ペタフロップスと、Blackwell Ultraの3.3倍に跳ね上がる。新しいメモリ技術「HBM4」を採用し、データの読み書き速度が約2.3倍(HBM3E比)になる。

ただし消費電力も1,800〜2,300ワットに増加する。もはやファンで風を送って冷やす「空冷」では対応できず、液体で冷やす「液冷」が必須になる。

2027年後半にはRubin Ultra(ルービン・ウルトラ)が控える。推論性能は100ペタフロップス。メモリは1テラバイト(1,000ギガバイト)に拡大する。Blackwell Ultraからわずか2年で、システム全体の性能は大幅に向上する見込みだ。

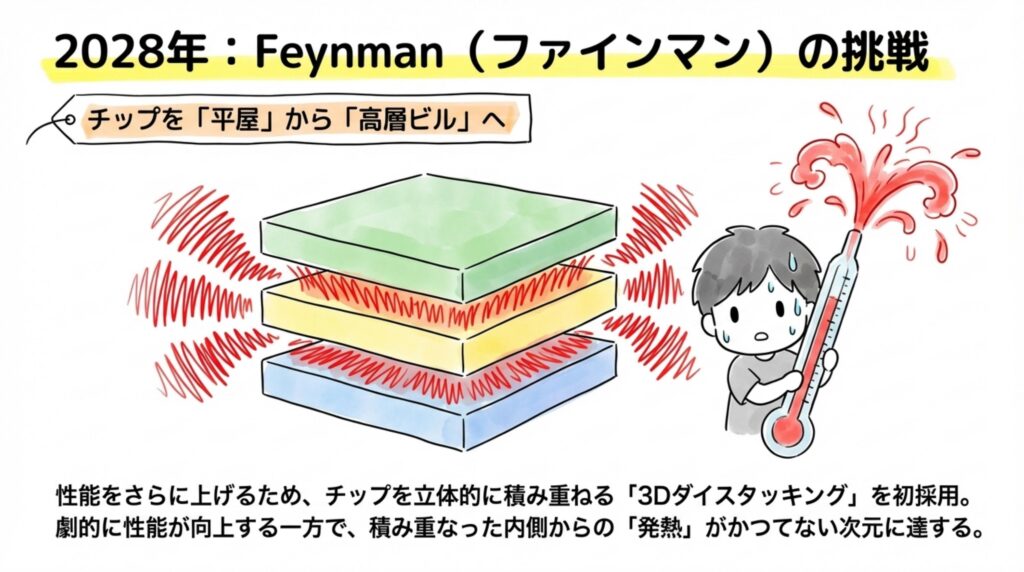

Feynman ─ 2028年、未知の領域へ

2028年に登場予定のFeynman(ファインマン)は、NVIDIAにとって技術的な大きな挑戦になる世代だ。

チップを立体的に積み重ねる「3Dダイスタッキング」という新技術を初めて採用する。実装面積あたりの性能を飛躍的に高められるが、発熱の問題がさらに深刻になるため、従来とはまったく異なる冷却技術が必要になる。

毎年これだけの性能向上が続くとなると、当然の疑問が浮かぶ。電力はどうするのか。

電力問題 ─ チップが強くなるほど電気を食う

話のいいところだけではない。大きな課題がある。それが「電力」だ。

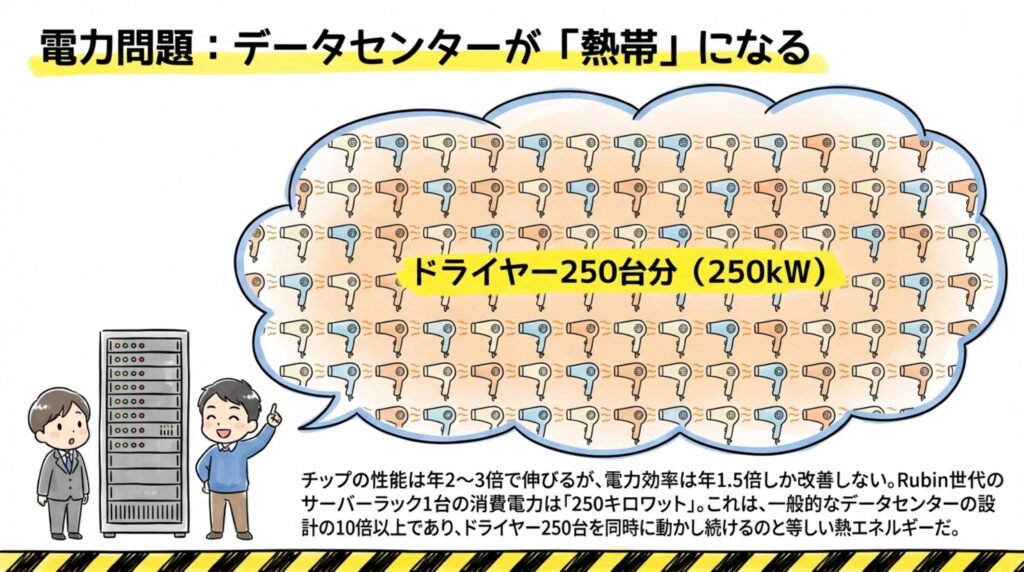

チップの性能は年2〜3倍で伸びているが、電力効率の改善はそれに追いつかない。つまり、性能が上がるほど、消費電力も増えていく。

2023年のHopper世代が700ワット。2025年のBlackwell Ultraが1,400ワット。2026年のRubinは1,800〜2,300ワットに達する。

サーバーラック1台の消費電力も急騰している。一般的なITラックが10〜20キロワットで設計されていたのに対し、Rubin世代では250キロワットを超える。10倍以上だ。

この電力を冷やすには、もう「ファンで風を送る」方式(空冷)では追いつかない。

チップに直接冷却液を流す「液冷」や、サーバーごと冷却液に浸す「液浸冷却」が必要になる。

結果として、「どこにデータセンターを建てるか」「安定した電力をどう確保するか」が、AI事業の成功を左右する時代になりつつある。

電力の制約は、NVIDIAの独壇場に風穴を開ける要因にもなっている。

NVIDIAだけじゃない ─ ライバルたちの動き

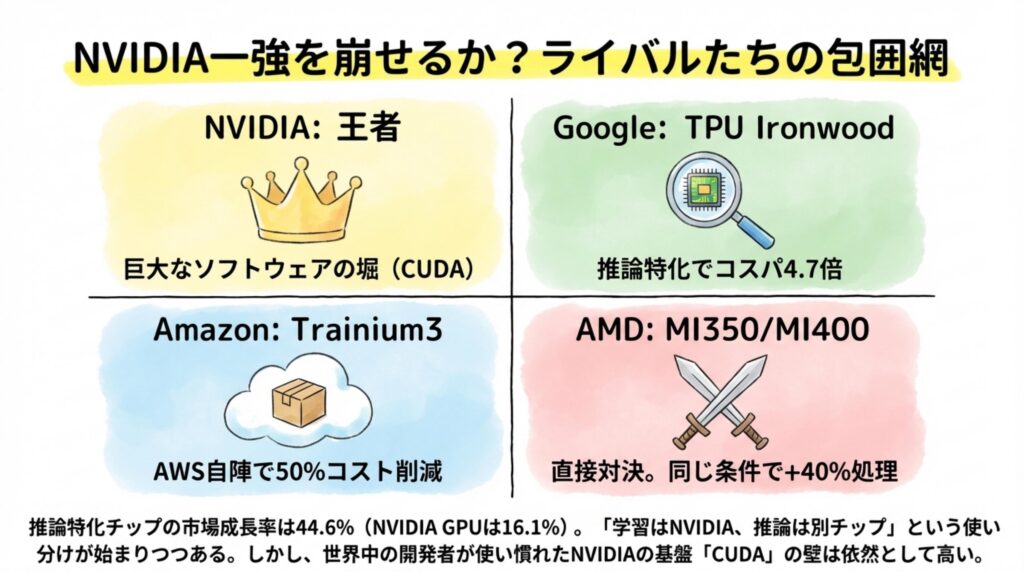

AI用チップの世界は、NVIDIAの独壇場ではなくなりつつある。

Google(TPU Ironwood)は、「推論の時代のためのTPU」として新チップを開発した。推論処理に特化した設計で、電力効率面での優位性を主張している。

Amazon(Trainium3)は、AWSのクラウド環境に最適化されたチップだ。NVIDIAのGPUと比べて50%のコスト削減を掲げる。

AMD(MI350/MI400)は、NVIDIAへの最も直接的な対抗馬だ。NVIDIAのB200比でコスト当たりの処理量が40%多いと主張し、2026年後半にはNVIDIAのサーバーラックに直接対抗する製品を投入する。

アナリスト予測による2026年の見通しでは、推論に特化したカスタムチップの出荷成長率は44.6%。NVIDIAのGPU成長率16.1%を大きく上回る。「学習はNVIDIA、推論は別のチップ」という使い分けが進む可能性がある。

一方で、NVIDIAの最大の強みは「CUDA」というソフトウェア基盤だ。世界中の何百万人もの開発者がCUDAを使ってAIプログラムを書いており、この「慣れ」と「蓄積」を他社が追い越すのは容易ではない。

競争が激しくなるのは、ユーザーにとっては朗報だ。ただし、一つのジレンマも生まれている。

安くなるほど使われ、使われるほど足りなくなる

推論コストが下がれば、AIの用途は爆発的に広がる。

用途が広がれば、計算需要が増える。計算需要が増えれば、さらに高性能なチップと、さらに多くの電力が必要になる。

これがAI業界の根本的なジレンマだ。

コスト低下は確かに「AIの民主化」を加速させている。しかし同時に、インフラの制約が新たなボトルネックとして浮上している。

チップの能力、ソフトウェアの効率、電力の確保。この3つのバランスが、今後のAI普及のスピードを決める。

手元で動くAI ─ DGX Spark

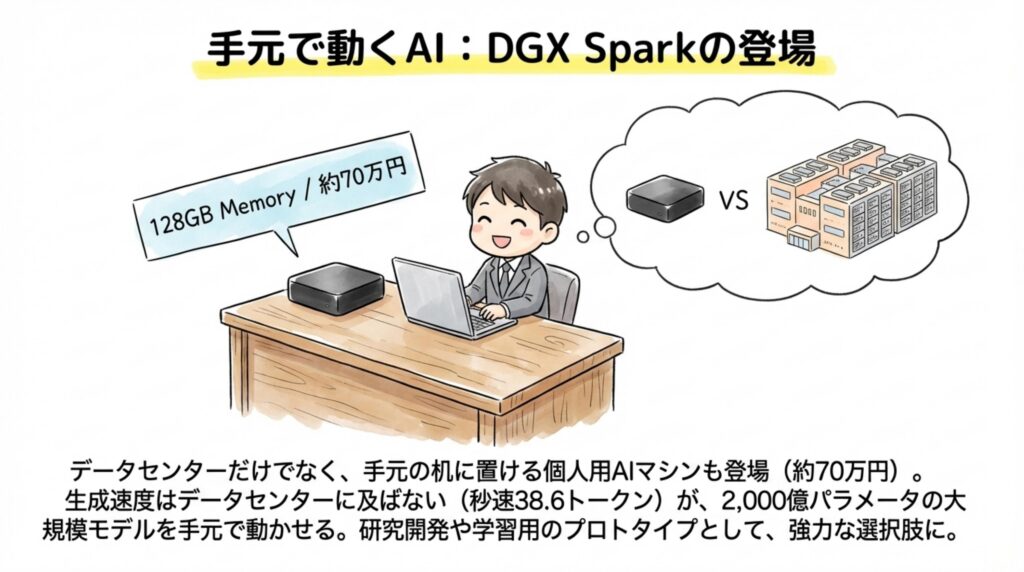

データセンターだけがAIの舞台ではない。

NVIDIAは個人向けのAIマシン「DGX Spark」も発売している。128ギガバイトのメモリを搭載し、2,000億パラメータの大規模AIモデルを手元で動かせる小型コンピュータだ。

価格は当初3,999ドルだったが、メモリ不足の影響で4,699ドル(約70万円)に値上げされた。

ただし、トークンの生成速度は約38トークン/秒(レビューサイトの測定値)にとどまり、データセンターの本格的なGPUには遠く及ばない。研究・開発のプロトタイプ用途や、AIを学ぶための教材としての位置づけが現実的だ。

クラウドで動かすか、手元で動かすか。この選択肢が広がること自体が、AIの活用シーンが多様化している証拠だ。

まとめ ─ これだけ覚えておけばいい

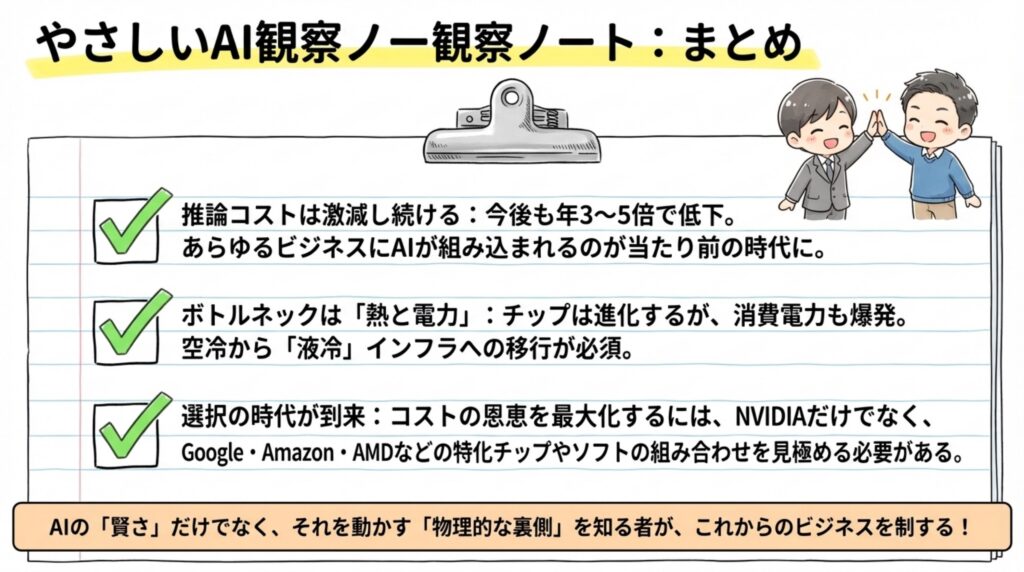

冒頭で触れた「3年で1,000分の1」というコスト低下。これは偶然の産物ではない。

チップの進化、ソフトウェアの最適化、市場の競争。この3つが掛け合わさって実現した。

NVIDIAは毎年新しいAIチップを投入し、2028年のFeynmanまでのロードマップを公表している。性能は毎年2〜3倍のペースで伸びる。

AIの推論コストは今後も年3〜5倍のペースで下がり続ける見通しだ。

ただし、チップの消費電力が急増しており、液冷が必須のインフラになる。電力の確保がAI事業のボトルネックになりつつある。

Google、Amazon、AMDが推論特化チップで攻勢をかけ、NVIDIAの一強体制に変化の兆しがある。

AIを「使う側」にとってのメッセージはシンプルだ。推論コストは今後も下がり続ける。ただし、その恩恵を最大限に受けるには、どのチップを使うか、どのクラウドを選ぶか、どのソフトウェアで最適化するかを、セットで考える必要がある。

3年前に9,000円だった処理が、今は9円。3年後には1円を切るかもしれない。この流れを理解した上で、自社のAI戦略をどう描くか。それが、今もっとも重要な経営判断のひとつだ。

出典・参考情報

・ NVIDIA Technical Blog: Inside Blackwell Ultra

・ NVIDIA Blog: MLPerf Inference Blackwell Ultra

・ NVIDIA Technical Blog: Introducing Dynamo

・ NVIDIA Technical Blog: Dynamo 1.0 Production Ready

・ Barrack AI: NVIDIA Rubin Full Technical Breakdown

・ Tom’s Hardware: Vera Rubin Platform In Depth

・ WCCFTech: Feynman GPU 3D Die Stacking

・ Epoch AI: LLM Inference Price Trends

・ a16z: LLMflation — LLM Inference Cost Going Down Fast

・ AMD Blog: Instinct MI350 Series and Beyond

・ Introl Blog: Amazon Trainium3

・ IntuitionLabs: DGX Spark Review

用語集

ペタフロップス(PFLOPS) — 1秒間に1,000兆回の浮動小数点演算を行う計算速度の単位。数字が大きいほど処理が速い。

トークン — AIがテキストを処理する際の最小単位。日本語では1文字〜数文字が1トークンに相当する。

HBM(High Bandwidth Memory) — GPUに直結された超高速メモリ。通常のメモリより何倍も速くデータをやり取りできる。

TDP(Thermal Design Power) — チップが最大稼働時に消費する電力の設計値。ワット数で表す。

液冷 — チップやサーバーを液体で冷却する方式。空気で冷やす空冷より効率が高いが、設備投資が必要。

3Dダイスタッキング — チップを平面に並べるのではなく、立体的に積み重ねて実装面積あたりの性能を高める技術。

CUDA — NVIDIAが開発したGPUプログラミング基盤。AI開発者のほとんどがこれを使っており、他社チップへの乗り換えを難しくしている。

FP4/FP8 — 数値の精度(ビット数)を表す。FP4は4ビット、FP8は8ビット。精度を下げるとメモリ消費が減り処理が速くなるが、計算結果の正確さはわずかに低下する。

TCO(Total Cost of Ownership) — 機器の購入費だけでなく、電気代・冷却費・保守費など運用全体にかかる総コスト。