「今後3年間で、データセンター向けチップの売上だけで1兆ドル(約150兆円)を超える」。

2026年3月、サンノゼで開催されたNvidia GTC 2026の壇上で、Jensen Huang CEOはそう宣言した。

2025年10月のGTC Washington D.C.で示した5,000億ドルの見通しを、一気に倍へ引き上げた格好だ。

この数字は単なる業績予測ではない。AIが「試しに使ってみる段階」を終え、企業の基幹システムとして本格的に組み込まれ始めた証拠である。

GTC 2026の発表は多岐にわたる。だが日本のビジネスパーソンが押さえるべきメッセージは5つに集約される。

AIエージェントの開発基盤が無償公開されたこと。AIを「動かす」コストが毎年大幅に下がる見通しが示されたこと。AIが画面の中を飛び出し、工場や道路で実際に動き始めること。日本のAI基盤が急速に整備されていること。そしてNvidiaへの依存という新たなリスクが浮上していること。

目次

- 1 AIエージェントの「業務ツール化」が始まった

- 2 15社以上の業務ソフト大手が一斉に動いた

- 3 AIエージェントは「自社開発」から「標準搭載」に変わる

- 4 AIを「動かす」コストが急降下する

- 5 「今年は見合わないAI活用」が来年には現実的になる

- 6 AIが工場や道路で動き始める — 「物理AI」の時代

- 7 デジタルツインは「ロボットを買わなくても始められる」入口

- 8 日本のAI基盤が一変した — ソフトバンクとNTTの巨額投資

- 9 「日本にAI基盤がない」という認識は過去のものになった

- 10 「Nvidiaへの依存」というもう一つの現実

- 11 マルチベンダー戦略はリスク軽減とコスト最適化の両面で合理的

- 12 ビジネスパーソンが今日からできる3つのこと

- 13 問われているのは「AIを使うかどうか」ではない

- 14 出典・参考情報

AIエージェントの「業務ツール化」が始まった

GTC 2026で最も戦略的な発表は、半導体チップではなくソフトウェアだった。

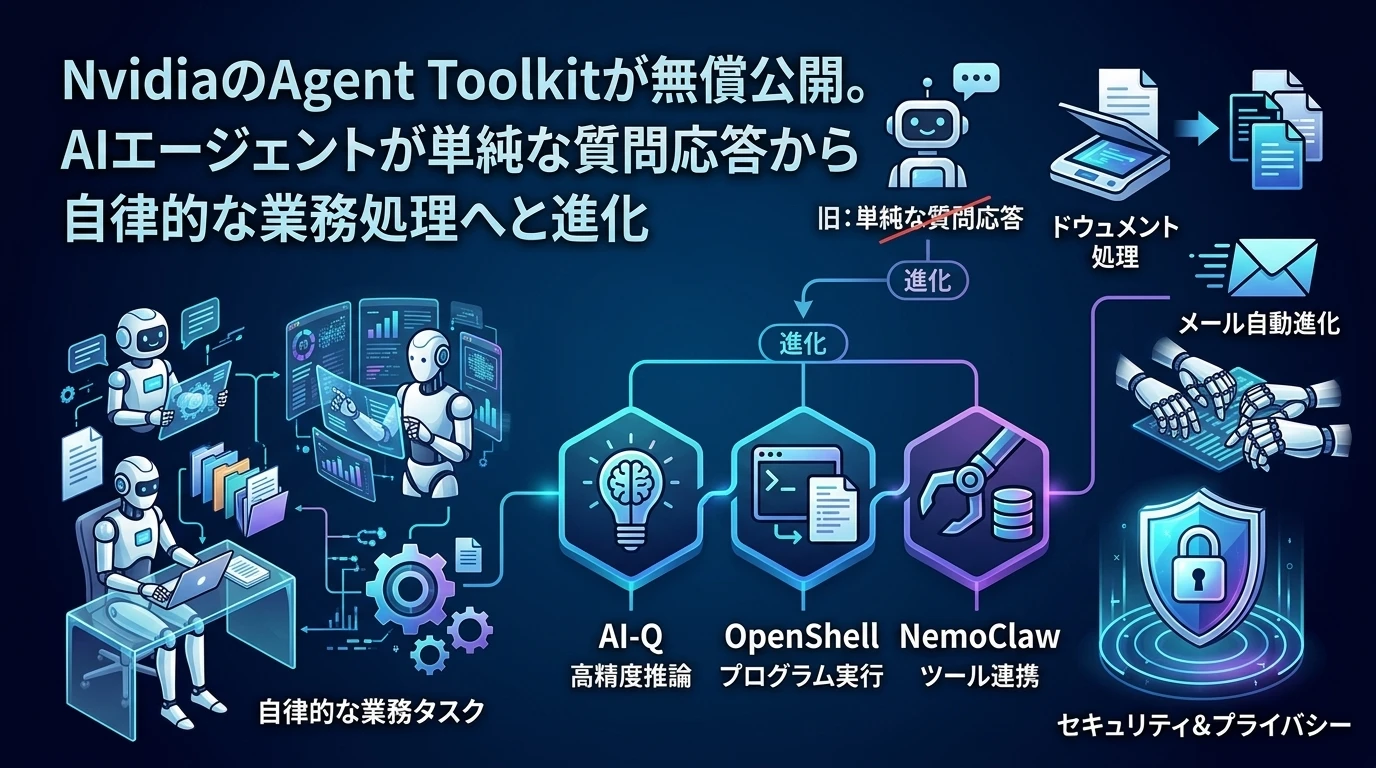

Nvidiaが公開した「Agent Toolkit」は、AIエージェントの開発基盤を無償で提供するものだ。

ここでいうAIエージェントとは、ChatGPTのように質問に答えるだけのAIではない。「この書類を確認して、問題があれば担当者にメールして、結果を報告して」といった一連の業務を自律的にこなすAIシステムを指す。

Agent Toolkitは3つの柱で構成される。

1つ目が「AI-Q」。エージェント設計のオープンブループリントであり、さまざまなAIエージェント開発ツールを横断的につなぐ部品だ。社内文書の検索機能や、エージェントの動きを監視する仕組みを一括で提供する。マイクロソフトのクラウド基盤にも組み込み済みで、開発者はすぐに使い始められる。

2つ目が「OpenShell」。AIエージェントを安全に動かすための「隔離部屋」のような仕組みだ。従来のAIセキュリティは「AIへの指示文で行動を制限する」方法が主流だった。だがこの方法では、巧妙な攻撃を受けると制限を突破されるリスクがあった。

OpenShellは発想を変えた。「そもそもAIが操作できる範囲をシステムの構造として制限する」設計にしたのだ。たとえば「社内データベースの閲覧はできるが、外部への送信はできない」といった制約を、実行環境そのものに組み込む。企業がAIエージェントを導入する際の最大のハードル、セキュリティ懸念に根本的な仕組みで応えた。

3つ目が「NemoClaw」。OpenShellの上に安全装置を追加し、1つのコマンドで常駐型AIアシスタントを起動できるツールだ。

さらに、企業の社内データとAIエージェントを接続する設計図「AI-Q Blueprint」も発表された。OpenAIやAnthropicなどの高性能商用AIを「司令塔」として使い、Nvidiaの無償公開AIモデル「Llama Nemotron」を実際の調査作業に使い分ける。この仕組みにより、問い合わせ1件あたりのコストを50%以上削減できる。

15社以上の業務ソフト大手が一斉に動いた

Agent Toolkitの発表と同時に、企業向けソフトウェア大手が次々と採用を表明した。

SAPは自社の開発環境上で、顧客やパートナーが業務に特化したAIエージェントを設計できる機能を提供する。受発注処理、在庫管理、経理業務など、SAPを使っている企業にとっては馴染みのある業務フローに、AIエージェントが組み込まれる道が開けた。

ServiceNowはNvidiaと共同で業務特化型のAIモデルを開発した。IT運用管理の現場で、障害対応やワークフロー自動化を担うAIエージェント群を構築する。

Salesforceは自社のAI基盤とNvidiaを接続。クラウドと社内サーバーのデータをSlack経由で統合活用するエージェントの構築を可能にした。営業支援やカスタマーサポートの自動化が具体的に動き出す。

Adobe、Atlassian、Box、Cisco、CrowdStrike、Siemensなども参画しており、いわば「業務ソフトのAIエージェント対応」が業界全体で一斉に始まった。

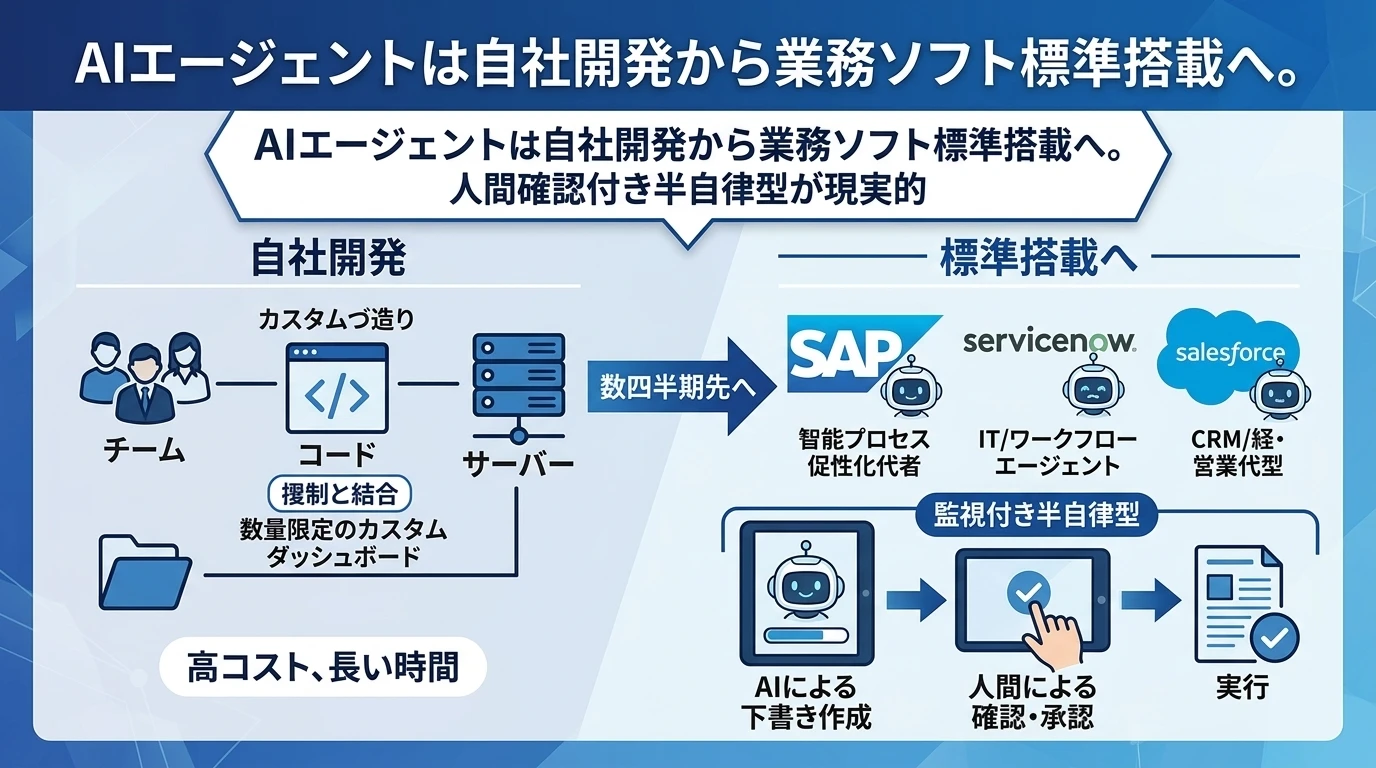

AIエージェントは「自社開発」から「標準搭載」に変わる

押さえるべきは、AIエージェントが「自社でゼロから開発するもの」から「普段使っている業務ソフトに標準搭載されてくるもの」に変わりつつある点だ。

SAP、ServiceNow、Salesforceといった既存の業務基盤に、エージェント機能が組み込まれる未来は数四半期先の話かもしれない。

ただし、現時点で完全にAI任せの大規模導入はまだ少ない。コンサルティング大手Bain & Companyの分析によれば、実用的なのは人間の最終確認を伴う「半自律型」のエージェントだ。

「AIに任せきりにする」のではなく「AIに下書きを作らせ、人間が確認する」フローを想定し、社内のチェック体制を先に整えるのが現実的な第一歩になる。

では、エージェントを動かすコストはどうなるのか。

AIを「動かす」コストが急降下する

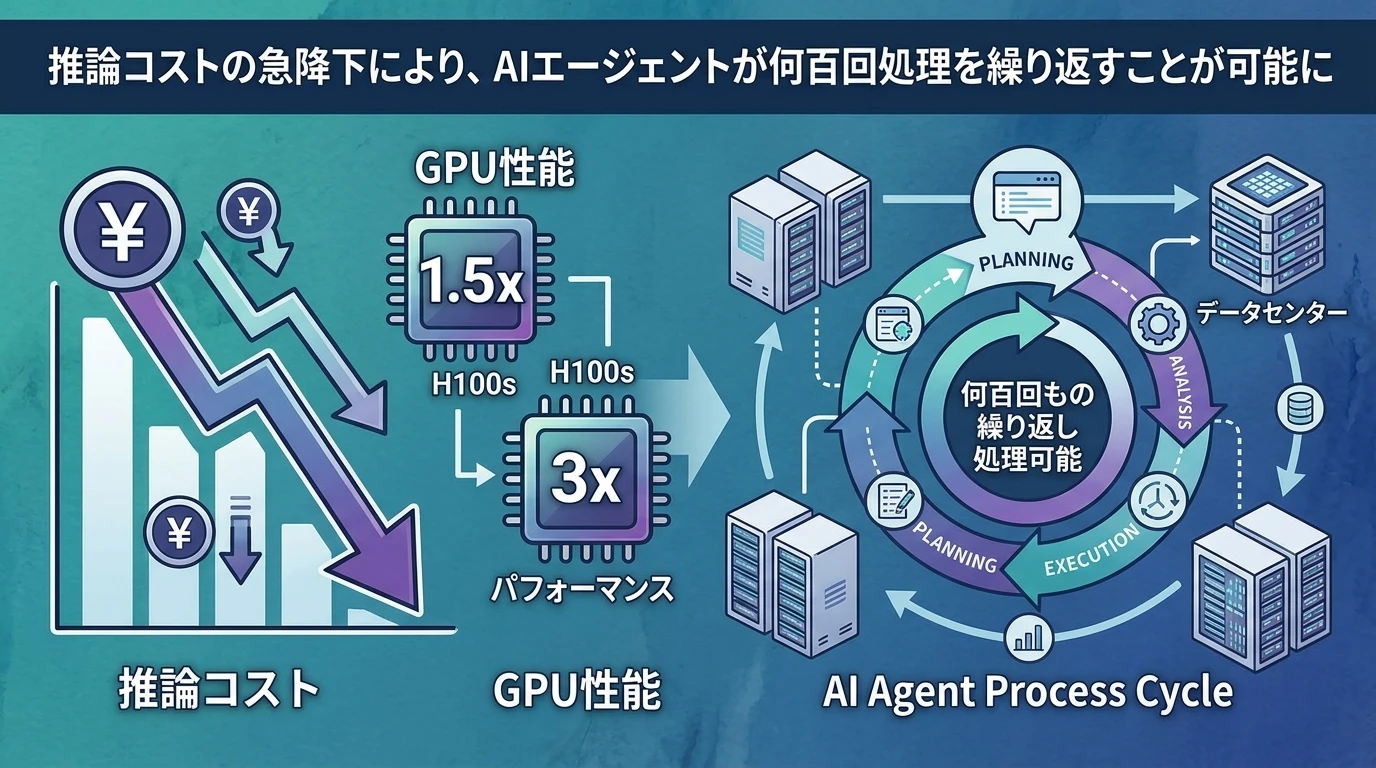

AIエージェントの実用化を支えるのが、AIを動かすコストの低下だ。

ここでいう「動かすコスト」とは、学習済みのAIに質問を投げて答えを返してもらう処理(推論)にかかる費用のことだ。ChatGPTに質問するたびに、裏側ではこの推論処理が走っている。

AIエージェントは1つのタスクを完了するために何十回、何百回とこの推論を繰り返す。1回あたりの推論コストの高さが、エージェント普及の最大のボトルネックだった。

GTC 2025で発表された最新チップ「Blackwell Ultra」は、前世代に比べてAIの推論性能をGPUあたり最大1.5倍に引き上げた。最新のサーバーラック1台で、スマートフォン数億台分に相当する計算能力を実現する。

そしてGTC 2026では、さらにその先の計画が明確になった。

| 年 | チップ世代 | ポイント |

| 2025 | Blackwell Ultra | 推論性能をGPUあたり最大1.5倍に向上 |

| 2026後半 | Vera Rubin | 前世代比で処理能力が約3倍に。動作コストも大幅低減 |

| 2027後半 | Rubin Ultra | さらに倍の処理能力。メモリも大容量化 |

| 2028 | Feynman | チップの構造自体が変わる新設計(チップを縦に積み重ねて性能を高める技術を採用) |

毎年新世代のチップが投入され、世代ごとに数倍の性能向上が見込まれる。Nvidiaはこれを「年次更新ロードマップ」として正式に約束した。

ソフトウェア面でも進展があった。無償公開された推論処理ソフト「Dynamo」は、複数のチップに処理を分散させることで、特定の条件下で処理量を最大30倍以上に引き上げる。

AIエージェントが直前の処理内容を「一時記憶」として保持するチップに、次のリクエストを優先的に送る機能も備えている。エージェント特有の連続処理を効率化する仕組みだ。

加えて、個人向けAIコンピュータ「DGX Spark」も発表された。3,999ドルからスタートし、現在は4,699ドル(約70万円)。数年前ならサーバールーム級の性能を、デスクトップサイズの筐体で実現する。研究者や開発者が手元で本格的なAIモデルを動かせる時代が到来した。

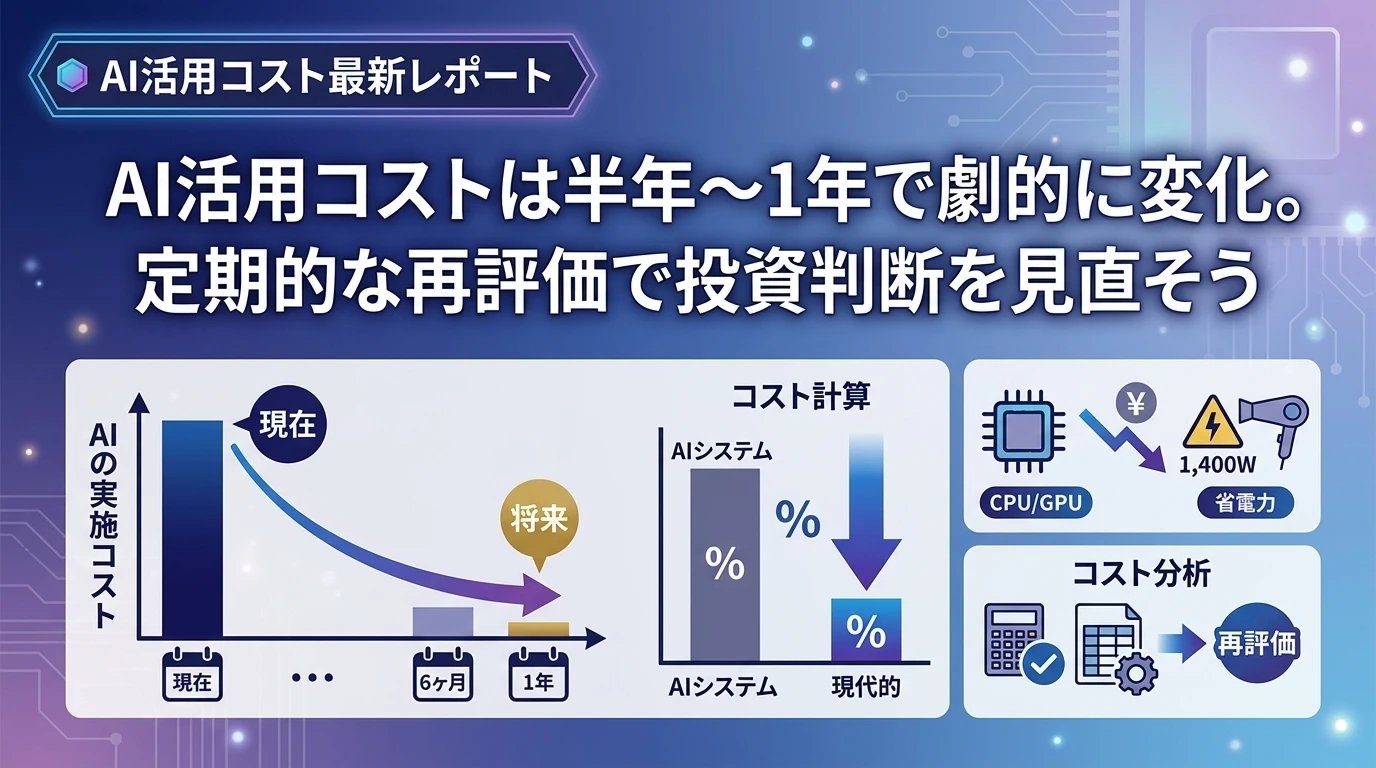

「今年は見合わないAI活用」が来年には現実的になる

「今年はコスト的に見合わないAI活用でも、来年には現実的になる可能性がある」。これがチップ戦略の最大のメッセージだ。

社内チャットボットの運用費、文書の自動要約、カスタマーサポートの自動応答。人手で行っている業務のAI化コストを、定期的に再計算してみる価値がある。

AI投資の判断基準を固定せず、半年から1年単位で見直す柔軟さが求められる。

ただし注意点がある。チップ単体の性能が上がっても、企業が実際に支払う総コスト(電力代・冷却設備・運用人件費を含む)が同じペースで下がるとは限らない。最新チップの消費電力は1基あたり1,400ワット。一般的なドライヤー1台分以上だ。データセンター側の電力・冷却設備の制約も考慮が必要になる。

AIの進化はパソコンやスマートフォンの画面の中にとどまらない。

AIが工場や道路で動き始める — 「物理AI」の時代

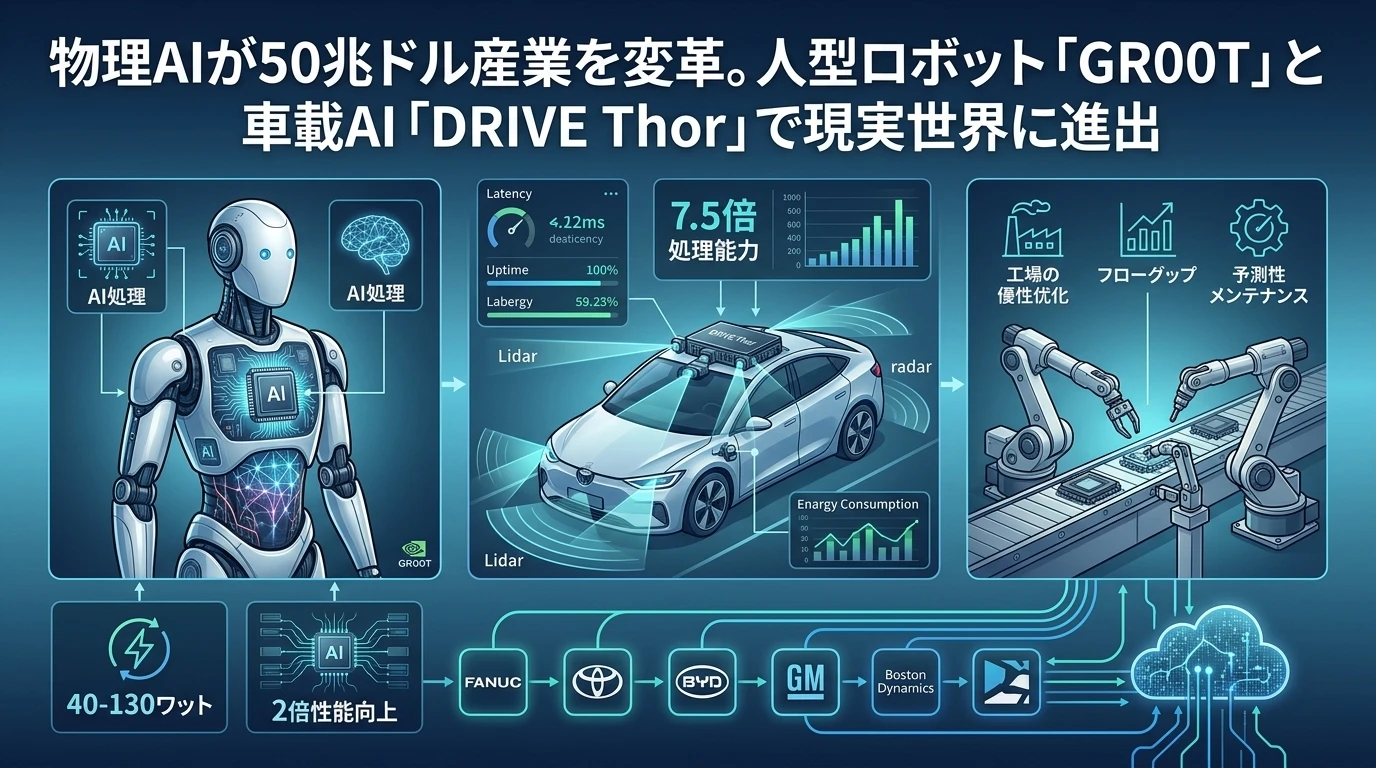

Jensen Huangが「50兆ドル規模の産業を変革する技術」と呼んだのが「物理AI」だ。

AIが現実世界の物理法則 — 重力、摩擦、物体の形状や動き — を理解し、ロボットや自動運転車として実際に行動する技術を指す。GTC 2025から2026にかけて、この構想が具体的な製品群とパートナーシップを伴って形になった。

人型ロボット向けのAIモデル「GR00T」がオープンモデルとして公開された。カメラで周囲の状況を認識し、言葉による指示を理解し、人間のような滑らかな動きを自動生成する。

最新版では「あれを片付けて」のような曖昧な指示でも、具体的な動作の手順を自分で考えて実行できるようになった。次世代モデル「Isaac GR00T N2」では、作業の成功率が従来の2倍以上に向上している。

ロボットに搭載する専用コンピュータ「Jetson Thor」も発表された。処理能力が前世代の7.5倍に跳ね上がりながら、消費電力は家庭用電球数個分(40〜130ワット)に収まる。ロボットの体内に組み込めるサイズと電力で、本格的なAI処理を可能にした。

自動運転の分野では、車載コンピュータ「DRIVE Thor」に中国のBYD、米国のGM、カナダのMagnaなどが採用を表明。2025年9月から開発キットの出荷が始まる。

産業用ロボットの世界でも動きは大きい。FANUC、安川電機、Amazon RoboticsなどがNvidiaの仮想空間シミュレーション基盤「Omniverse」のパートナーとして参画。現実の工場をそっくり再現した仮想空間(デジタルツイン)を構築している。Boston Dynamicsも物理AI全般の領域で連携を進めている。

トヨタ、Foxconn(iPhone製造受託で知られる台湾企業)、TSMC(世界最大の半導体製造受託企業)も導入を進めている。

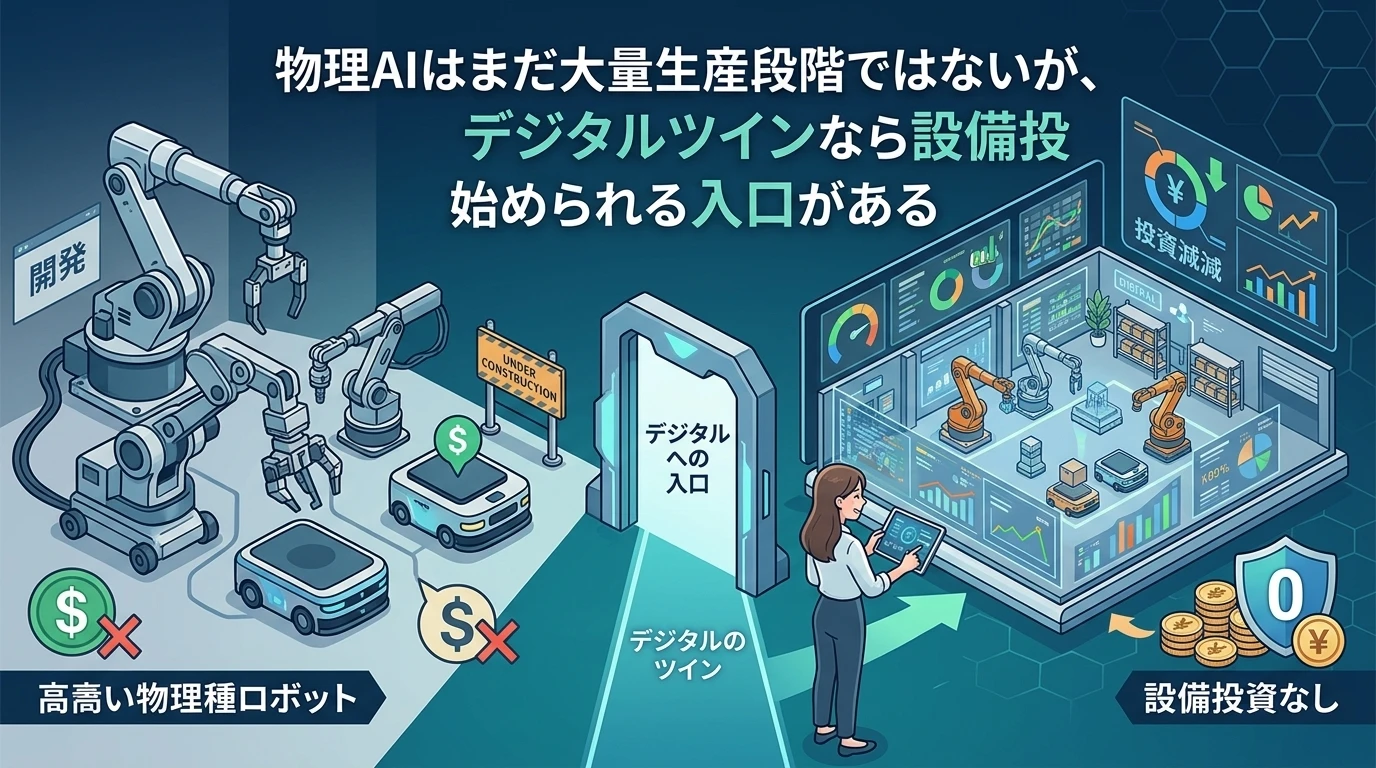

デジタルツインは「ロボットを買わなくても始められる」入口

物理AIはまだ大量生産の段階ではない。しかし、製造・物流・自動車に関わるなら注視すべき速度で進んでいる。

特にデジタルツインは「ロボットを1台も買わなくても始められる」取り組みだ。工場や倉庫のレイアウト最適化、作業手順のシミュレーションなど、大きな設備投資なしに始められる入口がある。

「50兆ドル」という数字はJensen Huangが物理AIの変革対象として挙げた産業規模であり、50〜70兆ドルと幅がある。対象市場の範囲や時間軸には留意が必要だが、産業界の関心は確実に高まっている。

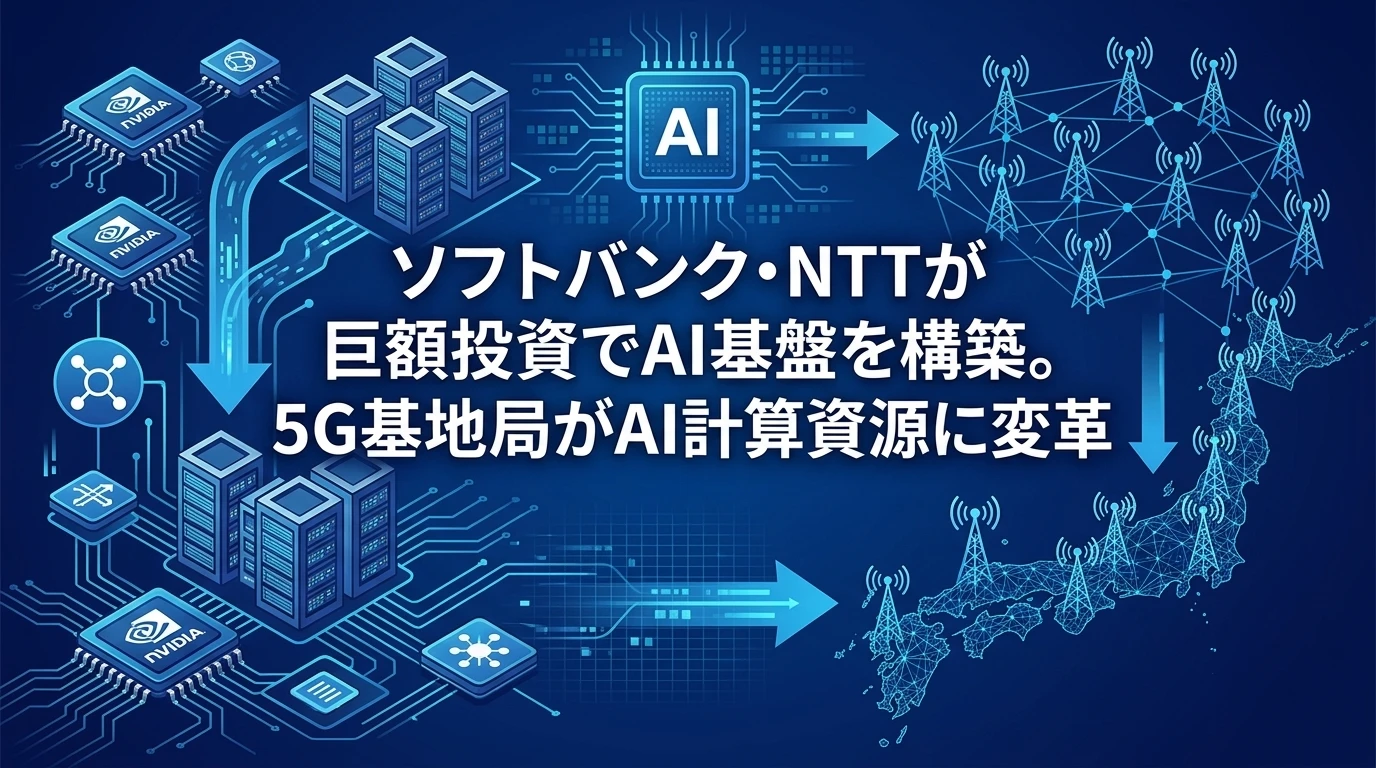

日本のAI基盤が一変した — ソフトバンクとNTTの巨額投資

GTC 2026の発表は海の向こうの話ではない。日本のAI基盤は直近1年で劇的に変わった。

ソフトバンクはNvidiaの最新チップを1,224基搭載したAI計算基盤を2025年12月に稼働させた。将来的にはチップ4,000基超への拡張を計画し、クラウド経由でのAI計算サービスも開始している。

北海道苫小牧には国内最大級のAIデータセンターを建設中で、2026年度の稼働を予定する。

NTTは5年間で8兆円の投資を計画。NTTデータの約2.4兆円での完全子会社化によりAI戦略を統合し、通信インフラとAIの融合を推進している。

NvidiaとソフトバンクはAI-RAN(エーアイ・ラン)と呼ばれる技術の世界初の屋外実験を神奈川県で実施した。通常の5G通信と同じ基地局設備を使って、通信処理とAI処理を同時に行う技術だ。

全国に張り巡らされた5Gの通信設備が、そのままAIの計算資源としても使えるようになる可能性がある。通信事業者にとっては新たな収益源に、利用者にとってはAIサービスの地方展開につながりうる。

日本全体では、政府と民間を合わせたAI関連のインフラ投資が1,350億ドル(約20兆円)規模に達しているとされる。各種報道の推計を総合した数字であり、量子コンピューティング(AIとは異なる次世代計算技術)への投資も含まれている。AI単体の投資額はこれより小さい。

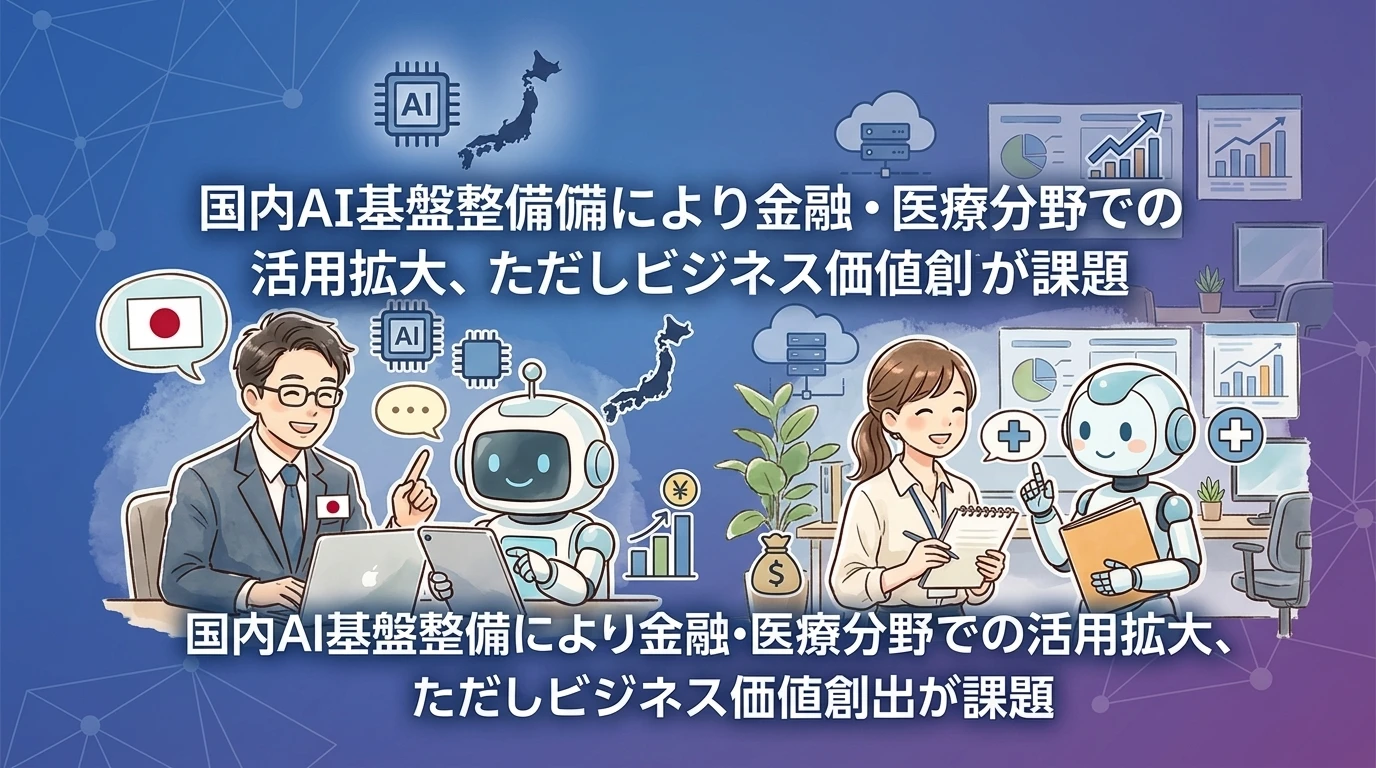

「日本にAI基盤がない」という認識は過去のものになった

計算リソースを国内で調達できるようになったことで、データの海外持ち出しに慎重な金融・医療・公共セクターでもAI活用の選択肢が広がった。

一方で、インフラが整備されることと、その上で実際にビジネス価値を生み出すことは別の話だ。インフラはあくまで手段であり、「何のためにAIを使うのか」という問いに先に答えておく必要がある。

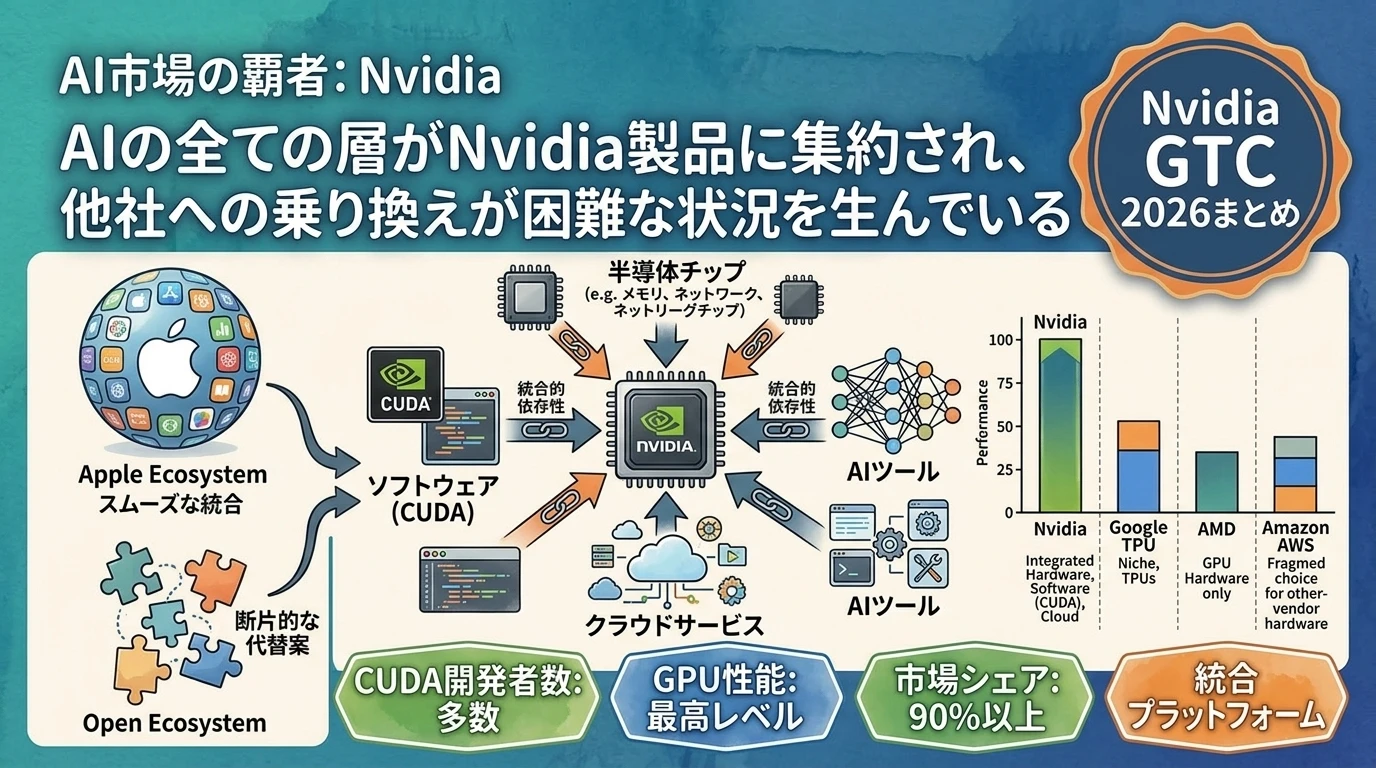

「Nvidiaへの依存」というもう一つの現実

ここまでの発表を俯瞰すると、構造的なリスクが浮かび上がる。

ある業界メディアの記者は「GTC is now a tour of dependency(GTCは依存のツアーになった)」と表現した。半導体チップからソフトウェア、クラウドサービスまで、AIを支えるあらゆる層がNvidiaの製品群に集約されつつある。

Agent Toolkitは「無償公開」だが、最大の性能を発揮するにはNvidia製のチップと専用ソフト(CUDA:クーダ。Nvidia製チップ上でAI処理を高速に動かすための基盤ソフトウェア)が前提となる。「Nvidiaの世界の中での開放」と捉える方が正確だろう。

競合は存在する。Googleの自社開発チップ「TPU」最新世代は、特定の推論処理においてコスト効率で最大4倍の優位を主張している。半導体大手AMDの最新チップも、AI処理性能を前世代から大幅に向上させた。AmazonのクラウドサービスAWSが開発した自社チップも、特定の処理では効率的だ。

しかしNvidiaの強みは、個々のチップの性能だけではない。チップ、通信機器、ソフトウェアをすべて自社グループで一括提供できる「総合力」にある。

Apple製品同士の連携が他社製品より滑らかなのと似た構造だ。この包括的なサービスが、一度使い始めると他社に乗り換えにくい状況(ベンダーロックイン)を生んでいる面もある。

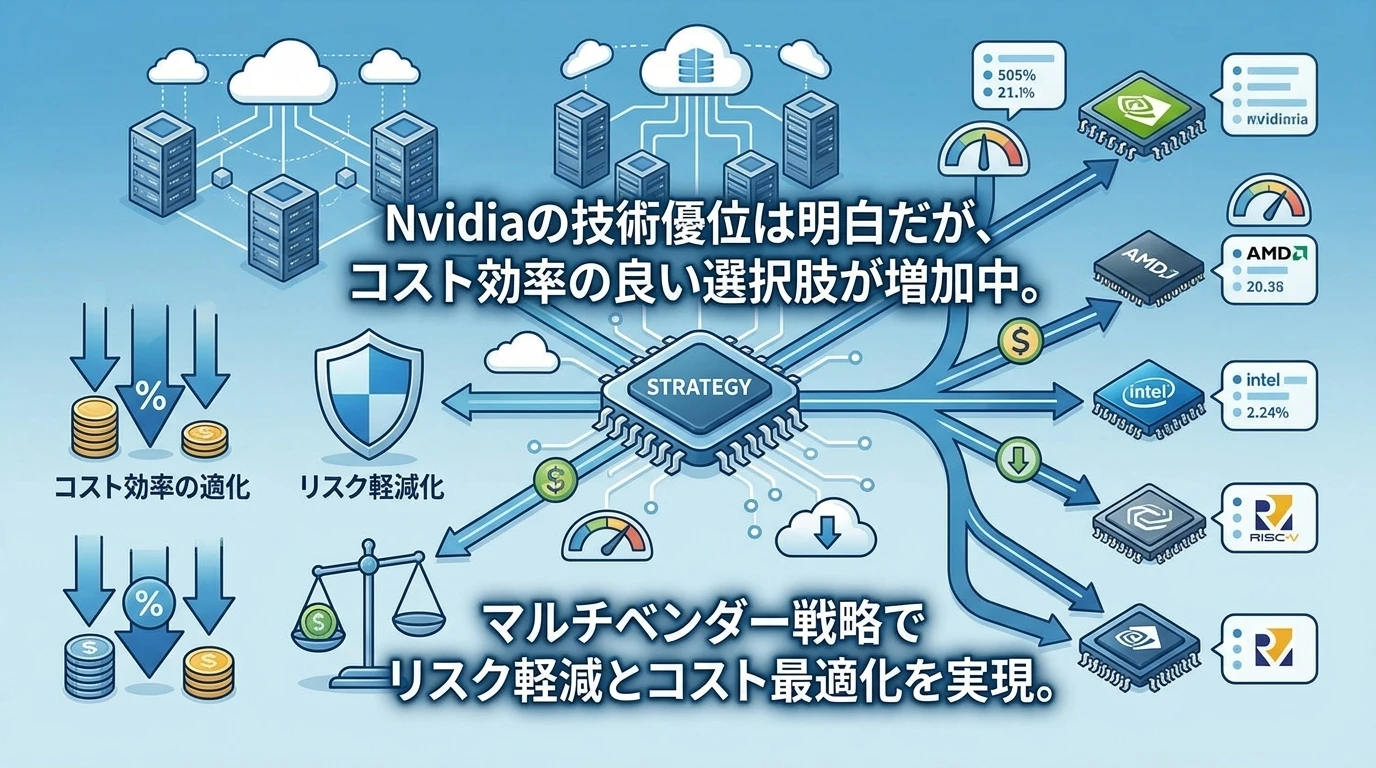

マルチベンダー戦略はリスク軽減とコスト最適化の両面で合理的

現時点ではNvidiaの技術的優位は明白だ。だがAI処理の分野を中心に、コスト効率で勝る選択肢が増えている。

特にクラウド経由でAIを利用する場合、裏側でどのメーカーのチップが動いているかをユーザーが意識する必要はなくなりつつある。

中長期の調達戦略として、複数のベンダーを併用する「マルチベンダー」の検討を始めておくことは、特定企業への依存リスクの軽減とコスト最適化の両面で合理的だ。

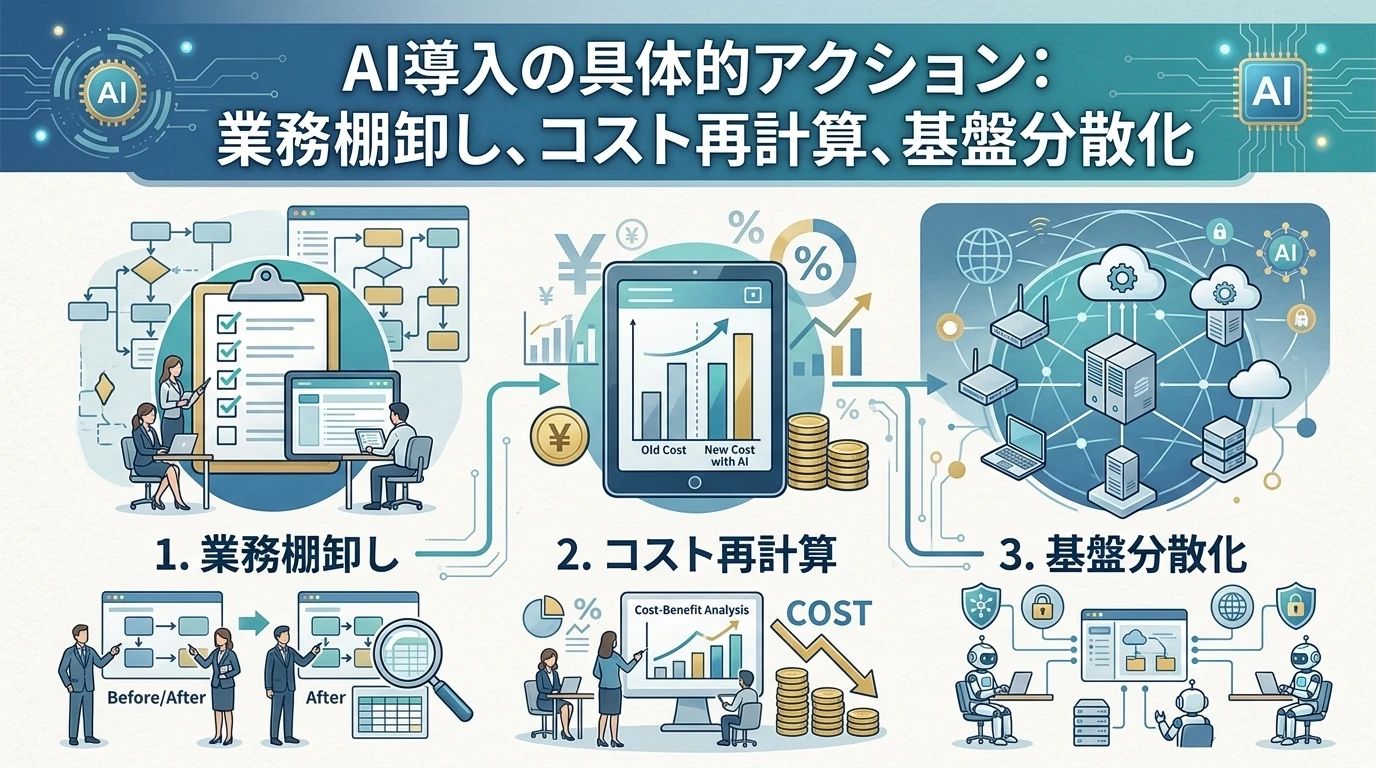

ビジネスパーソンが今日からできる3つのこと

GTC 2026が示した変化を具体的なアクションに落とし込むなら、以下の3つがある。

1. 自社の業務フローを「AIに任せられるか?」の目線で棚卸しする

SAP、ServiceNow、Salesforceなど、自社が使っている業務ソフトがAIエージェントにどう対応するか、ベンダーの営業担当にロードマップを確認する。

「この業務の、この手順は、AIエージェントに任せられるか?」という問いを立て、候補をリスト化しておく。完全にAI任せではなく、人間が最終確認する「半自律型」を前提にするのがポイントだ。

2. AI投資の判断基準を「半年後のコスト」で再計算する

AIを動かすコストは急速に下がっている。半年前に「コストが見合わない」と見送ったプロジェクトがあれば、現時点の料金で再計算してみる。利用中のクラウドサービスのAI関連料金表を四半期ごとにチェックする習慣をつけるだけでも、投資判断の精度は上がる。

3. AI基盤の調達先を1社に固定しない

Nvidiaは現時点で最も幅広いサービスを提供している。だがGoogleやAMDのチップも性能・コスト面で追い上げている。クラウド経由の利用であれば、複数のクラウドサービスを使い分ける戦略の中に、AI基盤の分散も組み込むことを検討する。

問われているのは「AIを使うかどうか」ではない

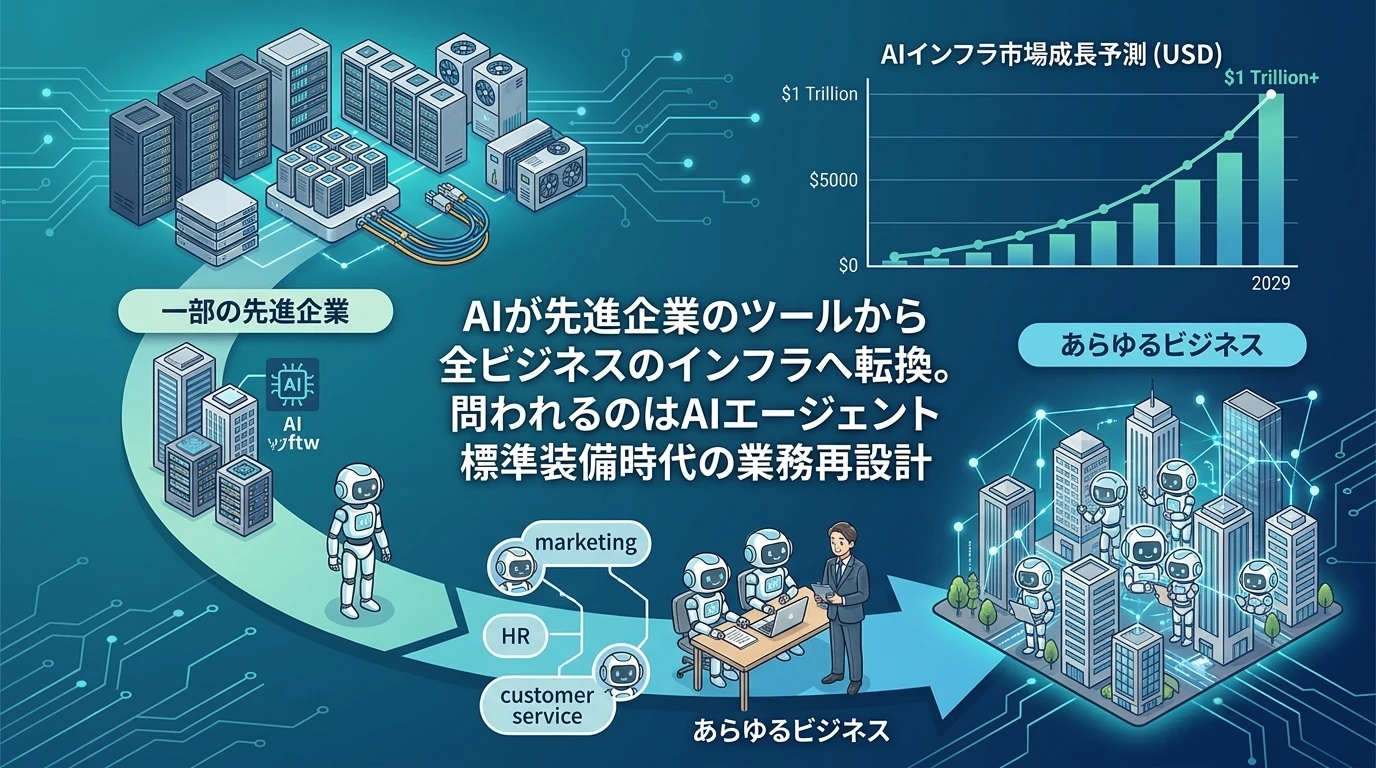

GTC 2026は、AIが「一部の先進企業のツール」から「あらゆるビジネスのインフラ」に変わる転換点を印象づけたカンファレンスだった。

Jensen Huangの「1兆ドル」は、Nvidia 1社の売上見通しにすぎない。しかしその背景には、調査会社の推計によれば、世界のデータセンター投資が2029年に1兆ドル超へ倍増するという、より大きな構造変化がある。

問われているのは、もはや「AIを使うかどうか」ではない。「AIエージェントが標準装備になる世界で、自社の業務をどう再設計するか」だ。

出典・参考情報

1. NVIDIA Blog — GTC 2026 News

2. NVIDIA Newsroom — AI Agents

3. NVIDIA Newsroom — Blackwell Ultra

4. NVIDIA Newsroom — Physical AI

6. NVIDIA Newsroom — Vera Rubin

7. Bain & Company — GTC 2025 Analysis

8. Bain & Company — GTC 2026 Analysis

9. CNBC — Nvidia $1T projection

10. CIO Dive — Tour of Dependency

11. SoftBank — AI Computing Platform

12. Dell’Oro Group — Data Center Investment